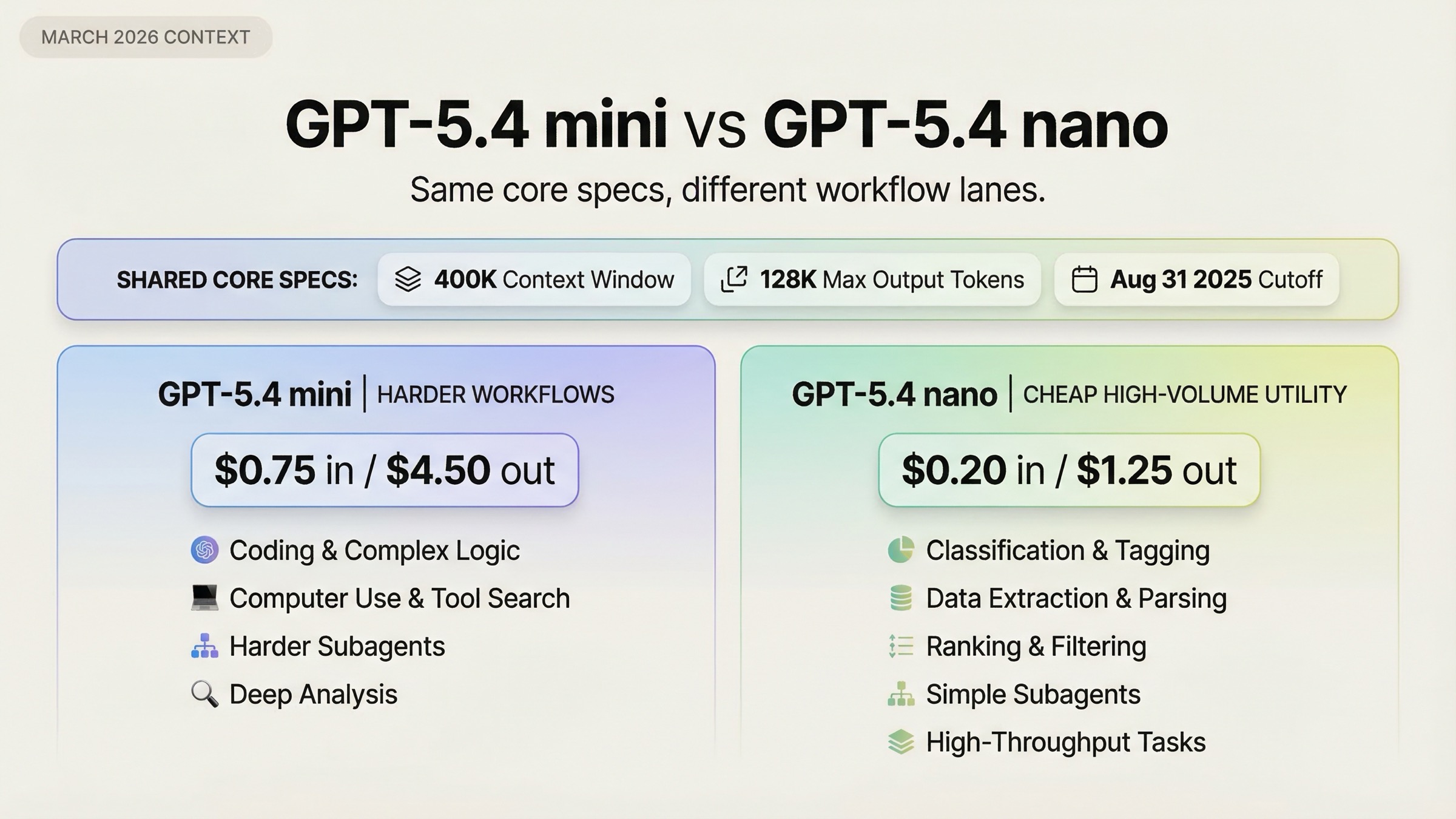

A fecha del 20 de marzo de 2026, la regla más útil es esta: usa GPT-5.4 mini si tu producto necesita mejor coding, computer use o workflows agénticos más pesados, y usa GPT-5.4 nano si lo más importante es throughput barato. En el lanzamiento oficial del 17 de marzo de 2026, OpenAI posiciona GPT-5.4 mini como el small model más fuerte para coding y subagents, mientras que GPT-5.4 nano se recomienda de forma explícita para classification, data extraction, ranking y subagentes de apoyo más simples.

La trampa de esta comparación es que ambos modelos parecen más parecidos de lo que realmente son. Comparten 400K de context window, 128K de max output y el mismo knowledge cutoff del 31 de agosto de 2025. Si solo miras la tabla de specs, parece que todo se reduce al precio. No es así. La pregunta de verdad es otra: ¿tu workload necesita la profundidad extra de mini o es lo bastante simple como para que nano sea el mejor punto operativo?

Resumen rápido

Si quieres una respuesta utilizable ya, empieza por aquí:

| Modelo | Mejor para | Motivo principal para elegirlo | Motivo principal para no elegirlo |

|---|---|---|---|

| GPT-5.4 mini | coding assistants, workflows con capturas, browser/desktop automation, subagentes más pesados | Más fuerte en coding, tool use y computer use; además soporta computer use y tool search | Es caro: $0.75 input / $4.50 output por 1M tokens |

| GPT-5.4 nano | classification, extraction, ranking, routing barato, subagentes simples | Mucho más barato: $0.20 input / $1.25 output por 1M tokens; mismo contexto y cutoff que mini | No tiene computer use ni tool search y rinde peor en workflows más pesados |

Regla rápida de decisión:

- Si el modelo tiene que leer código, recuperarse de tool failures, trabajar sobre interfaces o actuar como worker fuerte dentro de un sistema agente, empieza por GPT-5.4 mini.

- Si el modelo sobre todo clasifica, extrae, ordena, enruta o hace tareas de apoyo baratas, empieza por GPT-5.4 nano.

- Si tu sistema mezcla cargas duras y baratas, la mejor respuesta suele ser "mini para el carril duro y nano para el carril barato".

- Si estás usando nombres visibles de ChatGPT para decidir API, primero separa esas superficies.

La diferencia real no está en el contexto, sino en la profundidad del workflow

Muchas páginas comparativas abren con precio, contexto y cutoff porque son los campos más fáciles de recopilar. En esta keyword, eso no alcanza para tomar una buena decisión.

Según las model pages actuales de OpenAI, GPT-5.4 mini y GPT-5.4 nano comparten:

- 400K context window

- 128K max output

- knowledge cutoff del 31 de agosto de 2025

- soporte para text e image input

Eso significa que la elección aquí no va de "quién tiene más contexto" o "quién está más fresco" en abstracto. Sobre el papel están muy cerca.

La separación real aparece cuando preguntas qué trabajo debe hacer cada modelo dentro de producción.

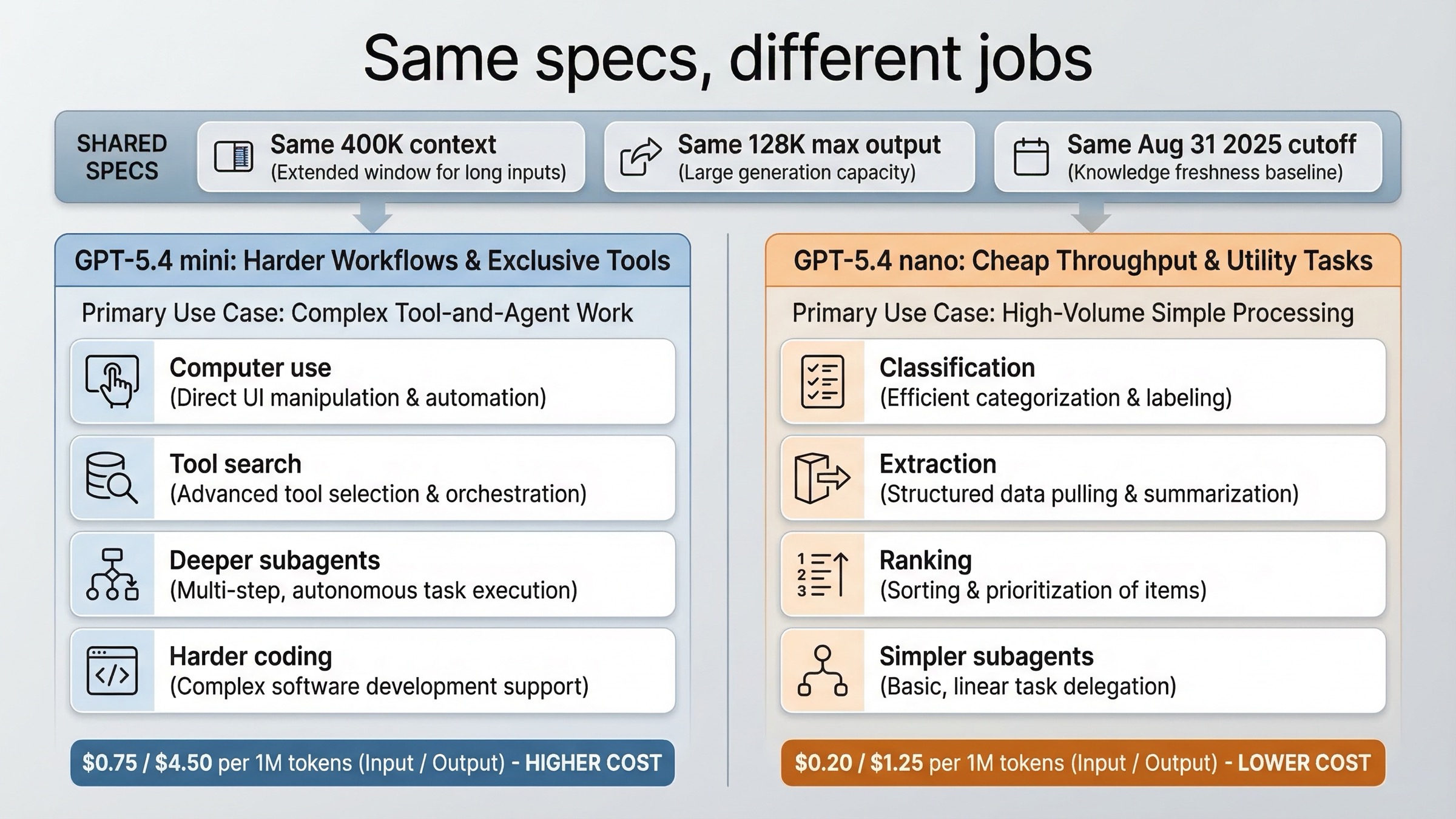

La guía de GPT-5.4 describe GPT-5.4 mini como la opción para high-volume coding, computer use y agent workflows que todavía necesitan razonamiento fuerte. En cambio, GPT-5.4 nano se plantea como la ruta para simple high-throughput work donde speed y cost mandan. Ese framing es mucho más útil que pensar en "uno un poco mejor y otro un poco más barato".

Mirado así, el mapa mental práctico queda así:

| Pregunta | Si la respuesta es sí | Mejor encaje |

|---|---|---|

| ¿Hace falta coding real o trabajo sobre codebase? | Importa el benchmark de coding y la fiabilidad del agente | GPT-5.4 mini |

| ¿Hace falta built-in computer use o acciones guiadas por UI? | El workflow gira alrededor de capturas o interfaces | GPT-5.4 mini |

| ¿La carga es sobre todo extraction, ranking o classification a gran volumen? | Importa más throughput y coste | GPT-5.4 nano |

| ¿Buscas un worker barato por debajo de un planner más grande? | Quieres el ejecutor más barato que siga siendo útil | GPT-5.4 nano |

Ese marco también aclara el precio: mini no cuesta más por tener más contexto, sino por ser un worker más fuerte para herramientas y agentes.

Precio, rate limits y soporte de tools lado a lado

Antes de mirar los benchmarks, conviene ver el salto de precio sin suavizarlo.

Según la model page de GPT-5.4 mini y la model page de GPT-5.4 nano, verificadas el 20 de marzo de 2026:

| Especificación | GPT-5.4 mini | GPT-5.4 nano |

|---|---|---|

| Input price | $0.75 / 1M tokens | $0.20 / 1M tokens |

| Cached input | $0.075 / 1M tokens | $0.02 / 1M tokens |

| Output price | $4.50 / 1M tokens | $1.25 / 1M tokens |

| Context window | 400K | 400K |

| Max output | 128K | 128K |

| Knowledge cutoff | 2025-08-31 | 2025-08-31 |

| Snapshot | gpt-5.4-mini-2026-03-17 | gpt-5.4-nano-2026-03-17 |

En otras palabras, GPT-5.4 mini cuesta alrededor de 3.75x más en input, 3.75x más en cached input y 3.6x más en output. Es una diferencia de arquitectura, no un detalle menor.

Los rate limits están más cerca de lo que mucha gente supone. En la página de compare models, la diferencia grande aparece sobre todo en tiers bajos:

| Tier | GPT-5.4 mini TPM | GPT-5.4 nano TPM |

|---|---|---|

| Tier 1 | 500,000 | 200,000 |

| Tier 2 | 2,000,000 | 2,000,000 |

| Tier 3 | 4,000,000 | 4,000,000 |

| Tier 4 | 10,000,000 | 10,000,000 |

| Tier 5 | 180,000,000 | 180,000,000 |

Por tanto, en producción la discusión suele ir más por unit economics y ajuste a la tarea que por TPM puro.

La diferencia importante está en las herramientas:

| Capacidad | GPT-5.4 mini | GPT-5.4 nano |

|---|---|---|

| Web search | Yes | Yes |

| File search | Yes | Yes |

| Image generation tool | Yes | Yes |

| Code interpreter | Yes | Yes |

| Hosted shell | Yes | Yes |

| Apply patch | Yes | Yes |

| Skills | Yes | Yes |

| Computer use | Yes | No |

| MCP | Yes | Yes |

| Tool search | Yes | No |

Aquí es donde cambia de verdad la lectura.

Nano no es un modelo "pelado". Sigue soportando hosted shell, apply patch, skills e image generation. Eso significa que, como worker estrecho para tareas agénticas acotadas, sigue siendo bastante competente.

Pero mini conserva dos capacidades que separan mejor los workflows agénticos pesados de los más simples: computer use y tool search. Si el modelo tiene que operar sobre software leyendo capturas o escoger herramientas dentro de una superficie mayor, esa diferencia se vuelve estructural.

Por eso esta comparación no debería simplificarse a "más barato frente a más fuerte". La pregunta buena es: ¿tu producto necesita esas superficies extra lo suficiente como para pagar el coste de mini?

Los benchmark gaps que sí cambian la decisión

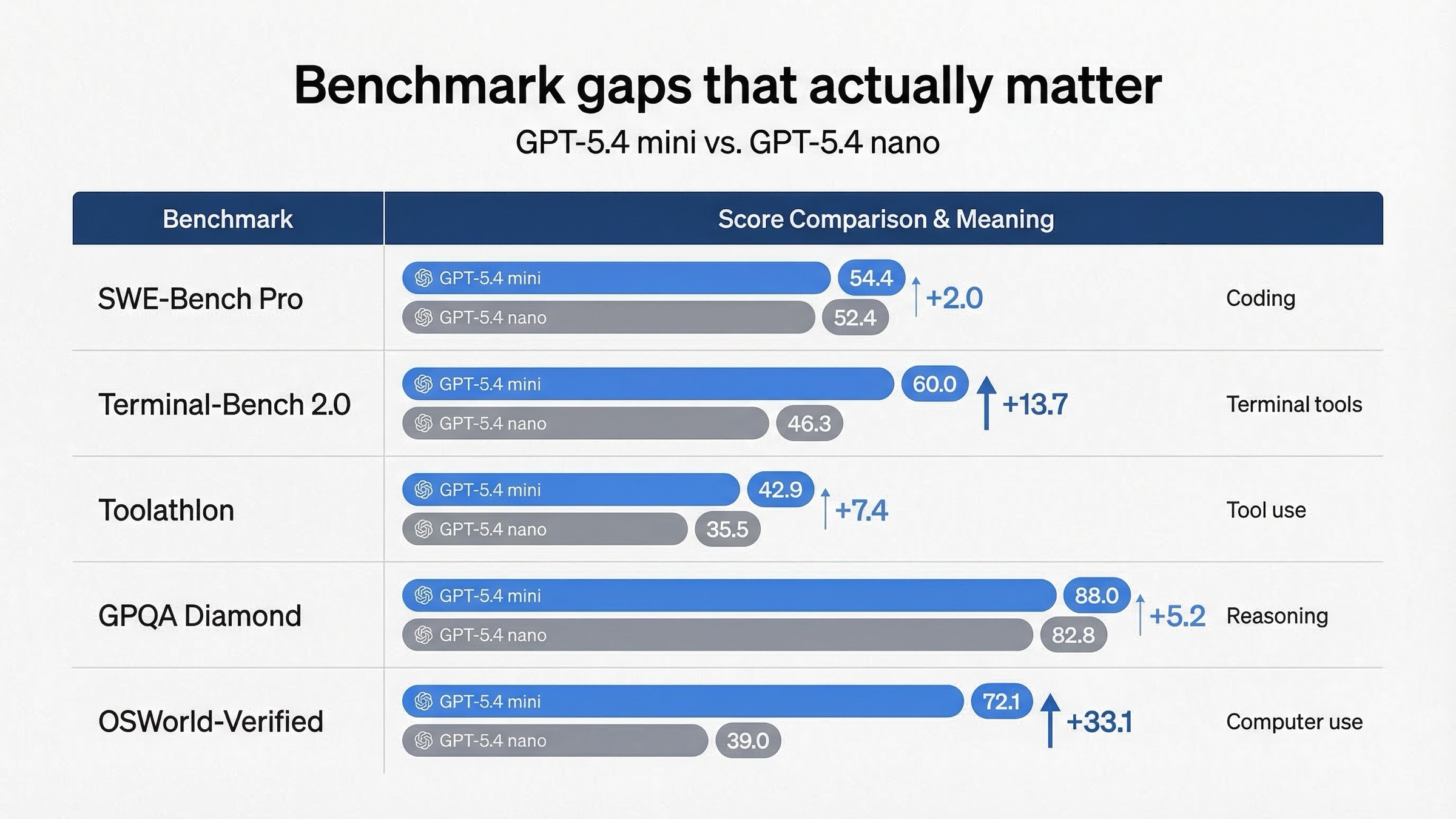

El launch post del 17 de marzo de 2026 ofrece la comparación oficial más limpia entre mini y nano:

| Benchmark del launch post | GPT-5.4 mini | GPT-5.4 nano | Qué significa en la práctica |

|---|---|---|---|

| SWE-Bench Pro (Public) | 54.4% | 52.4% | Mini es mejor en resolución de issues reales de software, pero la brecha no es enorme |

| Terminal-Bench 2.0 | 60.0% | 46.3% | En trabajo con terminal y tools, mini se despega bastante |

| Toolathlon | 42.9% | 35.5% | Mini es más fiable usando tools |

| GPQA Diamond | 88.0% | 82.8% | Mini tiene más margen en razonamiento difícil |

| OSWorld-Verified | 72.1% | 39.0% | En workflows de computer use, mini está en otra liga |

Lo más importante aquí son tres cosas.

La primera: la ventaja de mini no pesa igual en todos los frentes. La diferencia en SWE-Bench es real, pero no implica que cualquier tarea de coding obligue a usar mini. Para subtareas ligeras dentro de un sistema mayor, nano todavía puede ser la mejor relación coste/valor.

La segunda: donde mini realmente abre hueco es en terminal-heavy, tool-heavy y computer-use-heavy work. Eso encaja perfectamente con la tabla de tools.

La tercera: nano no es débil, sino la rama barata con un suelo de capacidad bastante alto. El mensaje de OpenAI es claro: si la subtarea es simple y repetible, nano; si deja de ser simple, mini.

Esa es justo la capa que muchas páginas del SERP no explican. Muestran las cifras, pero no dicen qué cifras deberían mover tu presupuesto.

Regla de uso:

- Paga por mini cuando tool failures, recoveries lentas o errores de computer use realmente te cuesten UX o ingeniería.

- Usa nano cuando la tarea sea lo bastante barata, estrecha y repetitiva como para que el extra de mini fuese principalmente un sobrecoste.

Cuándo merece pagar el sobrecoste de GPT-5.4 mini

GPT-5.4 mini compensa cuando el modelo debe comportarse más como un operador fuerte que como un clasificador barato.

El caso más evidente es coding assistants. OpenAI ya coloca mini sobre coding workflows y los benchmarks lo respaldan. Si el modelo debe navegar un repositorio, leer varios archivos, recuperarse tras un failed tool call, entender un diff y trabajar con estabilidad dentro de un harness de código, mini es un default más sólido.

El segundo caso es computer use y workflows con capturas. Aquí mini se distancia con claridad. Si el sistema necesita leer UIs, operar software o entender pantallas densas dentro de un bucle estructurado, mini no es solo "algo mejor": es el único de este par con built-in computer use.

El tercer caso son subtareas agénticas más pesadas. El launch post describe un patrón tipo Codex donde un modelo grande planifica y un pequeño ejecuta subtareas en paralelo. Si esas subtareas todavía exigen buen judgment de código, selección de tools o comportamiento más robusto, mini encaja mejor.

El cuarto caso es un ecosistema de tools más complejo. Tool search se subestima con facilidad, pero cuando crecen las tools, los namespaces o las superficies MCP, empieza a importar de verdad. Con un toolset pequeño y fijo, nano vale; cuando la superficie se complica, mini es más seguro.

Suele merecer pagar por GPT-5.4 mini si se cumplen varias de estas condiciones:

- el modelo hace coding de verdad y no simples toques menores;

- necesitas computer use o screenshot-grounded reasoning;

- los tool failures se convierten en retries, latencia o pérdida de confianza;

- el worker vive dentro de un sistema agente, pero sus subtareas siguen siendo poco triviales;

- el hidden engineering cost pesa más que el precio bruto por token.

Ese último punto es clave. Retries, fallbacks, prompts más complejos, intervención humana y tiempo de espera del usuario también cuestan dinero. Mini compensa cuando reduce esos costes ocultos.

Cuándo GPT-5.4 nano es el mejor default

GPT-5.4 nano no es solo la opción para presupuestos apretados. Es el modelo correcto cuando la tarea debe vivir desde el principio en el carril barato.

OpenAI recomienda nano para classification, data extraction, ranking y simpler coding subagents. Traducido a trabajo de producción, eso se parece a:

- clasificar intención de usuario o tickets

- extraer campos estructurados de texto

- ordenar o priorizar candidatos

- enrutar peticiones a otros sistemas

- ejecutar tareas de apoyo sencillas bajo un planner mayor

En estos escenarios, el producto gana más con menor coste y mejor throughput que con un techo de benchmark más alto.

Nano también tiene sentido cuando el sistema general es complejo, pero la subtarea concreta es superficial. Por ejemplo, si un planner grande o un worker más fuerte resuelve lo difícil y dejas a nano:

- resumir output de tools para devolvérselo al planner

- filtrar documentos candidatos

- extraer campos para un rule engine posterior

- hacer validación barata o routing

La forma correcta de pensar en nano no es "modelo universal más débil", sino "especialista barato para tareas simples".

GPT-5.4 nano es el default correcto si la mayoría de estas condiciones se cumple:

- la tarea es estrecha, repetitiva y estructuralmente simple;

- importa más la economía por unidad que el edge-case capability;

- no necesitas built-in computer use;

- no necesitas tool search sobre una superficie amplia;

- estás diseñando un worker de apoyo bajo un coordinador mayor.

En otras palabras: si la pregunta real es "¿cuál es el modelo más barato que sigue haciendo bien este trabajo?", la respuesta suele ser nano.

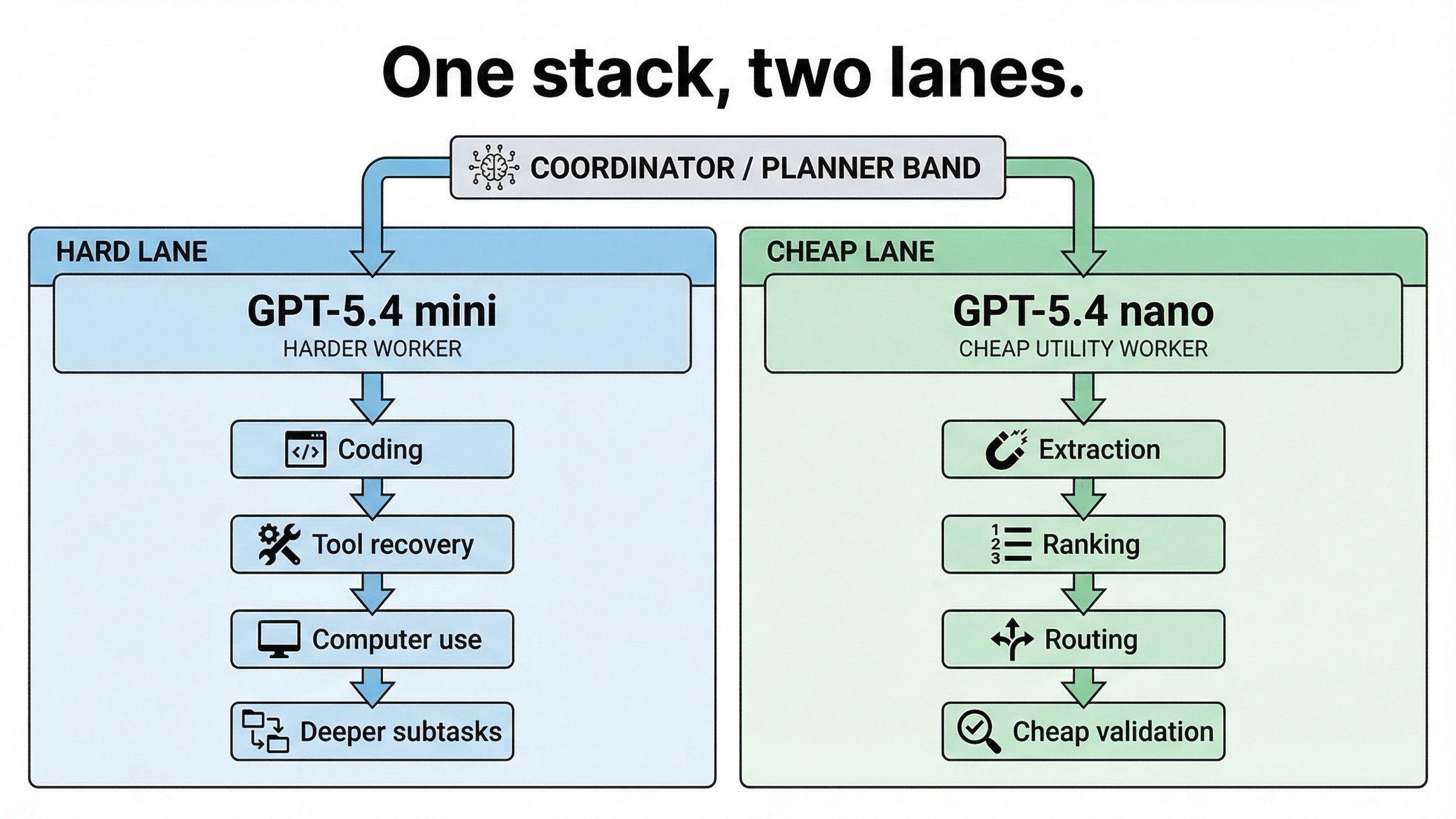

En muchos sistemas, la mejor respuesta es usar ambos

Esta es precisamente la parte que muchas comparativas omiten aunque en la práctica sea la más útil.

Si tu producto solo tiene un tipo de request, puedes elegir mini o nano. Pero muchos sistemas reales tienen como mínimo dos carriles:

- un carril pesado, donde importan coding, tool recovery, screenshot interpretation o razonamiento más profundo;

- un carril barato, donde dominan extraction, ranking, classification o support tasks.

Cuando esas dos naturalezas conviven, forzar a un solo modelo a cubrirlo todo suele ser peor que separarlas.

La división más práctica suele ser:

| Carril | Mejor modelo | Por qué |

|---|---|---|

| Worker fuerte junto al planner | GPT-5.4 mini | Mejor para coding depth, tool reliability y computer-use style work |

| Helper o worker barato de apoyo | GPT-5.4 nano | Mejor economía en tareas estrechas y repetitivas |

Ese esquema encaja exactamente con lo que el launch post sugiere cuando habla de subagents. Mini puede asumir la rama fuerte y nano la rama utilitaria barata, siempre que la subtarea sea realmente simple.

Por eso, si tu equipo sigue discutiendo si "estandarizar en mini" o "estandarizar en nano", probablemente la respuesta correcta sea: estandariza primero la lógica de routing y luego asigna un modelo a cada carril.

API, Codex y ChatGPT: no los mezcles

Esta keyword atrae búsquedas desde superficies distintas del producto, y ahí nace buena parte de la confusión.

Para API, la respuesta oficial es sencilla:

- GPT-5.4 mini está disponible en API.

- GPT-5.4 nano también está disponible en API.

Para Codex, el launch post es más concreto: GPT-5.4 mini está disponible en Codex app, CLI, extensión de IDE y web, y Codex puede delegar subtareas a subagents con GPT-5.4 mini. GPT-5.4 nano no se presenta del mismo modo como surface model de Codex.

Con ChatGPT es más fácil equivocarse. El launch post dice que GPT-5.4 mini aparece en ciertos paths de ChatGPT, pero la Help Center article actual explica que la línea por defecto para usuarios con sesión iniciada es GPT-5.3 y que en planes de pago lo seleccionable manualmente es GPT-5.4 Thinking. Eso significa que la experiencia visible en ChatGPT no debe tomarse como recomendación directa de API.

Si la pregunta real es "qué modelo comprar para API", mira model pages y launch post. Si la pregunta es "qué veo en ChatGPT", mira Help Center. Los nombres se parecen, pero la decisión de producto no es la misma.

FAQ

¿GPT-5.4 mini es siempre mejor que GPT-5.4 nano?

Es más fuerte, sí, pero no siempre es la mejor decisión. Para tareas simples y de alto volumen, nano puede ser la respuesta correcta porque cuesta mucho menos y OpenAI lo encuadra justo para esa rama.

¿Qué conviene para coding?

Si es coding real, mini. Si es un subagente sencillo dentro de un sistema mayor de coding, nano puede bastar. Cuanto más pesado sea el tool flow y más juicio necesites, más se inclina la respuesta hacia mini.

¿Qué conviene para extraction y ranking?

OpenAI recomienda nano de forma explícita para classification, data extraction y ranking. Así que el default razonable es empezar a medir con nano.

¿GPT-5.4 nano soporta tools?

Sí. Nano sigue soportando web search, file search, image generation, code interpreter, hosted shell, apply patch, skills y MCP. Las ausencias más importantes frente a mini son computer use y tool search.

¿Con qué debería empezar un equipo nuevo, mini o nano?

No empieces por el nombre, sino por el trabajo real. Si es coding-heavy o agent-heavy, mini. Si es throughput barato, nano. Si el producto tiene ambos carriles, usa ambos.

Recomendación final

Si necesitas una sola frase para la decisión de equipo, usa esta: GPT-5.4 mini es el default correcto para workflows de coding y agentes más pesados, mientras que GPT-5.4 nano es el default correcto para utility work barato y de alto volumen.

Ese criterio se apoya en cinco hechos verificados el 20 de marzo de 2026:

- ambos modelos comparten context window, max output y knowledge cutoff;

- nano es mucho más barato;

- mini es más fuerte en benchmarks relevantes para coding, tool use y computer use;

- mini soporta computer use y tool search, nano no;

- OpenAI recomienda nano para classification, extraction, ranking y supporting subagents más simples.

Por tanto, la pregunta real no es "cuál es más fuerte". Más fuerte es mini. La pregunta real es si tu tarea es lo bastante exigente como para necesitar mini, o lo bastante simple como para que pagar por mini sea sobregasto. En muchos sistemas de producción, la respuesta correcta es dar a cada modelo un carril distinto.