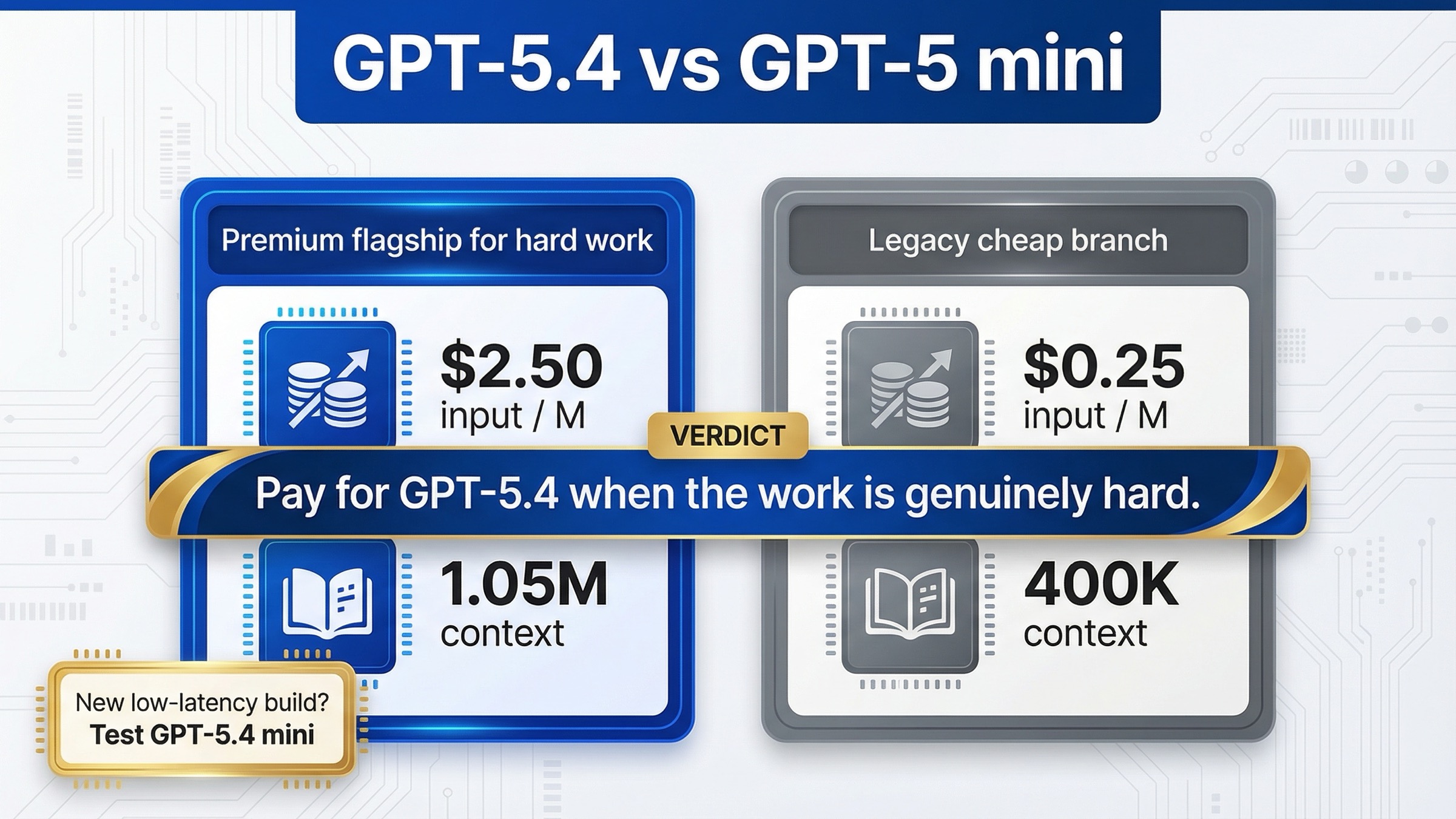

Respuesta directa: a fecha de 20 de marzo de 2026, GPT-5.4 es la mejor opción por defecto para trabajo serio de coding, agentes y flujos profesionales, mientras que GPT-5 mini solo sigue siendo la opción correcta cuando el trabajo es estrecho, estable y tan sensible al coste que la diferencia de precio pesa más que la diferencia de capacidad. GPT-5.4 se lanzó el 5 de marzo de 2026 como la ruta flagship actual de OpenAI para trabajo profesional, y la página actual de GPT-5 mini la mantiene viva, pero ya no la presenta como la pequeña ruta moderna que deberías escoger primero para proyectos nuevos.

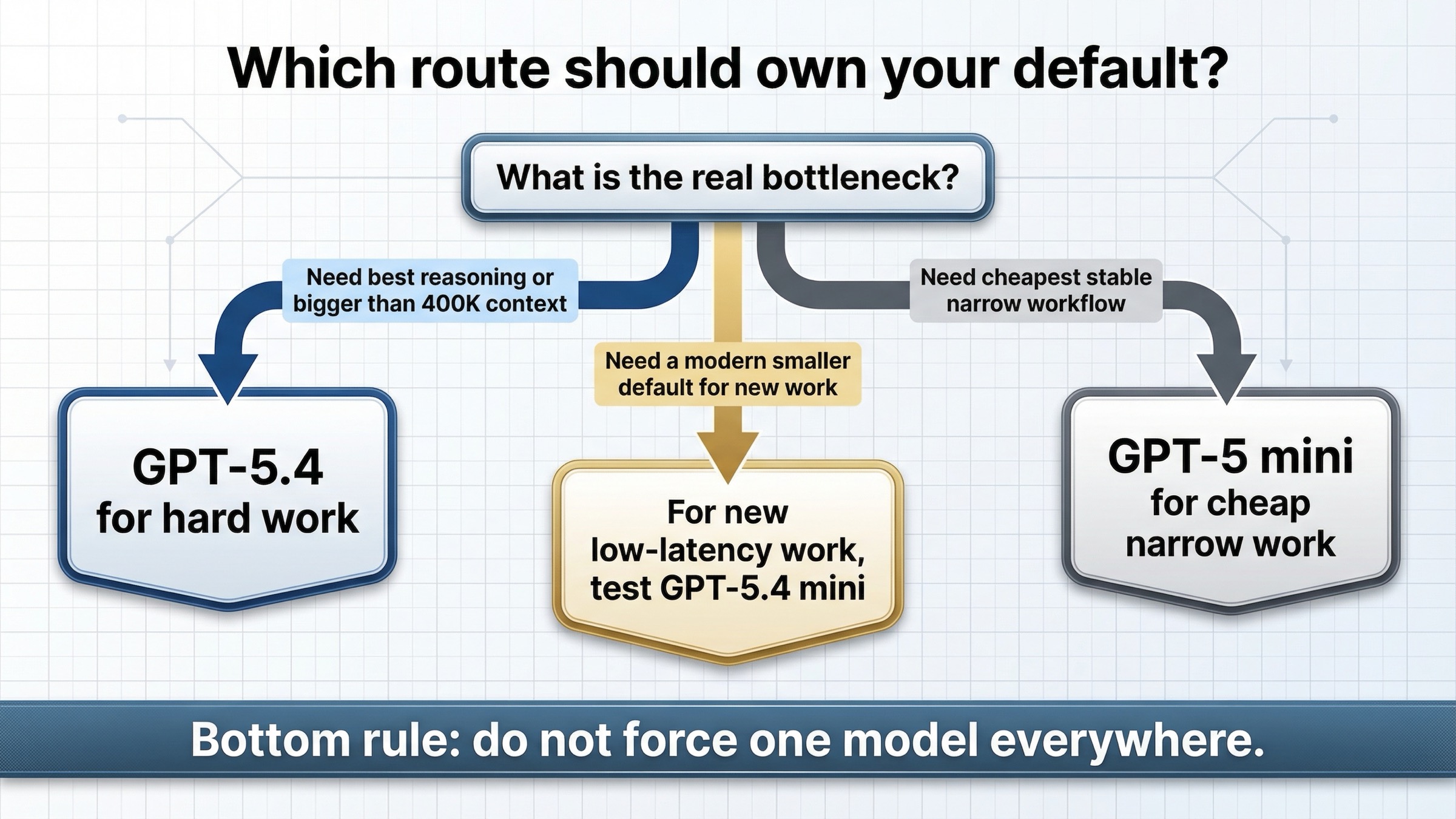

Ese matiz importa mucho. La propia página de GPT-5 mini dice hoy que la mayoría de nuevos workloads de baja latencia y alto volumen deberían empezar por gpt-5.4 mini. Por eso esta comparación no trata solo de listar precios y contexto. Trata de responder tres preguntas reales: cuándo merece pagar por GPT-5.4, cuándo GPT-5 mini sigue teniendo sentido y cuándo en realidad deberías mover la evaluación a GPT-5.4 mini vs GPT-5 mini.

Resumen rápido

| Modelo | Mejor para | Por qué elegirlo | Principal coste |

|---|---|---|---|

| GPT-5.4 | Coding difícil, trabajo de repositorio con contexto largo, agentes con herramientas, salidas de alto riesgo | 1,050,000 de contexto, cutoff del 31 de agosto de 2025, mejor perfil oficial en benchmarks y tool surface mucho más amplia | Es caro: $2.50 input y $15 output por 1M tokens |

| GPT-5 mini | Pipelines de texto estables y baratos, generación estructurada simple, routing heredado sensible a coste | Solo $0.25 input y $2.00 output por 1M tokens | 400,000 de contexto, cutoff del 31 de mayo de 2024 y una superficie de herramientas bastante más estrecha |

Si quieres una regla operativa, usa esta: elige GPT-5.4 cuando fallar sea caro, cuando rehacer prompts sea doloroso o cuando el contexto largo y las herramientas cambien el producto; conserva GPT-5 mini solo cuando el trabajo sea lo bastante estrecho como para que pagar la prima sea básicamente comprar margen que no vas a usar.

La segunda regla es igual de importante: si tu objetivo real es tener una ruta pequeña y moderna para builds nuevos, no te quedes solo con este par. La documentación actual empuja a comparar GPT-5.4 con GPT-5.4 mini, no a tratar GPT-5 mini como el pequeño default de futuro.

Por qué esta comparación es más compleja de lo que parece

Muchas páginas de la SERP simplifican demasiado este keyword. Presentan la consulta como si fuera una comparación normal entre un flagship y su versión mini, enseñan una tabla de precios y cierran el tema. Eso ya no describe bien el estado actual del lineup.

En la página de GPT-5.4, OpenAI posiciona a GPT-5.4 como el modelo frontier por defecto para coding, workflows agentic y trabajo profesional. En la página de GPT-5 mini, GPT-5 mini sigue apareciendo como rama rápida y más barata para tareas bien definidas, pero esa misma página añade que la mayoría de nuevos builds de baja latencia y alto volumen deberían empezar por GPT-5.4 mini.

Eso cambia la compra. Si hoy comparas GPT-5.4 y GPT-5 mini, normalmente estás en una de estas situaciones:

- Estás decidiendo si la prima de un modelo flagship compensa frente a una ruta barata ya existente.

- Estás defendiendo un despliegue heredado de GPT-5 mini y quieres saber si merece la pena mantenerlo.

- Estás empezando desde cero, ves que GPT-5 mini sigue vivo y necesitas saber si deberías saltártelo y evaluar la nueva línea mini.

Ese es también el hueco que deja la SERP actual. Los docs oficiales cubren los datos básicos, pero no resuelven del todo la pregunta de producto que sí tiene que responder un tech lead: pagamos GPT-5.4, mantenemos GPT-5 mini o cambiamos la ruta barata a GPT-5.4 mini.

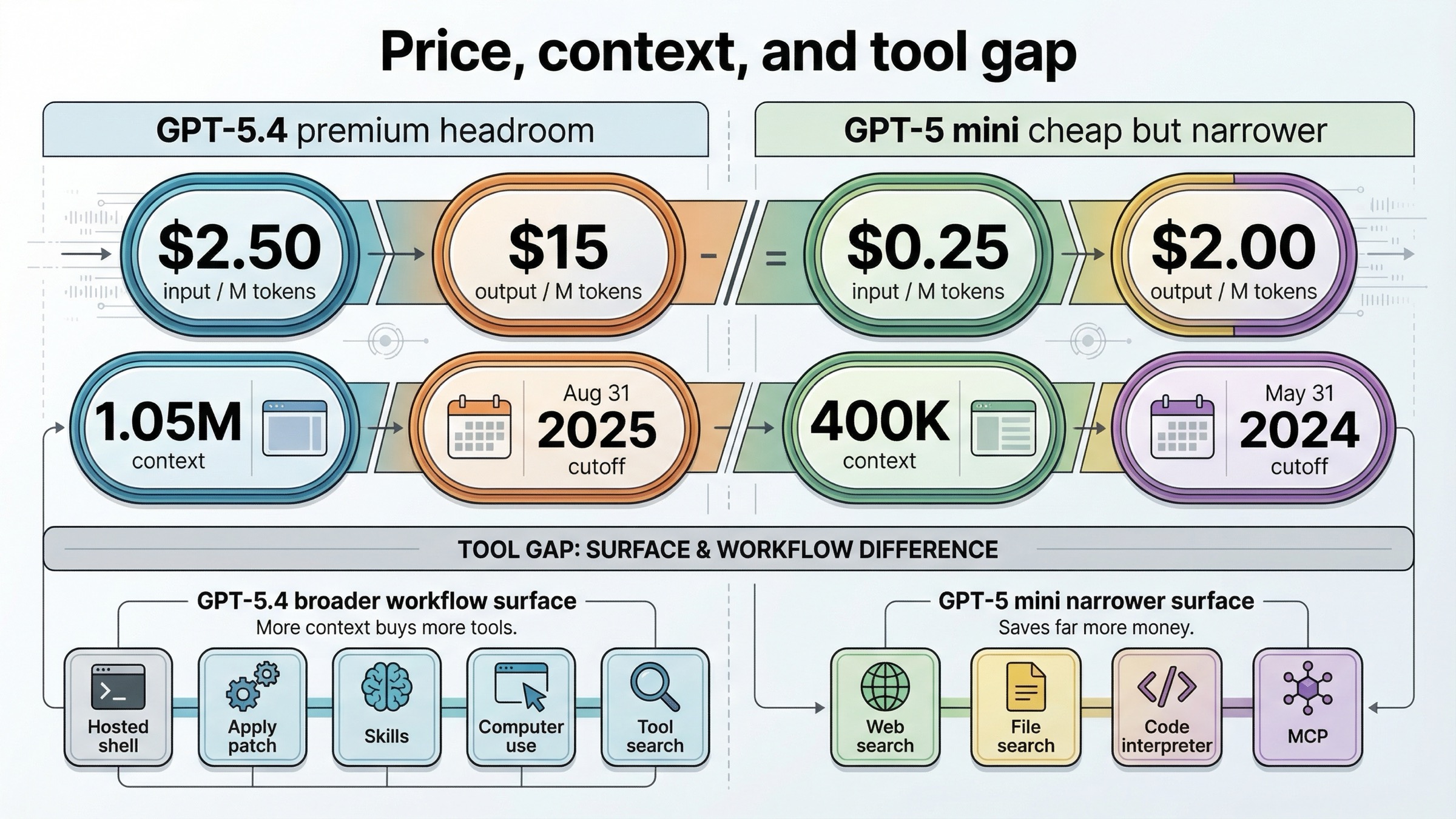

Precio, ventana de contexto y herramientas lado a lado

La brecha de precio es grande. Según la página actual de GPT-5.4, GPT-5.4 cuesta $2.50 por 1M input tokens, $0.25 por 1M cached input tokens y $15.00 por 1M output tokens. Según la página actual de GPT-5 mini, GPT-5 mini cuesta $0.25 por 1M input, $0.025 por 1M cached input y $2.00 por 1M output.

Traducido a negocio: GPT-5.4 vale hoy 10 veces más en input, 10 veces más en cached input y 7.5 veces más en output. Si tu workload envía mucho volumen de prompts simples y casi nunca tropieza con límites de calidad, esa diferencia puede pesar más que la mejora del modelo. Ese es el argumento más sólido para seguir manteniendo GPT-5 mini en producción.

El problema es que la brecha de capacidad también es amplia. GPT-5.4 ofrece 1,050,000 de contexto, 128,000 max output y un knowledge cutoff del 31 de agosto de 2025. GPT-5 mini ofrece 400,000 de contexto, el mismo 128,000 max output y un cutoff del 31 de mayo de 2024. Si tu prompt toca librerías nuevas, cambios de API de 2025 o repositorios y documentos muy grandes, GPT-5.4 parte con ventaja antes incluso de hablar de prompting.

La diferencia de herramientas es todavía más importante. GPT-5.4 lista hoy soporte para web search, file search, image generation, code interpreter, hosted shell, apply patch, skills, computer use, MCP, tool search y distillation. GPT-5 mini mantiene web search, file search, code interpreter y MCP, pero no lista hoy image generation, hosted shell, apply patch, skills, computer use, tool search ni distillation.

Eso significa que la decisión no es solo "mejor modelo frente a modelo más barato". También es superficie de workflow rica frente a superficie estrecha. Si tu sistema necesita shell alojado, parches, navegación de herramientas, computer use o un patrón de agente más amplio, el precio deja de ser el único número relevante.

Lo que realmente dicen el posicionamiento oficial y los benchmarks

El posicionamiento oficial es más claro de lo que parece si lees juntas la guía de modelos actuales y las páginas de lanzamiento.

En la página de lanzamiento de GPT-5.4, publicada el 5 de marzo de 2026, OpenAI presenta GPT-5.4 como su modelo frontier más capaz y eficiente para trabajo profesional. La página habla de reasoning, coding y workflows agentic en un único modelo, añade capacidad nativa de computer use para trabajo general y confirma soporte de hasta 1M tokens de contexto. No es el lenguaje de una mejora pequeña: es el lenguaje de un nuevo default.

La página de lanzamiento de GPT-5.4 mini y nano, del 17 de marzo de 2026, aclara además la lógica de la rama pequeña. Allí OpenAI dice que GPT-5.4 mini mejora a GPT-5 mini en coding, reasoning, comprensión multimodal y uso de herramientas, y que además corre más de 2x más rápido. También describe un patrón moderno de routing: GPT-5.4 se ocupa de planificación, coordinación y juicio final; GPT-5.4 mini maneja subtareas más estrechas en paralelo.

Eso te dice algo muy útil sobre GPT-5 mini: sigue vivo, pero ya no es la pequeña rama que OpenAI usa para explicar el futuro del stack. La pequeña rama moderna es GPT-5.4 mini.

La guía latest-model refuerza esa lectura. Explica que GPT-5.4 con none reasoning reemplaza bien a GPT-4.1 y que GPT-5.4 mini es una gran sustituta para o4-mini o gpt-4.1-mini. Es decir, el mapa de migración oficial apunta a la línea GPT-5.4 incluso cuando buscas algo más barato.

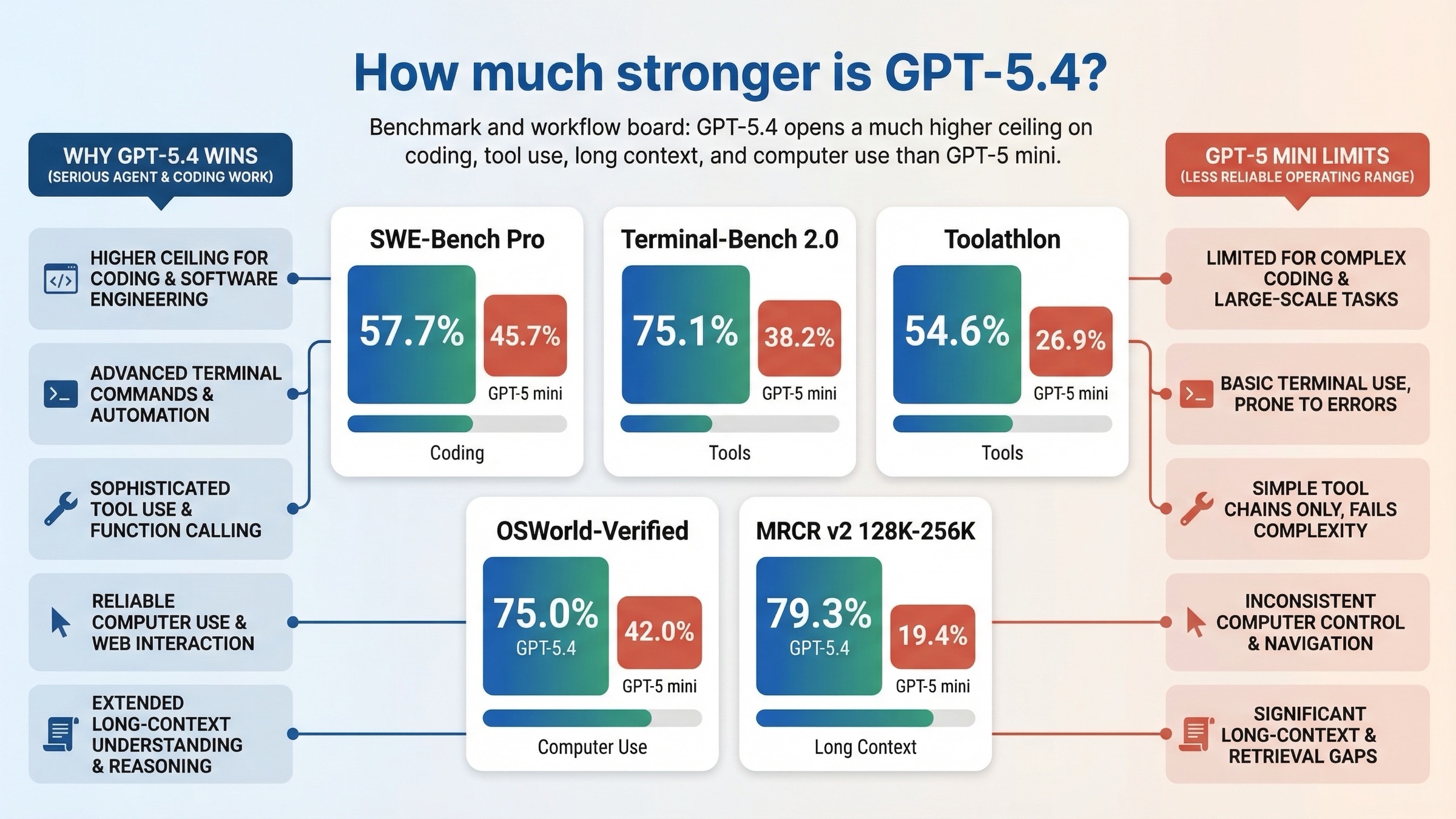

La tabla más útil para esta consulta está precisamente en la página de GPT-5.4 mini y nano, porque compara GPT-5.4 y GPT-5 mini en los mismos benchmarks:

- SWE-Bench Pro: 57.7% frente a 45.7%

- Terminal-Bench 2.0: 75.1% frente a 38.2%

- Toolathlon: 54.6% frente a 26.9%

- GPQA Diamond: 93.0% frente a 81.6%

- OSWorld-Verified: 75.0% frente a 42.0%

- MRCR v2 128K-256K: 79.3% frente a 19.4%

No son diferencias decorativas. Apuntan a una brecha operativa real en coding, uso de herramientas, trabajo con interfaces y contexto largo. Si tu sistema se parece a un coding agent, un repo assistant, un copiloto con docs o un operador de navegador, no estás pagando solo por mejor redacción: estás pagando por un techo de trabajo mucho más alto.

Hay una cautela metodológica. La tabla compara productos tal y como se exponen hoy, y allí GPT-5 mini llega hasta high reasoning mientras GPT-5.4 se evalúa con xhigh. Aun así, para quien compra el producto eso sigue siendo útil, porque lo que importa es el comportamiento real de la oferta actual, no una comparación abstracta con perillas igualadas que nadie puede usar en producción.

Cuándo merece pagar GPT-5.4

GPT-5.4 compensa cuando el coste de un modelo más débil no es solo peor calidad de respuesta, sino más reintentos, más capas de orquestación, más controles y más tiempo humano corrigiendo el resultado.

El primer caso claro es el contexto largo. Si trabajas con repositorios grandes, paquetes documentales largos o tareas multiarchivo donde el modelo necesita mantener un conjunto de trabajo amplio, pasar de 400K a 1.05M cambia lo que cabe en la sesión y reduce la necesidad de trocear manualmente.

El segundo caso es el trabajo agentic con herramientas. GPT-5.4 soporta hoy hosted shell, apply patch, skills, computer use y tool search. GPT-5 mini no. Si el plan del producto incluye delegación real, manipulación del entorno, aplicación de parches o inventarios amplios de herramientas, GPT-5.4 te permite construir una clase distinta de sistema.

El tercero es la salida profesional de mayor riesgo. En la página de lanzamiento, OpenAI insiste bastante en hojas de cálculo, presentaciones, documentos y conocimiento profesional. Cuando el coste de una mala respuesta es tiempo de ingeniería, tiempo de análisis, revisión legal o pérdida de confianza del usuario, la prima del modelo suele justificarse con bastante rapidez.

El cuarto es computer use y razonamiento visual sobre interfaces. GPT-5.4 se presenta explícitamente como el primer modelo general de OpenAI con capacidad de computer use nativa y puntera. Si tu flujo toca capturas, navegación de interfaces o software real, la diferencia deja de ser marginal.

Dicho de otra forma: GPT-5.4 merece la pena cuando pagar menos te obliga a invertir más tiempo de arquitectura para compensar lo que el modelo pequeño no cubre bien.

Cuándo GPT-5 mini sigue teniendo sentido

GPT-5 mini sigue teniendo sentido cuando el trabajo es tan estrecho que la mayor parte de la prima de GPT-5.4 se convertiría simplemente en una factura más alta.

El caso más sólido es un pipeline de texto maduro y de mucho volumen. Si los prompts ya están estabilizados, las salidas están muy acotadas, el uso de herramientas es superficial y el negocio ya está satisfecho, el coste puede pesar más que los benchmarks.

El segundo caso es la generación estructurada simple. Si la tarea consiste sobre todo en clasificar, enrutar, etiquetar, extraer o producir texto controlado, GPT-5 mini puede seguir siendo una rama barata razonable, especialmente si ya conoces bien su comportamiento en producción.

El tercero es una arquitectura con dos carriles donde la ruta pesada ya existe. Si ya usas un modelo más fuerte para el trabajo difícil y solo necesitas la ruta OpenAI más barata que siga siendo aceptable para tareas sencillas, GPT-5 mini puede seguir justificándose.

También existe un motivo práctico de migración: los sistemas reales no se reescriben porque el proveedor publique una recomendación nueva. Si GPT-5 mini ya está desplegado, medido y aceptable, no necesitas retirarlo a ciegas. Necesitas medir en qué parte concreta te está costando dinero seguir con él.

Cuándo deberías parar y probar GPT-5.4 mini

Aquí está la aclaración que faltaba en muchas páginas.

Si llegaste a esta comparación porque querías algo más barato que GPT-5.4 para un sistema nuevo, la documentación actual no te manda primero a GPT-5 mini. Te manda a GPT-5.4 mini.

Eso importa sobre todo en cuatro casos. El primero es un producto nuevo de baja latencia. La página actual de GPT-5 mini dice que la mayoría de nuevos builds de baja latencia y alto volumen deberían empezar por GPT-5.4 mini.

El segundo es la arquitectura de subagentes. La página del 17 de marzo describe precisamente a GPT-5.4 como modelo de planificación y juicio final, y a GPT-5.4 mini como modelo para tareas más estrechas ejecutadas en paralelo. Si ese es tu patrón, la comparación de futuro es otra.

El tercero es la migración desde rutas pequeñas anteriores como o4-mini o GPT-4.1 mini. La guía latest-model dice explícitamente que GPT-5.4 mini es una gran reemplazante de esas rutas.

El cuarto es el uso estilo Codex. En esa misma página de lanzamiento OpenAI dice que GPT-5.4 mini está disponible en Codex app, CLI, IDE extension y web, y que en Codex consume solo el 30% de la cuota de GPT-5.4. Es una señal bastante fuerte de cuál es hoy la rama pequeña moderna.

Reglas prácticas de routing para equipos

Si necesitas una tabla operativa para el equipo, usa esta:

| Trabajo | Elección por defecto | Por qué | Qué probar antes de cambiar |

|---|---|---|---|

| Repositorios largos o documentos grandes | GPT-5.4 | 1.05M de contexto y mucha mejor señal oficial en contexto largo | Si tu stack usa de verdad más de 400K de forma efectiva |

| Coding con herramientas y workflows agentic | GPT-5.4 | Tool surface más amplia y mucha ventaja en Toolathlon y Terminal-Bench | Si puedes mover subtareas estrechas a GPT-5.4 mini |

| Texto barato y muy estable | GPT-5 mini | 10x menos en input y 7.5x menos en output | Si GPT-5.4 mini mejora lo suficiente calidad o latencia |

| Producto nuevo de baja latencia | GPT-5.4 mini primero | Es la ruta pequeña que recomiendan hoy los docs | Si realmente necesitas contexto flagship o tool depth |

| Arquitectura mixta con una ruta premium y otra barata | GPT-5.4 + GPT-5.4 mini | Encaja mejor con el árbol actual de producto | Si un carril heredado de GPT-5 mini sigue rentando en coste real |

Si quieres una regla aún más corta: usa GPT-5.4 cuando el caso duro define el producto; mantén GPT-5 mini solo cuando el caso barato define el producto; y si ninguna de las dos frases encaja del todo, probablemente tu evaluación correcta sea GPT-5.4 mini.

Si estás comparando dentro del árbol actual de OpenAI, merece la pena leer también GPT-5.4 vs GPT-5.4 mini después de resolver este keyword.

FAQ

¿GPT-5 mini está deprecada?

No. A fecha de 20 de marzo de 2026, GPT-5 mini sigue teniendo página oficial de modelo y precios actuales. El punto no es que haya desaparecido, sino que ya no es la opción pequeña de futuro que la propia documentación recomienda primero para la mayoría de builds nuevos.

¿GPT-5.4 siempre merece el coste extra?

No. Si el workload es estrecho, estable y claramente cost-first, GPT-5.4 puede ser demasiado. La razón para pagarla no es el prestigio, sino reducir reintentos, recuperar contexto largo y desbloquear una superficie de herramientas más rica.

¿Cuál es la diferencia práctica más grande entre GPT-5.4 y GPT-5 mini?

La diferencia práctica más grande es la combinación de mucho más contexto, cutoff bastante más reciente, tool surface bastante más amplia y un rol de producto pensado para trabajo agentic y profesional. Esa combinación cambia el rango operativo del sistema.

¿Cuándo debo comparar GPT-5.4 con GPT-5.4 mini en vez de GPT-5 mini?

Cuando tu objetivo real es elegir una ruta premium y una ruta pequeña actuales para trabajo nuevo. Si empiezas en 2026 y quieres una rama pequeña moderna, GPT-5.4 mini suele ser la comparación más relevante.

¿Qué hago si ya uso GPT-5 mini en producción?

No migres a ciegas. Mide dónde te está costando dinero hoy: calidad, herramientas, contexto o fiabilidad. Si la ganancia de GPT-5.4 es pequeña y la subida de gasto es grande, mantener GPT-5 mini puede seguir siendo racional. Si el sistema está derivando hacia agentes, herramientas más ricas o contextos mucho mayores, la migración se vuelve bastante más fácil de defender.