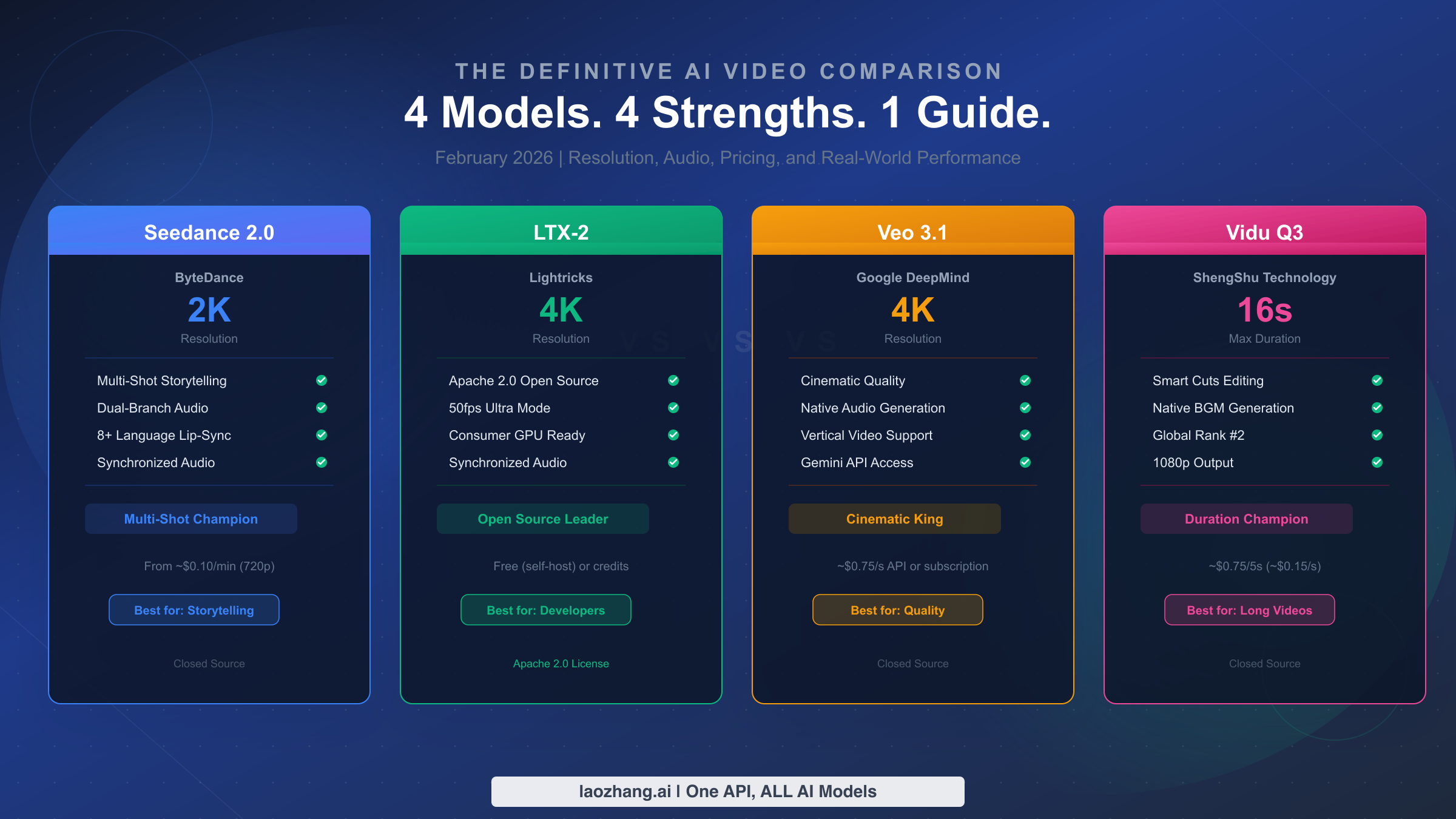

Среди четырёх ведущих AI-генераторов видео, выпущенных в начале 2026 года, каждая модель занимает свою нишу: Seedance 2.0 лидирует в многокадровом повествовании с нативным 2K-выходом и синхронизацией губ на 8 языках, LTX-2 является единственным полностью открытым решением, предлагающим 4K при 50fps на потребительских GPU, Veo 3.1 обеспечивает кинематографическое качество 4K от Google с нативным звуком, а Vidu Q3 выделяется генерацией 16-секундных клипов и интеллектуальной функцией Smart Cuts. Это руководство сравнивает все четыре модели по разрешению, звуку, ценам и реальной производительности, чтобы помочь вам выбрать оптимальную модель для вашего рабочего процесса.

Краткое содержание

Прежде чем углубляться в детали, вот сводная таблица, которая отражает ключевые различия всех четырёх моделей. Каждая из них была выпущена в период с 6 января по 8 февраля 2026 года, и каждая ориентирована на принципиально разные сценарии использования. Понимание этих различий сэкономит вам часы исследований, потому что «лучшая» модель полностью зависит от того, что вы создаёте, сколько готовы потратить и нужен ли вам API-доступ или готовый пользовательский продукт.

| Характеристика | Seedance 2.0 | LTX-2 | Veo 3.1 | Vidu Q3 |

|---|---|---|---|---|

| Разработчик | ByteDance | Lightricks | Google DeepMind | ShengShu Technology |

| Дата выпуска | 8 фев 2026 | 6 янв 2026 | 13 янв 2026 | 30 янв 2026 |

| Макс. разрешение | 2K (2048x1080) | До 4K | До 4K | 1080p |

| Макс. длительность | Многокадровый режим | 6-10 с (скоро 15 с) | 8 с | 16 с |

| Частота кадров | 24fps | До 50fps | 24fps | 24fps |

| Звук | Двухканальная синхронизация, 8+ языков | Синхронизированный звук | Нативный звук | Нативный звук + фоновая музыка |

| Open Source | Нет | Да (Apache 2.0) | Нет | Нет |

| Начальная цена | ~$0.10/мин (720p) | Бесплатно (self-host) | Подписка Google AI Pro | ~$0.75/5 с |

Ключевые выводы: Если ваш приоритет — многосценарные истории с синхронизированным диалогом, Seedance 2.0 не имеет равных. Если вам нужен полный контроль над пайплайном с open-source свободой и 4K-выходом, LTX-2 — очевидный выбор. Если кинематографическое качество в 4K с поддержкой экосистемы Google важнее всего, Veo 3.1 оправдает ожидания. А если вам нужна максимальная длительность одного клипа с встроенным интеллектуальным монтажом, Vidu Q3 — единственная модель, генерирующая до 16 секунд нативно.

Seedance 2.0 — многокадровая революция от ByteDance

ByteDance выпустила Seedance 2.0 8 февраля 2026 года, и модель сразу выделилась среди конкурентов возможностью, которой нет ни у одной из них: нативная многокадровая генерация видео. В то время как конкурирующие модели создают отдельные непрерывные клипы, Seedance 2.0 способна генерировать связные многосценарные повествования, в которых персонажи, локации и сюжетные линии сохраняют целостность между кадрами. Это не просто склейка клипов на постпродакшне — модель архитектурно понимает нарративную структуру и создаёт переходы, ракурсы камеры и композиции сцен, которые выглядят так, словно их снял профессиональный режиссёр.

Техническая основа Seedance 2.0 построена на двухканальной аудиоархитектуре, которая обрабатывает диалог и окружающие звуки через отдельные нейросетевые пути, а затем объединяет их в единый выход. На практике это означает, что модель может генерировать персонажа, говорящего на одном из восьми поддерживаемых языков с точной синхронизацией губ, одновременно создавая контекстуально подходящие фоновые звуки — шаги по гравию, дождь за окном, шум толпы в кафе. Большинство конкурентов обрабатывают звук как единый недифференцированный поток, что приводит к «грязному» выходу, где диалог конкурирует со звуковыми эффектами. Разделение потоков в Seedance 2.0 обеспечивает заметно более чистый звук с отчётливым пространственным расположением каждого слоя. Если вас интересует, как эта модель соотносится с другими лидерами, наше сравнение Seedance 2 с Sora 2 и Kling 3 предоставляет дополнительный контекст о позициях ByteDance в общей картине рынка.

Потолок разрешения в 2K (2048x1080) ставит Seedance 2.0 ниже моделей с поддержкой 4K — LTX-2 и Veo 3.1, — но этот компромисс осознанный. ByteDance оптимизировала скорость генерации и многокадровую когерентность, а не чистое количество пикселей. Типичная 2K-последовательность из нескольких кадров генерируется примерно за 60 секунд, что сопоставимо с моделями, создающими одиночные клипы аналогичного разрешения. Для создателей контента в соцсетях, которые распространяют материалы на платформах, сжимающих до 1080p, потолок в 2K редко становится практическим ограничением. Настоящий вопрос в том, нужна ли вам именно многокадровая функция повествования, которая делает Seedance 2.0 уникальным, или вам лучше подойдёт модель, максимизирующая разрешение или длительность.

Ценообразование следует многоуровневой структуре, масштабируемой по разрешению: примерно $0.10 в минуту при 720p, $0.30 в минуту при 1080p и $0.80 в минуту при полном 2K-выходе (NxCode guide, февраль 2026). Это делает Seedance 2.0 самым доступным облачным вариантом при низких разрешениях, особенно для создателей, производящих большие объёмы контента для соцсетей, где 720p или 1080p вполне достаточно. Синхронизация губ на 8 языках добавляет особую ценность для международных создателей контента, которым нужно локализовать видео для разных рынков без перезаписи озвучки или ручной корректировки движений губ — процесса, традиционно требующего дорогостоящего постпродакшна.

LTX-2 — 4K-мощь с открытым исходным кодом

Lightricks выпустила LTX-2 6 января 2026 года, сделав её первой моделью в нашем сравнении, вышедшей на рынок, и она появилась с предложением, фундаментально меняющим экономику генерации видео с помощью ИИ: LTX-2 является полностью открытой моделью под лицензией Apache 2.0. Это означает, что вы можете скачать веса модели, запустить их на собственном оборудовании, модифицировать архитектуру и интегрировать в коммерческие продукты, не платя ни доллара за API или лицензии. Для разработчиков, встраивающих генерацию видео в свои продукты, это не маргинальное преимущество — оно полностью устраняет самую крупную статью постоянных расходов во всём рабочем процессе.

Технические характеристики LTX-2 действительно впечатляют для модели с открытым кодом. Она поддерживает выходное разрешение до 4K, частоту кадров до 50fps в уровне Ultra и создаёт синхронизированный звук вместе с видеовыходом. Модель работает в трёх уровнях — Fast, Pro и Ultra, — каждый из которых балансирует скорость генерации и качество с разрешением. Уровень Fast генерирует клипы низкого разрешения за секунды, подходящие для предварительного просмотра и итераций. Уровень Pro обрабатывает 1080p при 24fps для работы производственного качества. Уровень Ultra раскрывает полные возможности 4K при 50fps для проектов, где максимальная чёткость критична. Текущая максимальная длительность — от 6 до 10 секунд в зависимости от уровня, и Lightricks официально объявила, что генерация 15-секундных клипов появится в ближайшем обновлении.

Главный вопрос, на который должен ответить каждый потенциальный пользователь LTX-2, — насколько практичен self-hosting для его ситуации, и честный ответ требует расчётов. Запуск LTX-2 на полных возможностях требует GPU с минимум 24 ГБ VRAM — NVIDIA RTX 4090 или аналог. Если вы уже владеете таким оборудованием, маржинальная стоимость каждого видео — это, по сути, затраченная электроэнергия, что составляет доли цента за клип. Если вам нужно арендовать GPU, такие сервисы, как RunPod и Vast.ai, предлагают инстансы RTX 4090 примерно за $0.40-0.60 в час, а генерация 10-секундного 1080p-клипа обычно занимает 2-4 минуты вычислительного времени. Это примерно $0.02-0.04 за клип — значительно дешевле любого облачного API, но требует технической экспертизы для настройки и поддержки инфраструктуры. Lightricks также предлагает LTX Studio — облачную платформу с кредитной системой для тех, кто хочет качество LTX-2 без управления собственным GPU-развёртыванием, хотя и по более высокой стоимости за видео, сопоставимой с конкурирующими облачными API.

Лицензия Apache 2.0 несёт стратегические преимущества помимо непосредственной экономии. Поскольку вы контролируете модель и развёртывание, вы никогда не подвержены ограничениям по количеству запросов к API, политикам использования, ограничениям контента или изменениям цен, навязываемым сторонними провайдерами. Для студий, интегрирующих генерацию видео в свой продакшн-пайплайн, такая независимость от внешних провайдеров устраняет целую категорию бизнес-рисков, которые закрытые модели несут по определению. Активное open-source сообщество вокруг LTX-2 также означает регулярное появление community-contributed fine-tune-моделей, оптимизаций и интеграций, расширяющих возможности модели способами, которые единый корпоративный провайдер не может обеспечить.

Veo 3.1 — кинематографический 4K-движок от Google

Google DeepMind выпустил Veo 3.1 13 января 2026 года, и эта модель представляет собой наивысший потолок качества в нашем сравнении. Когда вам нужен материал, который выглядит так, будто его снял профессиональный оператор — с натуралистичным освещением, физически точным движением и кинематографической глубиной резкости — Veo 3.1 стабильно превосходит все остальные модели в слепых оценках качества. Модель занимает примерно ELO 1220 в бенчмарке Video Arena (по состоянию на февраль 2026 года), что ставит её в топ-3-4 среди моделей генерации видео в мире. Для детального сравнения Sora 2 и Veo 3.1, включая анализ качества «лицом к лицу», мы подготовили отдельное руководство.

Veo 3.1 доступна в двух вариантах через систему подписок Google AI. Вариант Fast, включённый в тариф Google AI Pro, генерирует 8-секундные видео с нативным звуком на хорошем уровне качества с быстрым откликом. Стандартный Veo 3.1, доступный с тарифом Google AI Ultra, обеспечивает кинематографическое качество высшего уровня в разрешении до 4K с такой же максимальной длительностью 8 секунд и нативной генерацией звука (официальная страница Gemini, верифицировано 10 февраля 2026 года). Оба варианта поддерживают вертикальное видео — деталь, имеющая огромное значение для создателей контента, ориентированного на TikTok, Instagram Reels и YouTube Shorts, где вертикальный формат является ожидаемым стандартом, а не обрезанным компромиссом.

Одной из наиболее отличительных функций Veo 3.1 является «Ingredients to Video», которая позволяет предоставить несколько референсных изображений — портрет персонажа, фото локации, стилевой образец — и получить от модели связное видео, включающее элементы из всех входных данных. Это действительно полезно для брендового контента, где сгенерированное видео должно соответствовать существующим визуальным ассетам, или для нарративных проектов, где необходима консистентность персонажей между сценами. В то время как Seedance 2.0 решает задачу многосценарной согласованности через свою многокадровую архитектуру, Veo 3.1 подходит к проблеме со стороны входных данных, позволяя вам контролировать визуальные «ингредиенты», составляющие каждую генерацию.

Для программного доступа Veo 3.1 доступна через Gemini API, что упрощает интеграцию в существующие приложения, уже использующие AI-инфраструктуру Google. Цена API — примерно $0.75 за секунду сгенерированного видео (официальная документация API, февраль 2026 года), что размещает Veo 3.1 в премиальном сегменте рынка: 10-секундный клип стоит около $7.50 через API. Однако модель подписки через тарифы Google AI Pro и Ultra предлагает значительно лучшую экономику для регулярных пользователей, генерирующих несколько видео в месяц. Максимальная длительность 8 секунд является наиболее заметным ограничением: она короче 16 секунд Vidu Q3 и лишена многокадровых возможностей Seedance 2.0, а значит для контента длительностью более 8 секунд вам придётся склеивать клипы в постпродакшне.

Vidu Q3 — чемпион по длительности в 16 секунд

ShengShu Technology выпустила Vidu Q3 30 января 2026 года, и её ключевая характеристика сразу выделяет модель на фоне конкурентов: максимальная длительность генерации 16 секунд, что вдвое и более превышает возможности любой другой модели в этом списке. Для типов контента, где важна временная непрерывность — демонстрации продуктов, панорамные сцены для установления места действия, монологи персонажей или любой нарратив, требующий более 8 секунд развития — Vidu Q3 устраняет необходимость склейки нескольких клипов, которую требуют другие модели. Модель занимает 2-е место в мире и 1-е среди моделей китайского происхождения в бенчмарке Artificial Analysis (январь 2026 года), подтверждая, что увеличенная длительность не достигается в ущерб визуальному качеству.

Smart Cuts — это функция, превращающая Vidu Q3 из простого генератора длинных клипов в полноценного интеллектуального помощника по монтажу. Вместо создания единого непрерывного 16-секундного кадра Smart Cuts интеллектуально сегментирует сгенерированный контент на логические сцены с подходящими переходами, фактически создавая черновой монтаж по одному промпту. Это отражает подход профессионального монтажёра к исходному материалу: определение естественных точек разрыва, варьирование композиции между склейками и поддержание нарративного потока по всем сегментам. Для одиночных создателей контента, которым не хватает опыта или времени на монтаж, Smart Cuts сокращает разрыв между сгенерированным результатом и публикуемым контентом эффективнее, чем постпроцессинг любой другой модели.

Нативная генерация фоновой музыки дополнительно отличает Vidu Q3 от конкурентов. Хотя все четыре модели в этом сравнении создают ту или иную форму звукового сопровождения, Vidu Q3 — единственная, генерирующая контекстуально подходящую фоновую музыку как нативный выход. Модель анализирует визуальный контент и промпт для подбора музыкальных характеристик — темп, настроение, инструментовка — которые дополняют сцену. Это особенно ценно для контента в соцсетях, где музыка не просто желательна, а необходима для вовлечения, и где отдельный поиск лицензированной музыки добавляет как затраты, так и сложность рабочего процесса. Качество диалогового звука в Vidu Q3 конкурентно на уровне остальных трёх моделей, а добавление нативной фоновой музыки обеспечивает полный аудиопакет, которого другие пока не могут предложить.

При максимальном разрешении 1080p Vidu Q3 уступает и LTX-2, и Veo 3.1 по количеству пикселей. Это значимое ограничение для профессионального продакшна, где 4K-доставка является стандартом, но для подавляющего большинства контента в соцсетях и вебе 1080p остаётся практическим потолком, который платформы фактически отображают. Ценовая модель — примерно $0.75 за 5 секунд генерации при 1080p, что нормализуется до $1.50 за 10-секундный клип (сравнение WaveSpeedAI, январь 2026 года) — позиционирует Vidu Q3 конкурентоспособно с учётом уникального сочетания длительности и функций, особенно когда вы учитываете монтаж Smart Cuts и генерацию фоновой музыки, для которых в противном случае потребовались бы отдельные инструменты и дополнительные расходы.

Практическое преимущество рабочего процесса Vidu Q3 наиболее очевидно при сравнении усилий, необходимых для создания 30-секундного ролика для соцсетей на всех четырёх моделях. С Veo 3.1 вам нужно сгенерировать четыре отдельных 8-секундных клипа, тщательно составить промпт для каждого ради визуальной и тональной согласованности, а затем склеить их в редакторе, параллельно подбирая фоновую музыку. С Seedance 2.0 многокадровая функция обеспечивает непрерывность, но музыку всё равно придётся искать отдельно. С LTX-2 вы столкнётесь с тем же процессом поклиповой сборки плюс накладные расходы на управление инфраструктурой. С Vidu Q3 вы генерируете два 16-секундных клипа, которые уже включают сегментацию Smart Cuts и нативную фоновую музыку, а затем обрезаете до нужной длины — рабочий процесс, который может занять пять минут по сравнению с 30 минутами и более при использовании альтернатив. Эта экономия времени многократно накапливается для создателей, выпускающих контент ежедневно, и объясняет, почему Vidu Q3 быстро набрала популярность именно среди высокопроизводительных создателей контента для соцсетей, несмотря на то, что не лидирует по разрешению или кинематографическому качеству.

Прямое сравнение: разрешение, звук и многокадровый режим

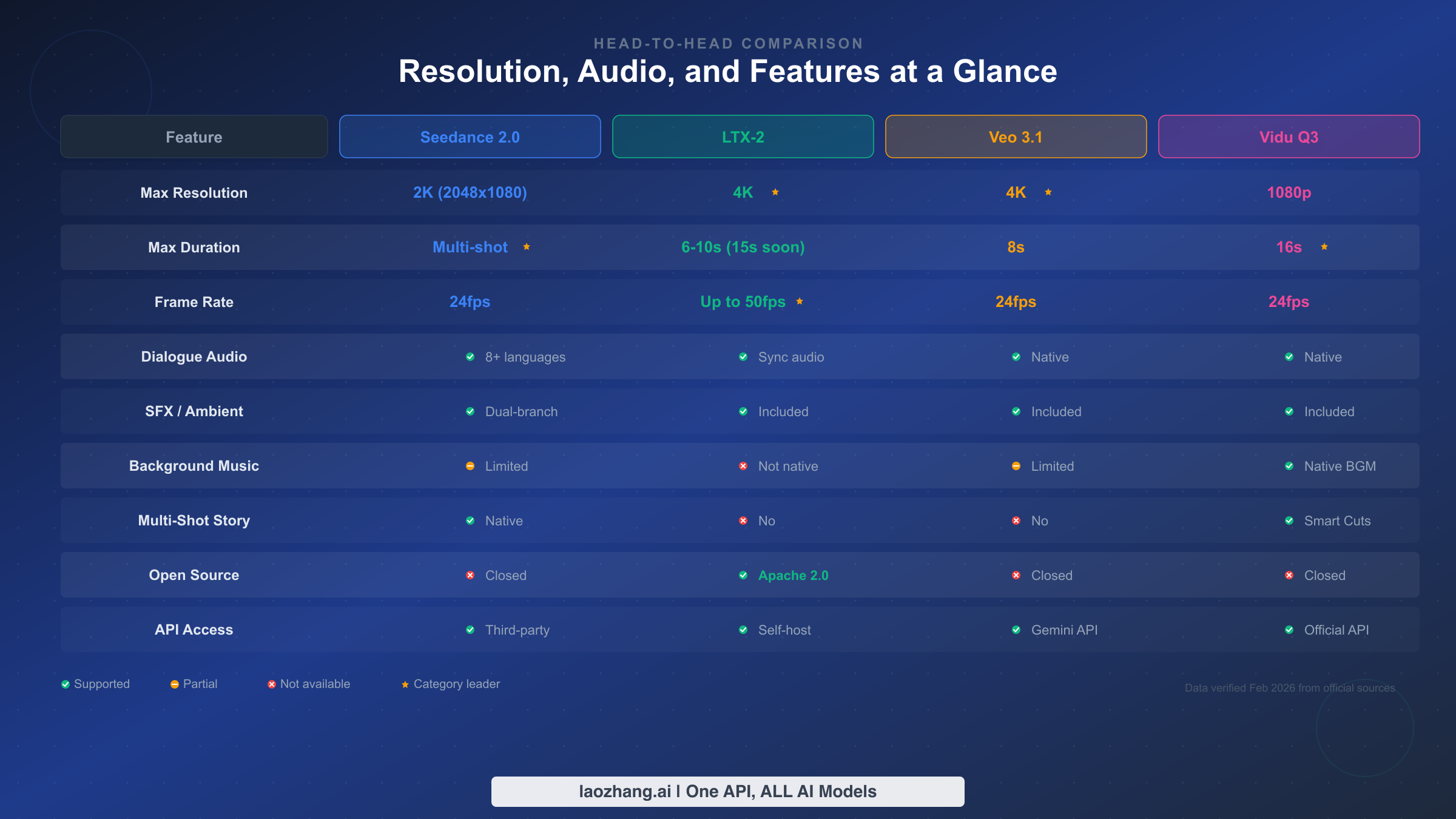

Теперь, когда каждая модель рассмотрена по отдельности, ключевой вопрос — как они соотносятся напрямую по параметрам, наиболее важным для производственных решений. Разрешение, звуковые возможности и многокадровые функции представляют три оси, по которым эти модели расходятся наиболее разительно, и понимание этих различий в совокупности — а не по отдельности — отличает осознанный выбор от случайного решения.

Разрешение рассказывает лишь часть истории. LTX-2 и Veo 3.1 заявляют 4K-выход, но практическое качество на этом разрешении значительно различается. 4K-выход Veo 3.1 демонстрирует кинематографическую глубину и натуралистичное освещение, которые обеспечили модели лидирующие позиции в бенчмарках, тогда как 4K-выход LTX-2 — впечатляющий для модели с открытым кодом — показывает чуть больше артефактов в области мелких деталей, таких как волосы, вода и текстуры ткани. 2K-потолок Seedance 2.0 резкий и чистый в рамках своего класса разрешения, а 1080p-выход Vidu Q3 хорошо оптимизирован для целевой платформы — соцсетей. Иерархия разрешения Veo 3.1 > LTX-2 > Seedance 2.0 > Vidu Q3 очевидна на бумаге, но на практике разрыв резко сужается, когда контент просматривается на мобильных устройствах при сжатых битрейтах.

| Аудиовозможность | Seedance 2.0 | LTX-2 | Veo 3.1 | Vidu Q3 |

|---|---|---|---|---|

| Диалог | 8+ языков с lip-sync | Базовая синхронизация | Нативная генерация | Нативная генерация |

| Звуковые эффекты | Двухканальный (отдельно от диалога) | Включён в аудиопоток | Включён в аудиопоток | Включён в аудиопоток |

| Окружающий звук | Контекстная генерация | Контекстная генерация | Контекстная генерация | Контекстная генерация |

| Фоновая музыка | Ограниченно | Нет нативной | Ограниченно | Нативная генерация BGM |

| Аудиоархитектура | Двухканальная (диалог + окружение) | Единый поток | Единый поток | Единый поток + BGM-дорожка |

Звук — истинный дифференциатор 2026 года. В 2025 году основным полем битвы для AI-видеомоделей было разрешение. В 2026 году нативное качество звука стало функцией, которая наиболее резко разделяет эти четыре модели. Двухканальная архитектура Seedance 2.0 создаёт самый чистый диалог, поскольку обрабатывает речь и звуки окружения независимо, предотвращая «грязное» микширование, характерное для одноканальных подходов. Veo 3.1 генерирует звук, который звучит наиболее естественно и кинематографично, с окружающими звуками, подлинно соответствующими визуальной сцене. Vidu Q3 побеждает в полноте, включая генерацию фоновой музыки, которую ни одна другая модель не предлагает нативно. Звук LTX-2 функционален, но представляет область с наибольшим пространством для улучшений со стороны сообщества, так как open-source модель продолжает получать вклад, улучшающий её аудиовозможности.

Многокадровый режим и возможности повествования создают самый широкий разрыв. Seedance 2.0 — единственная модель с настоящей нативной многокадровой генерацией, где модель сама создаёт связные многосценарные нарративы. Функция Smart Cuts в Vidu Q3 обеспечивает интеллектуальную сегментацию сгенерированного контента, что достигает схожего монтажного результата, но через иной архитектурный подход: вместо генерации нескольких кадров как единой последовательности она создаёт один длинный клип, а затем определяет, где разместить склейки и переходы. LTX-2 и Veo 3.1 создают одиночные непрерывные клипы и требуют внешних монтажных процессов для многосценарного контента, что делает их менее подходящими для нарративных проектов, если вы не готовы вкладываться в постпродакшн-сборку. Это различие наиболее значимо для типов контента, рассказывающих истории — брендовых нарративов, обучающих пошаговых руководств, демонстраций продуктов с нескольких ракурсов — где когерентность между кадрами напрямую влияет на понимание и вовлечённость зрителей.

Скорость генерации значительно варьируется между моделями и напрямую влияет на творческие итерации. Когда вы исследуете промпты и уточняете творческое направление, время между нажатием «генерировать» и получением результата определяет, сколько итераций вы можете реально протестировать. Уровень Fast LTX-2 создаёт клипы предварительного качества за секунды, позволяя быструю экспериментацию перед фиксацией на более качественную генерацию в режимах Pro или Ultra. Многокадровые последовательности Seedance 2.0 занимают около 60 секунд при 2K-разрешении, что разумно для сложности создания когерентного многосценарного выхода. Время генерации Veo 3.1 и Vidu Q3 зависит от нагрузки серверов и выбранного уровня качества, но оба обычно выдают результаты в течение 1-3 минут для стандартных запросов. Для рабочих процессов с интенсивным экспериментированием — перебор промптов, ракурсов камеры и стилевых директив — многоуровневый подход к скорости LTX-2 обеспечивает лучший цикл творческих итераций.

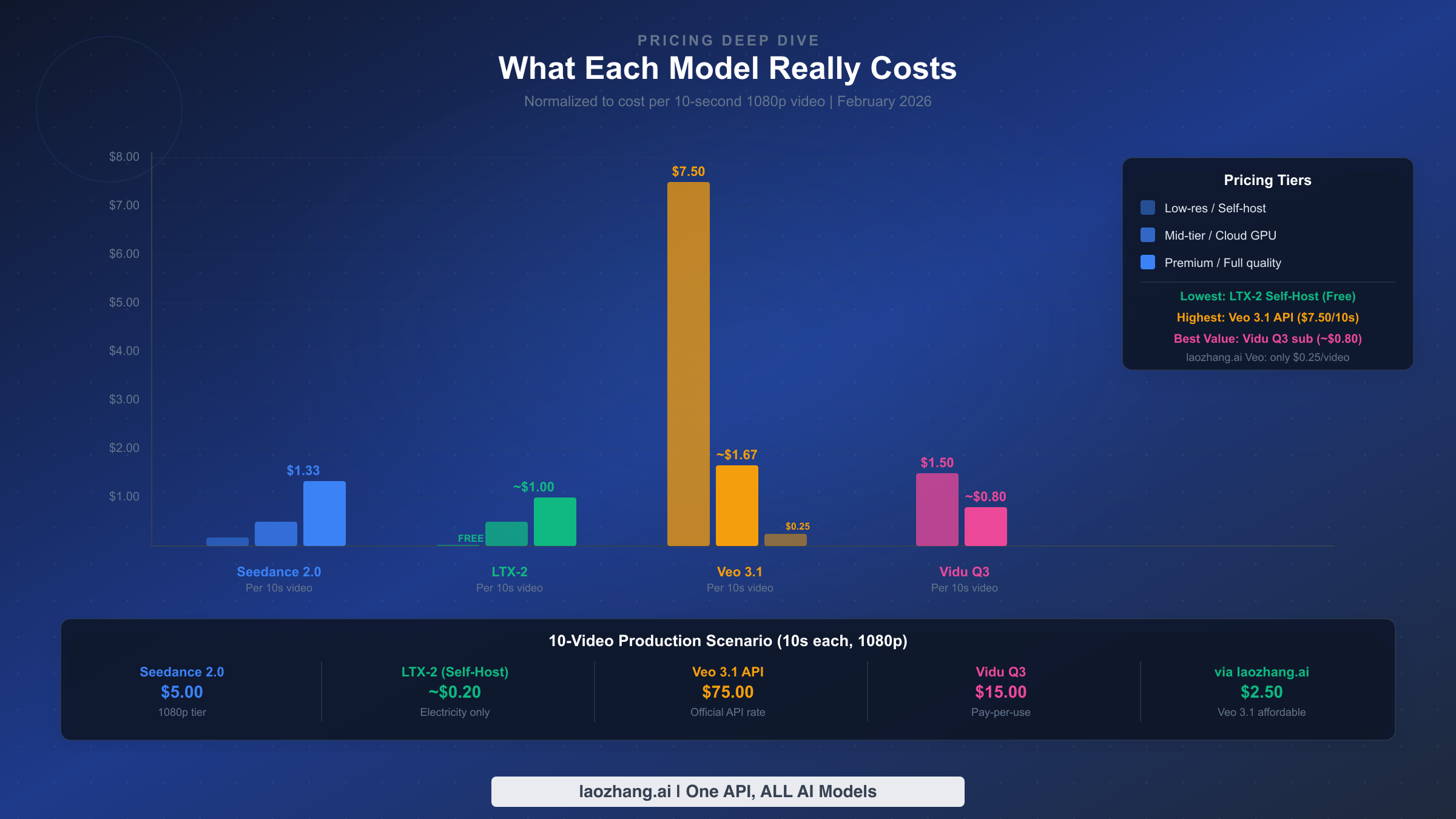

Сколько на самом деле стоит каждая модель: детальный анализ цен

Ценообразование — это то, где абстрактные различия между моделями превращаются в конкретные бизнес-решения, и это также область, где сравнение становится наиболее сложным, поскольку каждая модель использует принципиально иную структуру ценообразования. Приведение всех четырёх моделей к общей единице — стоимость 10-секундного 1080p-видео — раскрывает различия от практически бесплатного до премиального, с рядом нюансов, которые заглавные цифры не отражают.

Seedance 2.0 использует простую поминутную модель ценообразования, масштабируемую по разрешению. При 720p стоимость составляет примерно $0.10 в минуту, то есть 10-секундный клип обходится примерно в $0.017 — практически незначительная сумма для отдельных создателей. При 1080p стоимость возрастает до примерно $0.30 в минуту ($0.05 за 10 секунд), а при полном 2K-разрешении достигает $0.80 в минуту ($0.13 за 10 секунд). Этот многоуровневый подход поощряет создателей, которые подбирают разрешение под свою платформу дистрибуции, а не используют максимальное качество по умолчанию, и делает Seedance 2.0 самым дешёвым облачным вариантом для высокообъёмного производства при 720p или 1080p (NxCode guide, февраль 2026).

LTX-2 представляет наиболее сложный ценовой ландшафт, поскольку «бесплатно» сильно зависит от вашей инфраструктурной ситуации. Self-hosting на собственном оборудовании обходится только в электричество — доли цента за клип. Аренда GPU на RunPod или Vast.ai стоит примерно $0.40-0.60 в час за инстанс RTX 4090, что составляет $0.02-0.04 за 10-секундный 1080p-клип. Облачная платформа LTX Studio использует кредитную систему, стоимость которой составляет примерно $1.00 за 10-секундный клип с учётом генерации звука. Вариант self-hosting значительно дешевле любого конкурента, но первоначальные инвестиции в оборудование (RTX 4090 стоит $1600-2000) или техническая экспертиза, необходимая для развёртывания облачных GPU, создают барьер, который фактически невидим при сравнении стоимости за клип.

Veo 3.1 занимает премиальную нишу с ценой API примерно $0.75 за секунду сгенерированного видео, что делает 10-секундный клип стоимостью около $7.50 через Gemini API (официальная документация API, верифицировано 10 февраля 2026 года). Модель подписки через тарифы Google AI Pro и Ultra значительно снижает эту стоимость для регулярных пользователей, при этом подписка в среднем обходится примерно в $1.67 за 10-секундный клип в зависимости от ежемесячного объёма генерации. Подробный разбор представлен в статье стоимость Veo 3.1 за секунду. Для разработчиков, ищущих более доступный API-доступ к Veo 3.1, сторонние провайдеры, такие как laozhang.ai, предлагают Veo 3.1 по $0.15 за запрос для fast-варианта и $0.25 за запрос для стандартного варианта — значительно меньше официальной стоимости API, что делает производственное использование экономически выгодным. Та же платформа также предоставляет доступ к доступным альтернативам Sora 2 API по $0.15 за запрос, обеспечивая разработчикам единую точку доступа к нескольким моделям генерации видео.

Vidu Q3 взимает примерно $0.75 за 5 секунд генерации при 1080p, что нормализуется до $1.50 за 10-секундный клип (сравнение WaveSpeedAI, январь 2026 года). С учётом монтажа Smart Cuts и нативной генерации фоновой музыки, которые иначе потребовали бы отдельных инструментов, общее ценностное предложение улучшается. Тарифные планы по подписке снижают стоимость до примерно $0.80 за клип для регулярных пользователей, что делает модель конкурентоспособной с 1080p-ценами Seedance 2.0, при этом предлагая вдвое большую длительность клипа.

Сценарий производства 10 видеороликов наглядно демонстрирует эти различия. Создание десяти 10-секундных клипов при 1080p обходится примерно в $5.00 с Seedance 2.0, $0.20-0.40 с self-hosted LTX-2, $75.00 через API Veo 3.1 (или $2.50 через laozhang.ai) и $15.00 с оплатой Vidu Q3 за использование. Эти цифры ясно показывают, что одна лишь цена не определяет правильный выбор — модель, которая стоит дороже, может сэкономить гораздо больше на постпродакшне, особенно когда нативный звук, фоновая музыка или многокадровый монтаж сокращают объём работы после генерации.

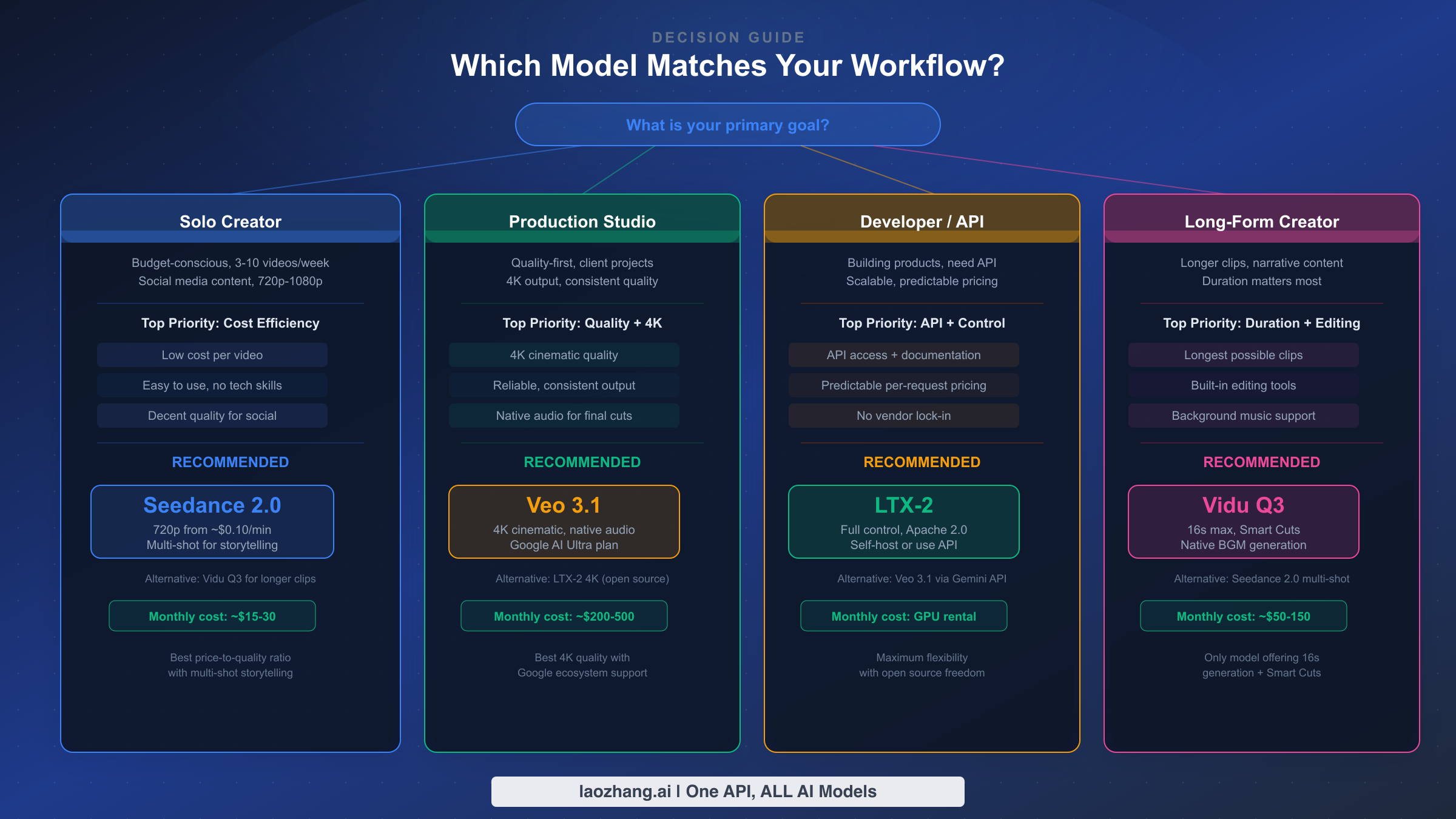

Какую модель выбрать: соответствие моделей рабочим процессам

Вся приведённая выше информация полезна лишь в том случае, если она трансформируется в конкретное решение для вашей ситуации. Вместо обобщённого вывода «всё зависит от обстоятельств» этот раздел сопоставляет четыре конкретных сценария рабочих процессов с конкретными рекомендациями моделей, основанными на реальных приоритетах каждого типа пользователей при выборе инструмента для генерации видео. Ваши реальные ограничения — бюджет, техническая компетенция, объём выпуска и требования к качеству — определяют, какие сильные стороны модели соответствуют вашим потребностям.

Одиночным создателям контента для соцсетей стоит начать с Seedance 2.0. Когда вы делаете 3-10 видеороликов в неделю для таких платформ, как TikTok, YouTube Shorts или Instagram Reels, ваше основное ограничение — стоимость за видео, а не максимальное разрешение. Уровень 720p Seedance 2.0 по $0.10 в минуту делает высокообъёмное производство действительно доступным — типичный месяц из 30 короткоформатных видео обходится менее чем в $15. Многокадровое повествование добавляет творческое измерение, помогающее вашему контенту выделиться среди одноклиповых результатов других моделей, а синхронизация губ на 8 языках открывает международную аудиторию без дополнительных затрат на производство. Если ваш контент опирается на длинные клипы с музыкой, рассмотрите Vidu Q3 как альтернативу: 16-секундная длительность и нативная генерация фоновой музыки хорошо соответствуют форматам соцсетей, где приоритетом является удержание внимания зрителя, а не визуальная чёткость.

Продакшн-студиям, работающим над клиентскими проектами, стоит инвестировать в Veo 3.1. Когда клиенты ожидают 4K-доставку, кинематографическое качество и профессиональный звук, качество выходных материалов Veo 3.1 оправдывает её премиальное ценообразование. Подписка Google AI Ultra обеспечивает предсказуемые ежемесячные расходы при регулярном производстве, а функция Ingredients to Video даёт возможность создавать контролируемый, брендово-консистентный контент, которого требует клиентская работа. Ограничение в 8 секунд требует сборки на постпродакшне для более длинных последовательностей, но у студий уже есть налаженные монтажные процессы. LTX-2 является привлекательным вторичным вариантом для студий, готовых инвестировать в GPU-инфраструктуру: 4K-выход при значительно более низкой стоимости за клип с гибкостью open-source кастомизации, хотя потолок качества не совсем соответствует Veo 3.1 для наиболее требовательных кинематографических задач.

Разработчикам, создающим продукты с генерацией видео, настоятельно рекомендуется рассмотреть LTX-2 как основную модель. Лицензия Apache 2.0 означает нулевую стоимость за запрос при self-hosting, отсутствие ограничений API, отсутствие ограничений контент-политики помимо ваших собственных и отсутствие зависимости от стороннего провайдера, который может изменить цены или условия обслуживания. Техническая нагрузка по управлению GPU-инфраструктурой — это разовые затраты на настройку, которые становятся пренебрежимыми, как только ваш пайплайн развёртывания налажен. Для разработчиков, которым нужен доступ к нескольким моделям без управления отдельной инфраструктурой, унифицированные API-платформы вроде laozhang.ai предоставляют единую точку доступа к Veo 3.1, Sora 2 и другим видеомоделям с единообразным ценообразованием и документацией, значительно упрощая интеграцию.

Создателям длинноформатного нарративного контента следует отдать приоритет Vidu Q3 для любого проекта, где длительность клипа имеет значение. Производство 60-секундного видео требует 8 отдельных клипов с Veo 3.1 (по 8 секунд), 6 клипов с LTX-2 (по 10 секунд) или всего 4 клипов с Vidu Q3 (по 16 секунд). Меньше стыков между клипами означает меньше разрывов непрерывности, меньше монтажных переходов для управления и более цельный конечный продукт. Функция Smart Cuts дополнительно сокращает постпродакшн, предоставляя интеллектуальную сегментацию в рамках каждой 16-секундной генерации, а нативная генерация фоновой музыки устраняет отдельный этап подбора и синхронизации фонового сопровождения. Для нарративного контента, где развитие сюжетной арки выигрывает от более длинных непрерывных кадров, ни одна другая модель в этом сравнении не может предложить то же, что Vidu Q3.

Итоги

Каждая из четырёх моделей представляет подлинно лучшую в своём классе возможность, которую ни один конкурент в этом сравнении не может повторить. Seedance 2.0 владеет многокадровым повествованием и многоязычной синхронизацией губ. LTX-2 владеет свободой open-source и экономикой self-hosting. Veo 3.1 владеет кинематографическим качеством и 4K-чёткостью. Vidu Q3 владеет максимальной длительностью и встроенным интеллектуальным монтажом. Ландшафт моделей в начале 2026 года созрел до уровня, когда выбор правильного инструмента означает понимание того, что конкретно нужно вам, а не погоню за единой «лучшей» моделью, которой не существует.

Ценовая реальность показывает, что самый дорогой вариант (API Veo 3.1 по $7.50 за 10 секунд) стоит в 375 раз больше самого дешёвого (self-hosted LTX-2 по ~$0.02 за 10 секунд). Этот поразительный диапазон означает, что первый вопрос в процессе принятия решения должен быть не «какая модель имеет лучшее качество», а «каков минимальный порог качества для моего проекта, и какая модель достигает этого порога при наименьшей совокупной стоимости, включая постпродакшн?» Модель, стоящая в 10 раз дороже за клип, но экономящая 30 минут монтажа на каждом клипе, на самом деле дешевле в любом рабочем процессе, где ваше время имеет стоимость.

Если вы всё ещё в раздумьях, практичный подход — начать с модели, соответствующей вашему наиболее частому сценарию использования, и расширять набор инструментов по мере эволюции потребностей. Нет штрафа за использование нескольких моделей: одиночный создатель может использовать Seedance 2.0 для ежедневного контента в соцсетях и переключаться на Veo 3.1 для отдельных премиальных проектов, тогда как разработчик может размещать LTX-2 на собственных серверах для высокообъёмной автоматической генерации и интегрировать Vidu Q3 через API для контента, требующего большей длительности. Эра выбора единой AI-видеомодели для всех нужд завершилась; ландшафт 2026 года вознаграждает пользователей, понимающих сильные стороны каждого инструмента и применяющих их стратегически.

Рынок генерации видео с помощью ИИ развивается с поразительной скоростью — все четыре модели в этом сравнении вышли в течение пятинедельного окна — и каждая, вероятно, получит значительные обновления в течение 2026 года. Open-source сообщество LTX-2 продолжит развивать улучшения качества и оптимизации. Google будет совершенствовать возможности Veo в рамках экосистемы Gemini. Стремительные итерации ByteDance над Seedance говорят о том, что многокадровые функции станут лишь более изощрёнными. А лидирующая позиция ShengShu Technology с Vidu Q3 в бенчмарках предполагает, что ещё большая длительность и более интеллектуальные функции монтажа уже на горизонте. Модель, которую вы выбираете сегодня, должна отвечать вашим текущим потребностям с осознанием того, что конкурентный ландшафт продолжит улучшать ваши возможности в будущем.

Часто задаваемые вопросы

Какой AI-генератор видео обеспечивает лучшее качество в 2026 году?

По чистому кинематографическому качеству в разрешении 4K Veo 3.1 занимает наивысшую позицию в бенчмарке Video Arena с рейтингом приблизительно ELO 1220. Однако понятие «лучшее качество» зависит от формата выхода: Seedance 2.0 создаёт самый чистый диалоговый звук благодаря двухканальной архитектуре, LTX-2 предлагает максимальную частоту кадров 50fps в режиме Ultra, а Vidu Q3 достигает лучших результатов для длинных нарративных клипов, где согласованность в течение 16 секунд важнее идеального качества каждого кадра.

LTX-2 действительно бесплатна?

Да, LTX-2 полностью открыта под лицензией Apache 2.0, и веса модели свободно загружаются с Hugging Face. Оговорка «бесплатности» состоит в том, что вам нужно GPU-оборудование для её запуска — собственное (RTX 4090 или аналог с 24+ ГБ VRAM) или арендованное облачное GPU по цене примерно $0.40-0.60 в час. Self-hosting делает стоимость каждого сгенерированного клипа равной долям цента за электроэнергию, но первоначальные инвестиции в оборудование или кривая обучения для работы с облачными GPU — это реальная стоимость.

Могу ли я использовать эти модели через API для своего приложения?

Все четыре модели предлагают ту или иную форму программного доступа. LTX-2 можно размещать на собственных серверах с полным контролем API. Veo 3.1 доступна через Gemini API по цене приблизительно $0.75 за секунду или через сторонних провайдеров по значительно более низкой стоимости. Seedance 2.0 и Vidu Q3 предлагают API-доступ через свои платформы и через сторонних агрегаторов. Для разработчиков, которым нужен унифицированный API для нескольких видеомоделей, сервисы вроде laozhang.ai предоставляют единую точку интеграции с согласованной документацией и конкурентными ценами.

Какая модель лучше всего подходит для создания контента в социальных сетях?

Для высокообъёмного производства контента в соцсетях с ограниченным бюджетом Seedance 2.0 по $0.10 в минуту (720p) предлагает лучшее соотношение цены и качества с бонусом в виде многокадрового повествования. Для контента, выигрывающего от длинных клипов и встроенной музыки, 16-секундная длительность и нативная генерация фоновой музыки Vidu Q3 делают её наиболее сильным выбором. Для премиального контента в соцсетях, где визуальное качество является главным отличием, кинематографический выход Veo 3.1 стоит выше остальных, хотя и при более высокой стоимости за клип.