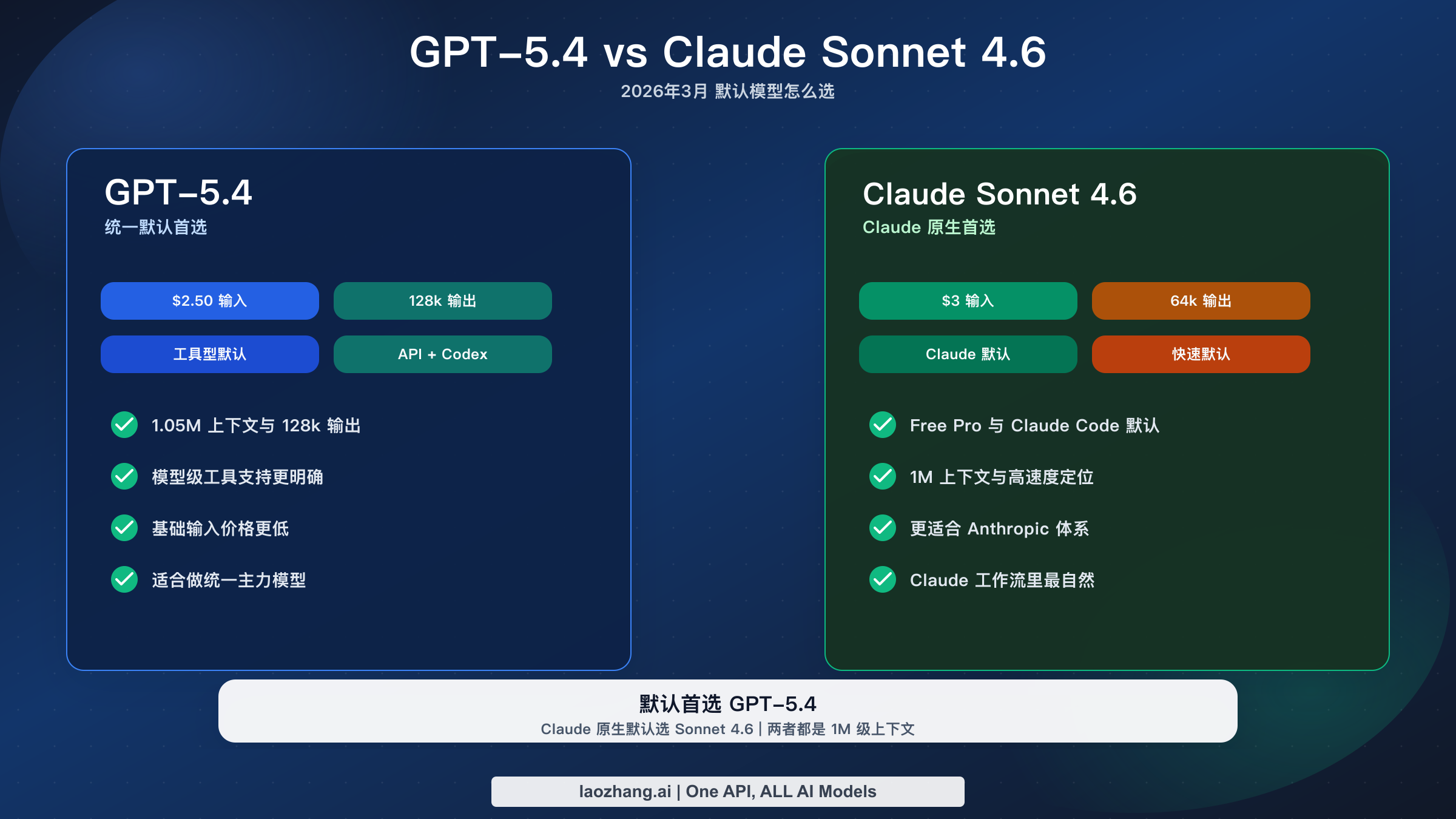

先说结论:如果你现在要给大多数开发任务选一个默认模型,GPT-5.4 更值得优先作为主力。按照 OpenAI 当前的发布页和 API 模型页,GPT-5.4 已经被明确定位为面向专业工作、编码和 agentic workflow 的主线旗舰模型。它和 Claude Sonnet 4.6 一样都处在 100 万级上下文档位。Anthropic 这组文档现在更适合用“分层读取”的方式理解:2026 年 2 月 17 日的发布页还保留着 1M 上下文处于 beta 阶段的原始表述,而当前的 models overview 已经把 Sonnet 4.6 列为 1M context、64k max output,Anthropic 当前的 context windows 指南和 2026 年 3 月 13 日 的《What's new in Claude 4.6》更新说明则表明 Sonnet 4.6 的完整 1M 上下文窗口已按标准价格正式可用。在这个前提下,GPT-5.4 依旧在 最大输出长度 上更强(128k 对 64k),模型级工具清单也公开得更完整,而且在当前官方公开的基础 API 价格里,输入价格反而比 Sonnet 4.6 更低(\$2.50 对 \$3)。

这并不意味着 Claude Sonnet 4.6 不值得用。Anthropic 在 2026 年 2 月 17 日 发布 Sonnet 4.6 时,把它定义成当前 Claude 产品线里速度与能力平衡最好的默认模型,并且把它设成 Claude Free / Pro 与 Claude Cowork 的默认档,同时也铺到了 Claude Code、API 和主流云平台。如果你的实际工作流本来就围绕 Claude.ai、Claude Code 或 Anthropic 的平台能力展开,那么 Sonnet 4.6 依旧是一个非常合理的选择。只是从“规格、价格、工具能力”这几个最容易直接比较的维度看,很多搜索结果把 Sonnet 4.6 讲得比它真实位置更有优势。

本文基于 2026 年 3 月 19 日 重新核对的 OpenAI 与 Anthropic 官方页面来写。它和大多数对比文章最大的不同点是:我会把可以直接比较的事实和不能假装精确对比的基准结论分开讲,不拿混杂的榜单硬拼一个“绝对赢家”。

要点速览

如果你只想要一句建议:把 GPT-5.4 当成默认模型更稳。只有在你的工作流天然就是 Claude-first,或者你本来就主要在 Claude Code / Claude.ai 里工作时,Claude Sonnet 4.6 才更像是“顺着生态选”的默认答案。

| 维度 | GPT-5.4 | Claude Sonnet 4.6 | 实际意义 |

|---|---|---|---|

| 发布时间 | 2026-03-05 | 2026-02-17 | 都很新,但 GPT-5.4 更新 |

| 产品定位 | OpenAI 默认旗舰,面向专业工作、编码与 agent | Anthropic 默认高能力快模型 | GPT-5.4 更像通用主力,Sonnet 4.6 更像 Claude 体系默认选项 |

| 输入价格 | $2.50 / 1M | $3 / 1M | GPT-5.4 在基础输入价格上更便宜 |

| 输出价格 | $15 / 1M | $15 / 1M | 基础输出价格持平 |

| 上下文窗口 | 1,050,000 | 1M | 长上下文能力级别接近;Anthropic 当前 models overview、context windows 指南与 3 月 13 日更新说明都支持把 Sonnet 4.6 视为标准价格下的完整 1M 上下文模型 |

| 最大输出 | 128,000 | 64,000 | GPT-5.4 更适合长单次输出 |

| 应用层可用性 | ChatGPT(以 GPT-5.4 Thinking 形式)、API 与 Codex | Claude Free / Pro 与 Claude Cowork 默认,同时覆盖 Claude Code、API、主流云平台 | Sonnet 4.6 在 Anthropic 自家产品里的可达性更强 |

| 工具形态 | 明确公开 Web search、file search、image generation、hosted shell、apply patch、MCP 等 | Anthropic 平台围绕 Sonnet 4.6 提供 adaptive thinking、compaction、search、fetch、code execution、memory 等 | GPT-5.4 更适合“一个模型吃掉大多数工具任务”的思路 |

| 最适合谁 | 想要一个默认主力模型的人 | Claude 原生工作流、Claude Code 用户 | 关键不是品牌,而是你的工作表面在哪里 |

这里最容易让人误判的是价格。很多页面默认把 Sonnet 系列当成更便宜的路线,但按照 2026 年 3 月 19 日官方公开的基础 API 定价 来看,这个判断并不成立:GPT-5.4 输入更便宜,输出价格相同。

2026年3月真正变化了什么

这组对比里,最重要的变化并不是某个榜单分数,而是两家公司对产品的定位方式。

OpenAI 在 GPT-5.4 发布页 里,明确把 GPT-5.4 写成面向专业工作的最强主线模型,并且直接说明 GPT-5.4 吸收了 GPT-5.3-Codex 的编码能力。这句话非常关键,因为它等于告诉开发者:OpenAI 希望你把 GPT-5.4 视作默认主力,而不是把“推理模型”和“编码模型”永远拆开选。

Anthropic 在 Claude Sonnet 4.6 发布页 的表达则不同。Sonnet 4.6 被定义成 Claude 家族里当前“速度与能力平衡最好”的默认高能力模型。Anthropic 强调它在编码、computer use、长上下文推理、agent planning、知识工作上都比之前的 Sonnet 更强。发布页在 2026 年 2 月 17 日 首发时把 1M 上下文窗口写成 beta,而且这段历史表述今天仍然保留在发布页上。与此同时,Anthropic 的当前活文档已经更开放:当前 models overview 列出 Sonnet 4.6 的 1M context 和 64k max output;当前 context windows 指南 写明 Claude Sonnet 4.6 与 Claude Opus 4.6 现在都已是 1M token context window 的 generally available 状态;Anthropic 2026 年 3 月 13 日 的 《What's new in Claude 4.6》 也说明 Sonnet 4.6 的完整 1M token context window 已按标准价格开放。更稳妥的理解不是“beta 说法已经消失”,而是“发布页保留了 rollout 历史,但当前模型页、context windows 指南和 3 月 13 日更新说明已经支持把 Sonnet 4.6 当作 1M context / 64k max output 模型来理解”。即便如此,GPT-5.4 仍然保留了更低的基础输入价格和更大的输出上限。同时,它被设成 Free / Pro 与 Claude Cowork 的默认选择,并覆盖 Claude Code、API 和云平台。这说明 Sonnet 4.6 更像 Anthropic 体系里的“主力默认档”,而不是用来在规格表上全面压过所有竞品。

所以,这个关键词真正对应的决策不是“谁家实验室赢了”,而是:

我现在要不要把 GPT-5.4 设成统一默认?还是我的真实工作流其实更适合留在 Claude 体系里,让 Sonnet 4.6 做主力?

这也是为什么搜索结果经常跑偏。很多页面一不小心就把问题写成 “GPT-5 vs Claude” 或者 “GPT-5.4 vs Claude Opus 4.6”,但读者真正想要的是更具体的答案:现在我到底该把哪个模型设成默认工作模型?

如果你想看 GPT-5.4 在 OpenAI 自家体系里是如何取代老的“专用编码位”的,可以继续看我们的 GPT-5.4 vs GPT-5.3-Codex 对比。

哪些能直接比,哪些不能

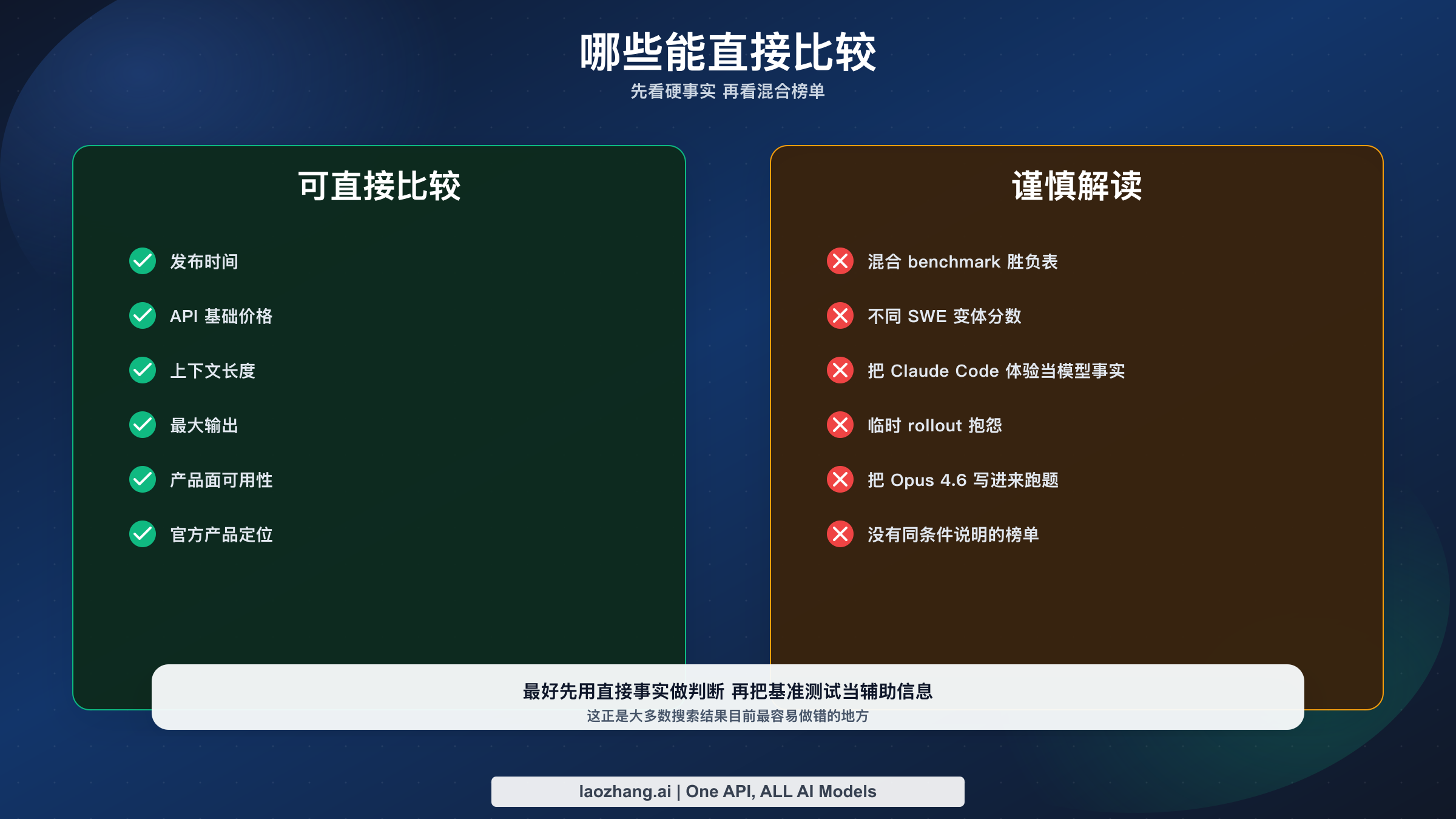

这是大多数模型对比文章最容易偷懒的地方。

下面这些项目可以直接比较,因为两家公司都公开写得很清楚:

| 可以直接比 | 原因 |

|---|---|

| 发布时间 | 两家公司都在官方发布页标明了日期 |

| API 基础输入 / 输出价格 | 两家都在官方模型或定价页公开了当前价格 |

| 上下文窗口 | 两家都给出了当前窗口大小 |

| 最大输出长度 | 两家都给出了当前输出上限 |

| 应用层与 API 可用性 | 两家公司都明确说明了在哪些产品面向用户开放 |

| 产品定位 | 发布页直接说明了模型在产品线中的角色 |

下面这些项目不能装作完全可比:

| 不能直接硬拼 | 为什么 |

|---|---|

| 随手截图的 benchmark winner 表 | OpenAI 和 Anthropic 并没有发布同一设置下的 GPT-5.4 vs Sonnet 4.6 官方对照表 |

| 来自不同变体的 SWE-bench 分数 | harness、提示词、试验轮数和 variant 经常不同 |

| Claude Code vs Codex 的体验感受 | 产品层、模型层、API 层并不是同一个问题 |

| 社区里的临时故障与配额抱怨 | 这些能反映摩擦,但不能直接证明模型能力本身 |

| 跑偏到 Opus 4.6 的文章 | 这已经不是你搜的那个 Claude 档位了 |

OpenAI 官方更愿意把 GPT-5.4 和 GPT-5.3-Codex / GPT-5.2 对比,Anthropic 官方更愿意拿 Sonnet 4.6 和旧版 Sonnet 或 Opus 体系去解释提升逻辑。也就是说,许多第三方“胜负榜”本质上是在拿不同来源、不同设置的数据拼凑一个结论,而不是站在一个公平、统一的测试框架上。

不过,这不等于 benchmark 完全没用。更准确的理解方式是:

- 先看官方规格、价格和产品定位这些硬事实。

- 再看基准测试是否真的透明、是不是同一设置。

- 最后才把社区反馈当作摩擦信号,而不是定案证据。

从这个角度看,OpenAI 的官方发布页给 GPT-5.4 一个非常强的编码与工具使用画像,例如 SWE-Bench Pro 57.7%、Terminal-Bench 2.0 75.1%、BrowseComp 82.7%、Toolathlon 54.6%。Anthropic 的方式更偏“产品表现证明”:它强调早期 Claude Code 用户对 Sonnet 4.6 的偏好显著高于 Sonnet 4.5,甚至对 Opus 4.5 也有明显偏好。这说明 Sonnet 4.6 很强,但这并不是与 GPT-5.4 完全对等的同框 benchmark。

Anthropic 自己还明确说过:在最深度的推理任务上,比如代码库重构、多智能体协调这类工作,Opus 4.6 仍然是更强的档位。这也从侧面告诉你,Sonnet 4.6 的真实位置是“Claude 体系中的高能力默认档”,而不是 Anthropic 官方定义下的终极上限。

价格、上下文长度、输出上限与工具能力

如果你是开发者,这部分通常比排行榜截图更重要。

先看价格。根据 OpenAI GPT-5.4 模型页,GPT-5.4 当前价格是 $2.50 输入、$0.25 cached input、$15 输出 / 百万 Token。根据 Anthropic 当前的 models overview,Claude Sonnet 4.6 当前价格是 $3 输入、$15 输出 / 百万 Token。也就是说,在最容易直接对比的基础 API 定价上,GPT-5.4 并不比 Sonnet 4.6 贵,反而更便宜一点。

当然,这也不是全部。OpenAI 同时公开了一个很重要的长上下文计费说明:如果 GPT-5.4 的输入超过 272K,整个 session 会按 2 倍输入 和 1.5 倍输出 计费。这意味着 GPT-5.4 的长上下文天花板虽然很高,但如果你真的长期把 prompt 顶到超长区间,它的成本会迅速上升。所以“基础输入更便宜”并不等于所有长会话都更划算。

再看上下文和输出。GPT-5.4 当前公开为 1,050,000 context window,Sonnet 4.6 在 Anthropic 当前模型总览里列为 1M tokens。发布页最初确实把 1M 写成 beta,而且那段 wording 现在还在;但今天的活文档已经更开放:Anthropic 的 context windows 指南 说明 Sonnet 4.6 的 1M token context window 已 generally available,Anthropic 2026 年 3 月 13 日 的 《What's new in Claude 4.6》 也写明 Sonnet 4.6 的完整 1M 上下文窗口按标准价格可用。所以当前更稳妥的官方读法不是忽略 beta 历史,而是承认“发布页保留 rollout 原话,同时当前模型页、context windows 指南和更新说明支持把 Sonnet 4.6 视为 1M context / 64k max output 模型”。真正拉开差距的是 最大输出:GPT-5.4 是 128k,Sonnet 4.6 是 64k。如果你经常让模型一次性输出超长分析、复杂改写或更大规模的代码变更,GPT-5.4 的余量明显更大。

最后看工具能力。GPT-5.4 的优势是 模型级支持列表公开得非常清楚:web search、file search、image generation、code interpreter、hosted shell、apply patch、skills、computer use、MCP、tool search 都在模型页里写得明白。Sonnet 4.6 的优势不是“没有工具”,而是 Anthropic 平台围绕它提供了一整套工作流能力,例如 adaptive thinking、extended thinking、context compaction、web search、fetch、code execution、memory、tool search 与 programmatic tool calling。但 Anthropic 的描述更像“平台能力围绕模型展开”,而不是一张完全等价的模型工具矩阵。

这会带来一个非常现实的区别:

- 如果你想找一个一个模型就能覆盖大多数工具型任务的默认主力,GPT-5.4 更好解释。

- 如果你已经接受了 Claude 平台的工作方式,并且主要在 Claude.ai / Claude Code 里工作,Sonnet 4.6 也完全说得通。

还有一个经常被忽略的点:Anthropic 在模型概览里把 Sonnet 4.6 的比较延迟标成 Fast,而 OpenAI 在 GPT-5.4 模型页把速度标成 Medium。这并不代表 Sonnet 4.6 在所有现实任务里都一定更快,但它至少说明 Anthropic 的产品目标很明确:Sonnet 4.6 要做那个“反应更快、能力够强的默认档”。

所以这一节真正能得出的结论是:

- API 默认主力:GPT-5.4 更强

- Claude 原生默认体验:Sonnet 4.6 更顺手

- 长输出和工具型 agent:GPT-5.4 更稳

- Anthropic 体系默认快模型:Sonnet 4.6 更自然

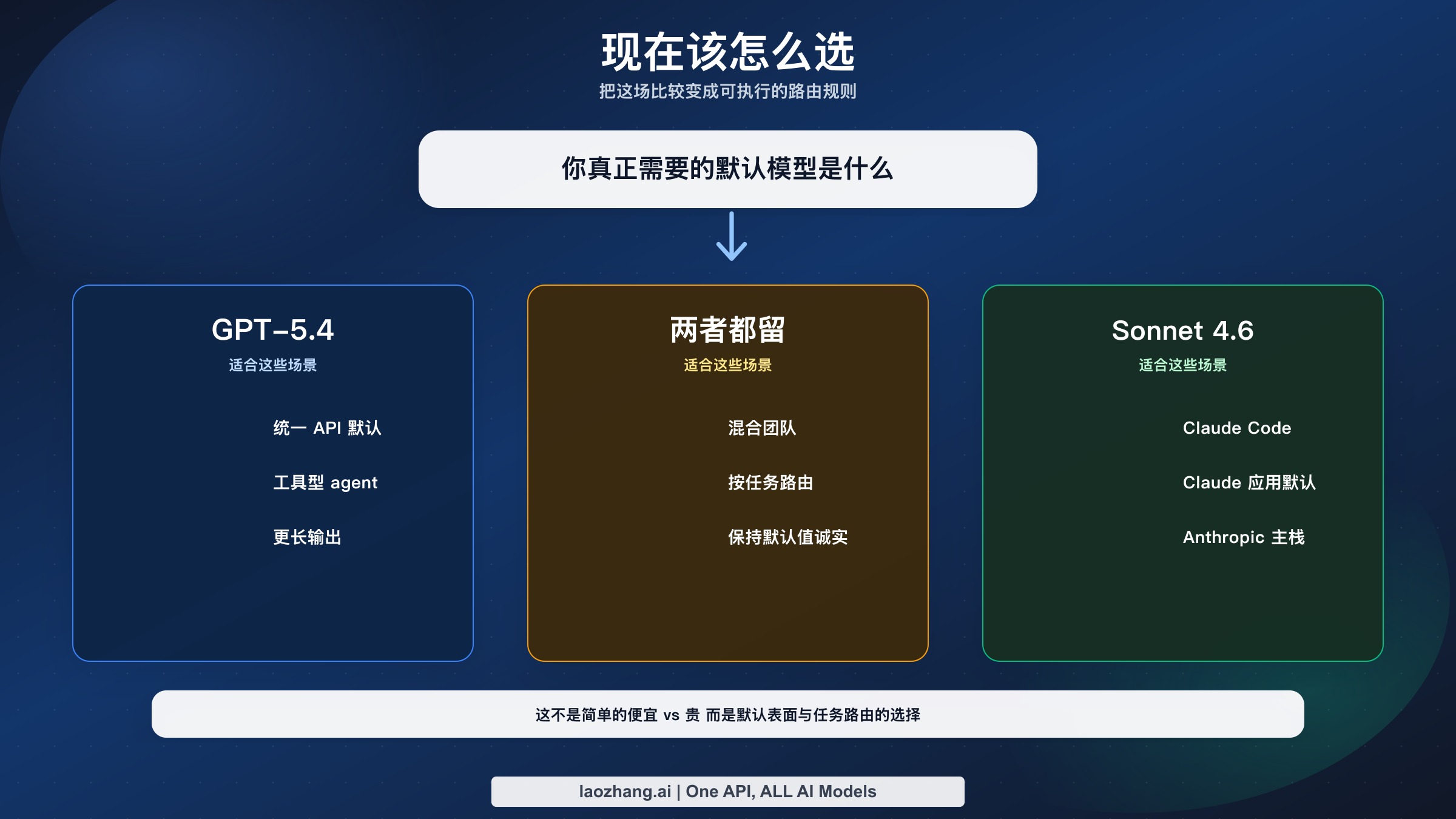

不同工作流该怎么选

把这些信息翻译成实际决策,才是这篇文章最有价值的部分。

| 工作流 | 更推荐谁 | 原因 |

|---|---|---|

| 想给 API 和 agent 统一选一个默认模型 | GPT-5.4 | 工具能力更完整、输入更便宜、最大输出更大 |

| 大代码库长上下文分析 | GPT-5.4 | 上下文级别接近,但输出空间更大 |

| 需要 search + shell + patch + MCP 的工具型工作流 | GPT-5.4 | 模型级工具支持更清晰 |

| 主要在 Claude.ai 或 Claude Code 工作 | Claude Sonnet 4.6 | 它本来就是 Anthropic 体系内的默认主力 |

| 主要依赖 Claude Free / Pro 默认体验 | Claude Sonnet 4.6 | Sonnet 4.6 已经是默认模型 |

| 团队是 Anthropic-first | Claude Sonnet 4.6 | 生态、治理和习惯更匹配 |

| 团队能按任务路由 | 两者都保留 | GPT-5.4 做默认主力,Sonnet 4.6 做 Claude 原生分流 |

如果你是个人开发者或小团队,并且真的只想选一个 API 默认模型,那么 GPT-5.4 现在通常更合理。它更新、基础输入更便宜、输出不贵于 Sonnet 4.6、最大输出更高,而且当任务从“写代码”扩展成“查文档、调工具、执行多步骤代理”时,解释成本更低。

如果你是Claude-first 团队,结论会变。你的真实问题可能根本不是“哪个裸模型更强”,而是“我们的日常开发、Agent、Code Review 已经都在 Claude 体系内,继续用 Sonnet 4.6 作为默认是不是更顺?”这种情况下,Sonnet 4.6 就是自然答案。它的定位本来就是 Anthropic 的默认高能力档,而不是一个需要被拿来和 Opus 4.6 混着看的过渡型号。

如果你是可以按任务路由的团队,最聪明的答案往往是两者都保留:

- 把 GPT-5.4 用在 repo 级规划、工具型 agent、长输出、跨工具工作流上;

- 把 Sonnet 4.6 用在 Claude Code 会话、Anthropic 原生工作流和 Claude-first 团队默认路径上;

- 真正需要更高推理上限时,再考虑 Opus 4.6 或 GPT-5.4 Pro。

这不是“骑墙”,而是更现实的工程策略。

如果你真正想比较的是产品层而不是模型 ID,本地化阅读可以继续看我们的 Claude Code vs Codex 对比,它能帮助你理解为什么产品表面经常比裸模型分数更能决定真实体验。

各自真正赢在哪里

这篇文章最不应该导向的误解是:“既然 GPT-5.4 更像默认答案,那 Sonnet 4.6 就没意义了。”并不是。

Claude Sonnet 4.6 真正赢的地方,是它在 Claude 体系中的原生位置:Claude Free / Pro 默认、Claude Code 默认、Anthropic 平台能力围绕它展开。如果你的组织、团队流程、权限管理、工具链都已经更贴近 Anthropic,那 Sonnet 4.6 仍然是非常顺手的主力模型。它的价值不在于“基础 API 更便宜”,而在于“它就是 Claude 体系里最自然的默认高能力档”。

GPT-5.4 真正赢的地方,则是它现在同时满足了四个本来不容易同时成立的条件:它是 OpenAI 主线默认旗舰、基础输入价格不高于 Sonnet 4.6、最大输出更大、而且工具能力公开得更完整。也正因为这四点同时成立,它才成为目前更容易推荐给大多数开发团队的“默认主力”。

所以最终结论其实很简单:

- 想找一个统一默认模型,选 GPT-5.4

- 想找一个Claude 原生默认模型,选 Claude Sonnet 4.6

- 团队能做任务路由,最好两个都保留

这个结论不像很多标题党文章那样刺激,但它更能真正帮你做决定。

FAQ(常见问题)

GPT-5.4 在编码上真的比 Claude Sonnet 4.6 更好吗?

大多数情况下是的,前提是你要的是一个能够同时覆盖编码、长上下文和工具型 agent 工作流的默认模型。按照当前官方公开信息,GPT-5.4 的整体规格更完整:输入更便宜、输出价格相同、上下文同级、最大输出更高、工具能力公开得也更完整。Sonnet 4.6 依然很强,但更适合作为 Claude 体系内的默认答案。

Claude Sonnet 4.6 比 GPT-5.4 更便宜吗?

按 2026 年 3 月 19 日 官方公开的基础 API 定价,不是。GPT-5.4 为 $2.50 / 1M 输入,$15 / 1M 输出;Claude Sonnet 4.6 为 $3 / 1M 输入,$15 / 1M 输出。所以很多“Sonnet 更便宜”的说法,在当前官方价格下并不成立。

Claude Sonnet 4.6 能不能替代 GPT-5.4?

可以在一部分场景里替代,尤其是你已经深度使用 Claude Code 或 Claude.ai,而且并不依赖 OpenAI 那套更明确的模型级工具支持时。但如果你要的是一个在 API 路由、Codex、长输出和多工具代理里都更容易成为统一默认的模型,GPT-5.4 还是更合适。

团队应该两个都用吗?

很多团队确实应该这样做。更实际的做法是:GPT-5.4 做主默认,Sonnet 4.6 做 Claude 原生分流。只要你的工程体系允许按任务路由,这通常会比强行把所有任务压到一个供应商上更稳。