A 21 de marzo de 2026, si vas a elegir un modelo barato para una nueva carga de OpenAI API, lo normal es empezar por GPT-5.4 nano. La razón no es solo el precio. La página actual de GPT-5.4 nano la sitúa por debajo de GPT-5 mini en coste, con un knowledge cutoff mucho más nuevo, y además con una superficie de herramientas más amplia. Y en el anuncio oficial de GPT-5.4 mini y nano del 17 de marzo de 2026, GPT-5.4 nano supera a GPT-5 mini en varias filas relevantes para coding, herramientas y contextos largos.

Eso no significa que GPT-5 mini haya dejado de tener sentido. Si ya la ejecutas en producción, si el factor dominante es el throughput de Tier 1 o si tu tráfico es muy simple y ya está muy afinado, mantener mini puede seguir siendo razonable. Pero si la pregunta es “¿con qué cheap lane debería arrancar un sistema nuevo en 2026?”, la respuesta base ya se ha movido hacia GPT-5.4 nano.

Resumen rápido

| Modelo | Mejor para | Motivo principal para elegirlo | Motivo principal para no elegirlo |

|---|---|---|---|

| GPT-5.4 nano | Nuevos flujos baratos de clasificación, extracción, ranking y helper-agents simples | Es más barata, más reciente, tiene más herramientas y además rinde mejor que GPT-5 mini en varias filas oficiales de coding y tools | Tiene menos Tier 1 TPM y pierde en algunos benchmarks más estrechos |

| GPT-5 mini | Tráfico legacy estable, centrado en texto, donde importa mucho el throughput de Tier 1 | Más Tier 1 TPM y un comportamiento ya conocido en producción | Es más antigua, más cara que nano y ya no parece la rama barata por defecto para cargas nuevas |

La regla más útil es esta: para un cheap lane nuevo, prueba primero GPT-5.4 nano; deja GPT-5 mini solo si tienes una razón medida para conservarla.

El nombre engaña más de lo que ayuda

Mucha gente ve “GPT-5 mini” y asume que debe estar por encima de “GPT-5.4 nano” en la jerarquía de producto. En la línea actual de OpenAI, esa intuición ya no funciona bien.

La guía latest-model dice que, si necesitas variantes más pequeñas y rápidas, debes empezar por gpt-5.4-mini o gpt-5.4-nano. Y la propia página de GPT-5 mini añade otra señal importante: para la mayoría de nuevas cargas low-latency y high-volume, OpenAI recomienda empezar con GPT-5.4 mini.

Eso cambia la lectura de GPT-5 mini. Sigue viva, sigue teniendo pricing y rate limits, y sigue siendo utilizable. Pero ya no parece la cheap default de futuro. Se parece más a una rama legacy que algunas empresas pueden mantener por motivos operativos. GPT-5.4 nano, en cambio, está posicionada explícitamente para classification, data extraction, ranking y coding subagents sencillos. Justo el tipo de trabajo que muchas arquitecturas baratas delegan a su carril económico.

Precio, actualidad, herramientas y throughput lado a lado

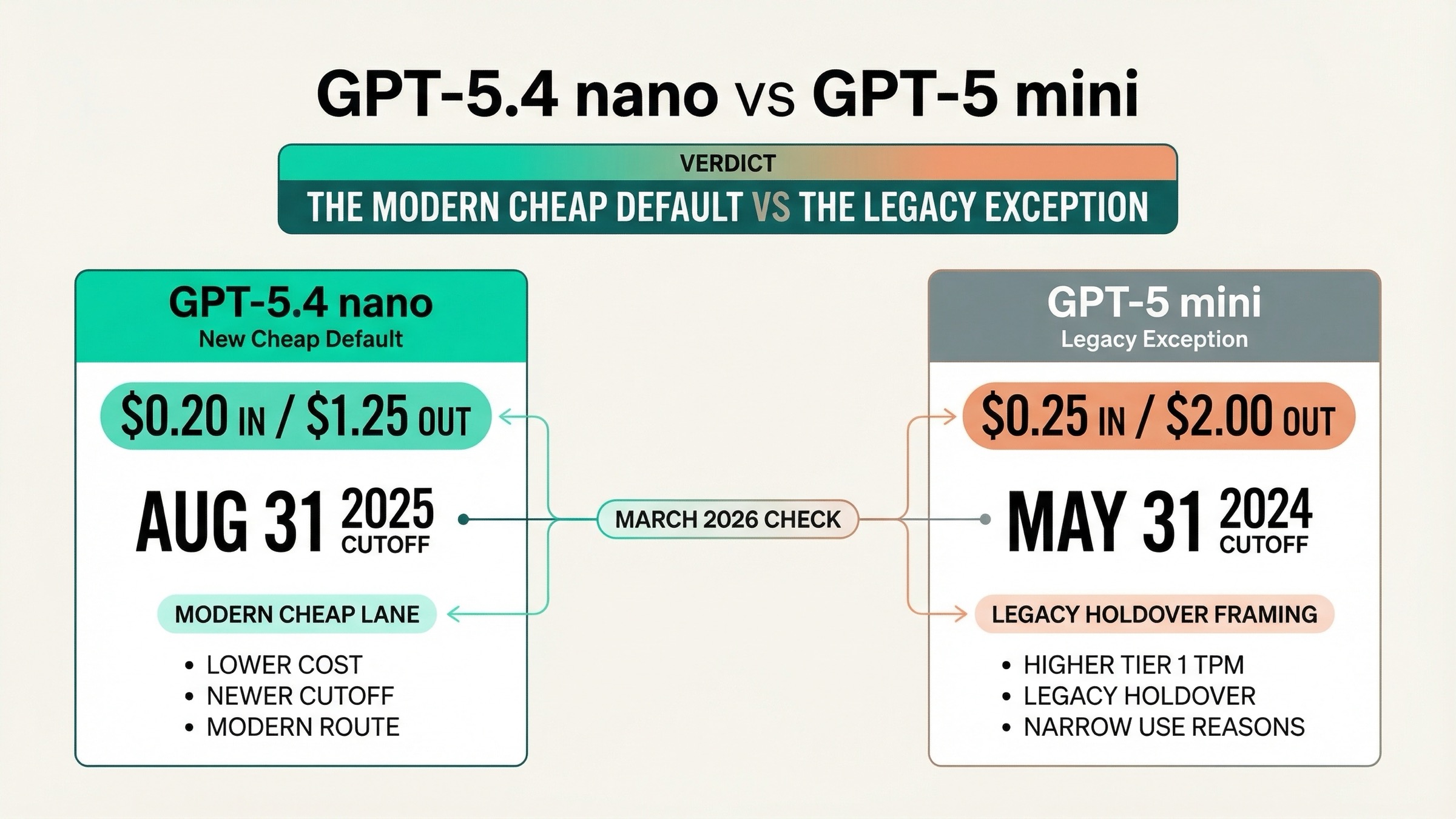

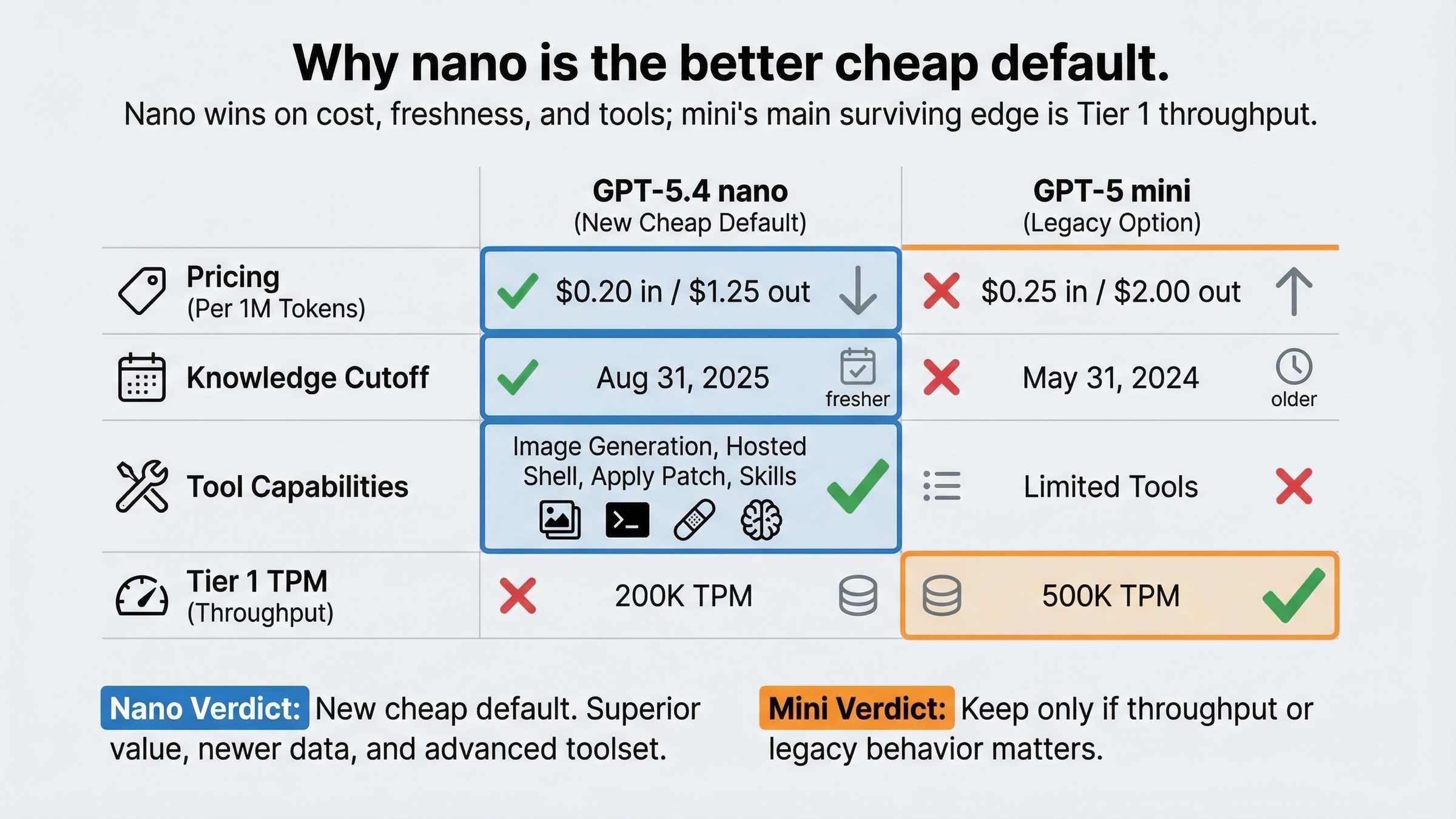

Empecemos por los números más visibles. A 21 de marzo de 2026, GPT-5.4 nano cuesta $0.20 por 1M input tokens, $0.02 cached input y $1.25 por 1M output tokens. GPT-5 mini cuesta $0.25, $0.025 y $2.00 respectivamente. Es decir, en esta comparación GPT-5 mini no solo es más vieja: también es más cara.

La segunda diferencia fuerte es la frescura del modelo. GPT-5.4 nano marca cutoff 2025-08-31, mientras GPT-5 mini sigue en 2024-05-31. Si tu cheap lane va a tocar bibliotecas nuevas, cambios de API de 2025 o documentación reciente, esa diferencia pesa.

La tercera diferencia es la capa de herramientas. GPT-5.4 nano incluye image generation, hosted shell, apply patch, skills y MCP. GPT-5 mini se queda en web search, file search, code interpreter y MCP. Si tu carril barato es puro texto, quizá no cambie todo. Pero en cuanto ese worker barato tenga algo de comportamiento tool-enabled, la diferencia deja de ser teórica.

La razón más fuerte para seguir con GPT-5 mini hoy es el throughput de niveles bajos. En compare-models page, GPT-5 mini tiene 500,000 TPM en Tier 1 frente a 200,000 de GPT-5.4 nano. Esa es la explicación más limpia de por qué algunas empresas aún la mantienen.

| Especificación | GPT-5.4 nano | GPT-5 mini |

|---|---|---|

| Input price | $0.20 / 1M tokens | $0.25 / 1M tokens |

| Cached input | $0.02 / 1M tokens | $0.025 / 1M tokens |

| Output price | $1.25 / 1M tokens | $2.00 / 1M tokens |

| Context window | 400,000 | 400,000 |

| Max output | 128,000 | 128,000 |

| Knowledge cutoff | 2025-08-31 | 2024-05-31 |

| Snapshot | gpt-5.4-nano-2026-03-17 | gpt-5-mini-2025-08-07 |

| Image generation | Yes | No |

| Hosted shell | Yes | No |

| Apply patch | Yes | No |

| Skills | Yes | No |

| Tier 1 TPM | 200,000 | 500,000 |

Por eso una comparativa basada solo en nombres o en una tabla superficial se queda corta. Si miras precio, cutoff y herramientas juntos, GPT-5.4 nano se parece mucho más a la cheap default moderna.

Lo que realmente dicen los benchmarks oficiales del 17 de marzo de 2026

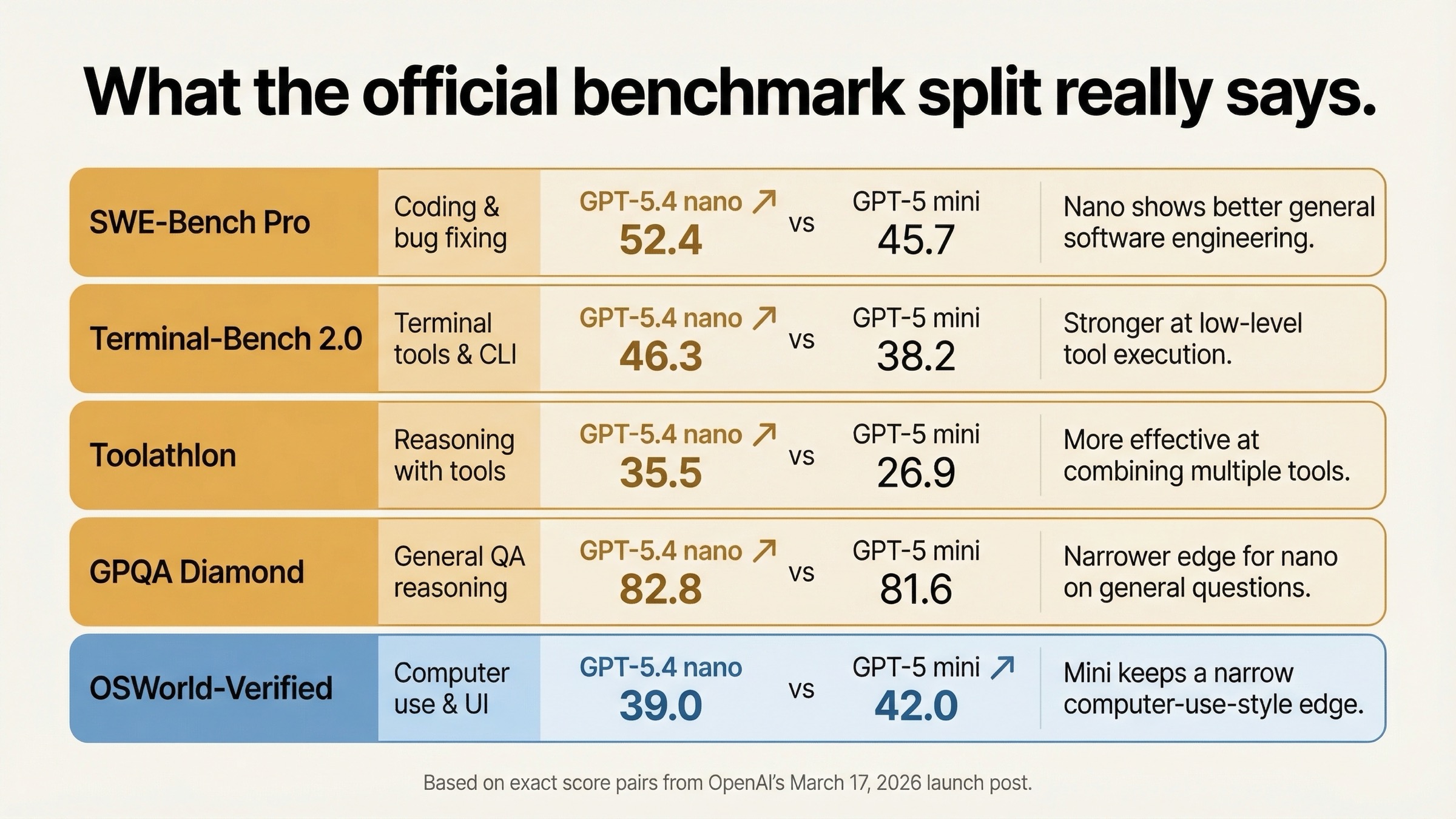

La clave está en que GPT-5.4 nano no aparece como “más barata pero claramente peor”.

| Benchmark del launch post oficial | GPT-5.4 nano | GPT-5 mini | Qué significa |

|---|---|---|---|

| SWE-Bench Pro | 52.4% | 45.7% | Nano es mejor resolviendo problemas reales de software |

| Terminal-Bench 2.0 | 46.3% | 38.2% | Nano rinde mejor en ejecución de herramientas tipo terminal |

| Toolathlon | 35.5% | 26.9% | Nano coordina mejor flujos con herramientas |

| GPQA Diamond | 82.8% | 81.6% | Incluso en QA complejo, nano va ligeramente por delante |

| MRCR v2 128K-256K | 33.1% | 19.4% | Nano aguanta mejor prompts realmente largos |

| OSWorld-Verified | 39.0% | 42.0% | Aquí mini mantiene una pequeña ventaja |

Eso significa que GPT-5.4 nano no gana solo por coste. Gana también en varias de las filas que más importan para workers baratos modernos: coding, tool use y retrieval con contexto largo. GPT-5 mini mantiene algunos bolsillos de ventaja, pero la foto general ya favorece a nano.

También conviene recordar que OpenAI presenta esta tabla como una comparación de producto con los ajustes actualmente expuestos, no como un experimento de laboratorio perfectamente simétrico. Para decidir qué comprar o desplegar, eso sigue siendo útil.

Cuándo elegir GPT-5.4 nano

Si estás diseñando un cheap lane nuevo, GPT-5.4 nano es normalmente la primera opción razonable. Encaja especialmente bien en classification, extraction, ranking, helper-agents y coding subagents sencillos. Justo los trabajos que OpenAI menciona para esta rama.

También tiene sentido cuando el carril barato no es solo texto plano y necesita algo de herramientas: shell, patching, extracción estructurada o validaciones simples. En ese punto GPT-5.4 nano se siente más alineada con una arquitectura moderna que GPT-5 mini.

Deberías inclinarte por GPT-5.4 nano si varias de estas condiciones son ciertas:

- estás construyendo un cheap route nuevo;

- quieres el menor coste de esta pareja;

- valoras un cutoff más reciente;

- tu worker barato usa alguna herramienta;

- prefieres una rama actual de producto antes que una legacy branch con más inercia.

Cuándo todavía tiene sentido GPT-5 mini

GPT-5 mini no desaparece del mapa. Pero ya no es la respuesta automática.

La razón más fuerte para mantenerla es un despliegue legacy estable. Si tu stack ya está ajustado, los prompts están medidos y cambiar de modelo introduce coste y riesgo, no hace falta reemplazarlo a ciegas. La segunda razón es el throughput de Tier 1. Si operas en niveles bajos y mueves mucho tráfico corto, esos 500,000 TPM cuentan. La tercera es que tu workload real se parezca a alguno de los pocos bolsillos donde mini conserva una pequeña ventaja.

Mantener GPT-5 mini tiene más sentido si:

- ya la usas en producción y migrar tiene coste real;

- el Tier 1 throughput cambia tu economía o tu cola;

- tu carga es principalmente plain text y no depende de nuevas tools;

- las pruebas con tus prompts no muestran una mejora suficiente al cambiar a nano.

La clave es que esa lista es bastante más estrecha que “cualquier cosa barata”.

No mezcles la elección de API con la superficie de ChatGPT

Este keyword suele arrastrar a muchos usuarios hacia la experiencia visible de ChatGPT, pero esa no es la misma pregunta que elegir un modelo de API.

La página actual del Help Center habla del picker visible en términos de GPT-5.3 Instant, GPT-5.4 Thinking y GPT-5.4 Pro. Eso no responde por sí solo si tu cheap lane de API debería ir en GPT-5.4 nano o en GPT-5 mini.

Para arquitectura de API, pesan más las model pages, la latest-model guide y el launch post. Si además quieres decidir la rama premium al lado de la barata, lo natural es seguir con GPT-5.4 vs GPT-5 mini. Si todavía te falta el paso de configuración del API key, aquí no hay versión localizada y conviene dejar el fallback explícito al artículo en inglés: OpenAI API key guide.

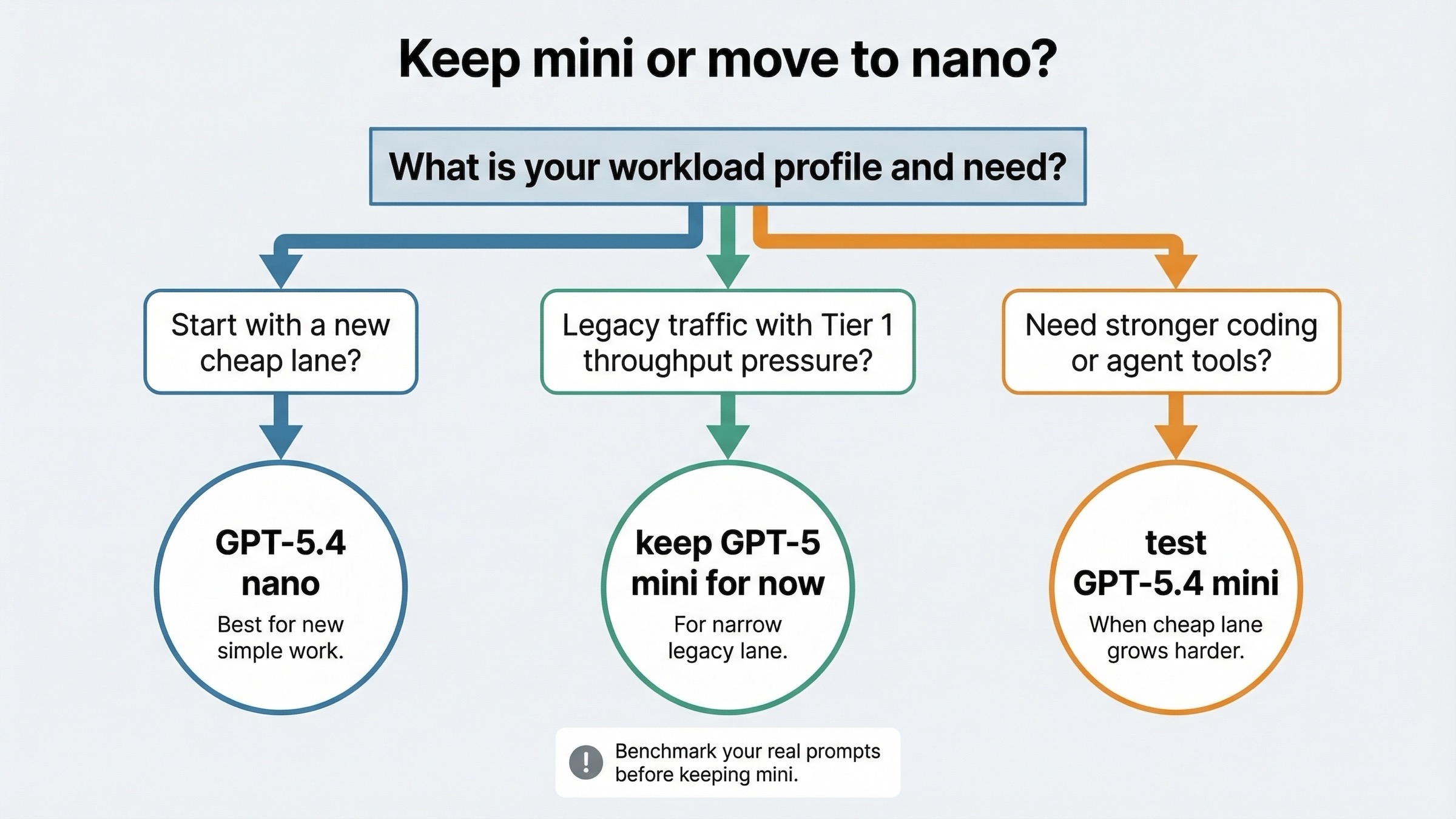

La regla práctica de migración es simple:

- Para cualquier cheap workload nuevo, prueba antes GPT-5.4 nano.

- Mantén GPT-5 mini solo si tus prompts reales demuestran una ventaja operativa clara.

- Si el cheap lane se complica hacia coding o agentes, mueve la comparación a GPT-5.4 mini.

Qué conviene medir antes de conservar mini

El error más común en esta comparación es dejar GPT-5 mini por costumbre y no por datos. Si ya existe una ruta de producción estable, no hace falta migrar a ciegas. Pero tampoco conviene defender mini con una frase vaga como “ya nos funciona”. Si vas a conservarla, necesitas saber exactamente qué ventaja real sigue aportando.

El mínimo razonable de métricas aquí es bastante concreto: coste efectivo por tarea completada, porcentaje de tool calls que terminan bien, estabilidad en prompts largos, latencia media sobre tu tráfico real y porcentaje de solicitudes que terminan escalando a una ruta más cara. El hecho de que mini tenga más Tier 1 TPM es relevante, pero no decide por sí solo la economía total del carril barato.

También ayuda separar el tráfico por tipos de trabajo. Un cheap lane suele mezclar clasificación corta, extracción estructurada, routing helpers y alguna tarea ligera de coding. Si mides todo con un único promedio, ocultas dónde se rompen de verdad las cosas. GPT-5.4 nano suele salir favorecida en esos mixes porque no solo cuesta menos: también encaja mejor cuando el worker barato necesita algo de tools o aguanta contextos más largos.

La pregunta útil no es “¿mini sigue viva?”, sino “en qué segmento concreto mini gana lo suficiente como para compensar su mayor precio y su cutoff más antiguo?” Si no puedes responder eso con datos, lo más probable es que mini siga en el stack por inercia legacy y no por product fit actual.

Cómo migrar a nano sin añadir riesgo innecesario

Si decides probar GPT-5.4 nano, evita cambiar todo el tráfico barato con un único interruptor. Lo más sensato es mantener tres carriles mientras mides: la ruta actual con mini, una ruta candidata con nano y, si hace falta, un fallback premium para los casos donde el cheap lane falle. Así puedes observar calidad, coste y tasa de escape al mismo tiempo.

En la primera fase conviene cambiar solo el modelo y mantener igual el prompt, el routing y la instrumentación. Si cambias modelo y orquestación a la vez, después no sabrás qué parte de la mejora o del deterioro vino de cada lado. Cuando ya tengas una línea base limpia, entonces sí puedes experimentar con prompts más cortos, distinto reasoning budget o mayor uso de herramientas.

Para rollout real, una secuencia prudente suele ser esta: empezar con un porcentaje pequeño del tráfico nuevo, medir coste por tarea completada, revisar reintentos y fallos en contextos largos, y solo después ampliar cuota. Si nano aguanta bien, se convierte en cheap default. GPT-5 mini se queda entonces solo en los bolsillos donde el throughput o la estabilidad heredada sigan siendo claramente superiores.

Esa forma de migrar encaja mejor con la foto oficial actual. GPT-5.4 nano debe tratarse como el nuevo candidato base. GPT-5 mini no se mantiene porque “suene más grande”, sino únicamente cuando tus métricas demuestran una ventaja operativa estrecha pero real.

Si quieres un filtro operativo muy corto, piensa así: mini solo merece quedarse si reduce de verdad la presión de cola bajo tu límite de Tier 1 o si conserva una estabilidad que nano todavía no iguala en prompts críticos. Si no puedes demostrar una de esas dos ventajas, el carril barato nuevo debería estandarizarse en nano.

FAQ

¿GPT-5 mini ya está deprecated?

No. A 21 de marzo de 2026 sigue teniendo model page, pricing y rate limits. El punto no es que haya desaparecido, sino que ya no parece la ruta barata por defecto para cargas nuevas.

¿GPT-5.4 nano reemplaza por completo a GPT-5 mini?

Tampoco. Para tráfico legacy o cargas muy sensibles a throughput, mini puede seguir teniendo sentido. Pero en flujos baratos nuevos, nano suele ser la mejor primera apuesta.

¿Cuál es el argumento más fuerte para mantener GPT-5 mini?

No es el nombre. Es operations: más Tier 1 TPM y un comportamiento de producción ya comprobado.

¿Cuándo debería comparar con GPT-5.4 mini en vez de seguir mirando GPT-5 mini?

Cuando tu cheap lane empiece a cargar con más trabajo de coding o de agentes. En ese momento, la comparación siguiente suele ser GPT-5.4 mini vs GPT-5 mini.

La conclusión corta y honesta es esta: GPT-5.4 nano suele ser la cheap default correcta para nuevas cargas de OpenAI API en 2026, y GPT-5 mini queda como una excepción legacy que solo se mantiene con una razón muy concreta.