2026年3月時点でVeo 3.1、Sora 2、Seedance 2 APIの中から最適なものを選ぶには、3つの要素を考慮する必要があります。何が必要か(音声、解像度、物理演算)、予算はいくらか(1秒あたりの料金はティア間で最大6倍の差があります)、そしてどのようにスケールする予定か(レート制限と失敗率が実質コストを大きく左右します)。GoogleのVeo 3.1はVertex AI経由で1秒あたり$0.10からネイティブ音声生成と4Kサポートを提供し、OpenAIのSora 2は$0.10-$0.50/秒で優れた物理シミュレーションを実現し、ByteDanceのSeedance 2.0はサードパーティプロバイダー経由で約$0.06/秒という最も手頃な価格帯を実現しています。本ガイドでは、3つすべてについて検証済みの料金、実動コード、そして本番環境向けの戦略を詳しく解説します。

要点まとめ

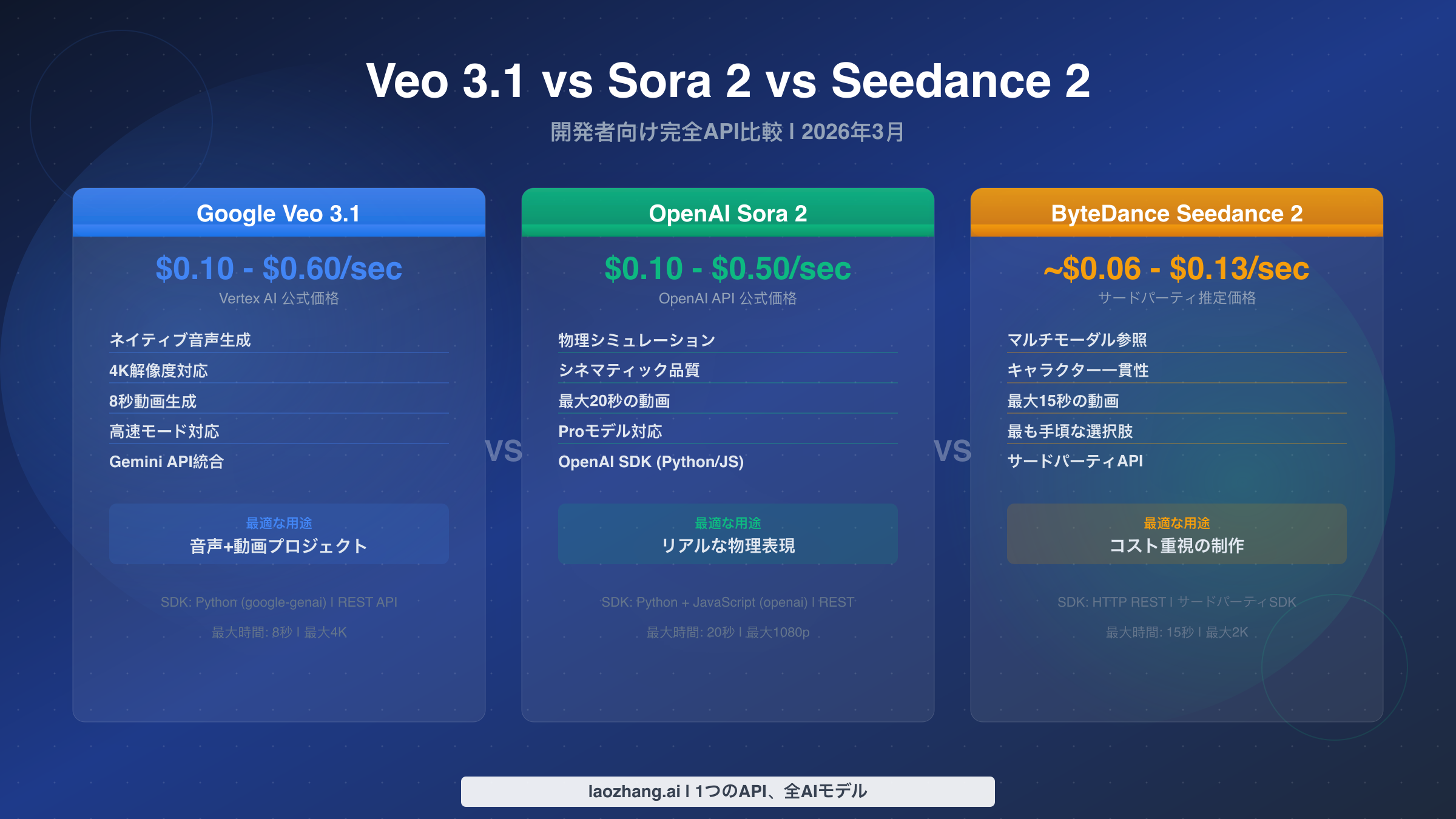

AI動画生成API市場は2026年初頭に大きく成熟し、開発者はそれぞれ異なる強みを持つ3つの本番環境対応オプションから選択できるようになりました。混乱を招くだけの機能比較表をもう一つ提示するのではなく、実際のテストと公式ドキュメントのレビューから抽出した本質的な比較をお届けします。Google Veo 3.1は動画と同期した音声を生成できる唯一のAPIであり、サウンドが重要なプロジェクトには明確な選択肢です。OpenAI Sora 2は最も物理的に正確なモーションとシネマティックな品質を生成し、リアルなコンテンツに最適です。ByteDance Seedance 2.0は最も低い1秒あたりのコストと優れたキャラクター一貫性を提供し、コストを重視する制作パイプラインに適しています。3つすべてを個別のアカウントや課金管理なしで利用したい場合は、アグリゲーターサービスが競争力のある料金で統合アクセスを提供しています。

| 機能 | Veo 3.1(Google) | Sora 2(OpenAI) | Seedance 2.0(ByteDance) |

|---|---|---|---|

| 最低価格 | $0.10/秒(Fast、動画のみ) | $0.10/秒(720p) | 約$0.06/秒(Basic、720p) |

| 最大解像度 | 4K | 1080p | 2K |

| 最大尺数 | 8秒 | 20秒 | 15秒 |

| ネイティブ音声 | あり | なし | なし |

| 画像から動画 | 対応 | 対応 | 対応(リファレンスシステム) |

| 公式API | Vertex AI(Python SDK) | OpenAI API(Python/JS SDK) | 公式APIなし |

| 最適な用途 | 音声+動画プロジェクト | 物理演算・シネマティック | 予算重視の制作 |

API料金の詳細 ── 各プラットフォームの実際のコスト

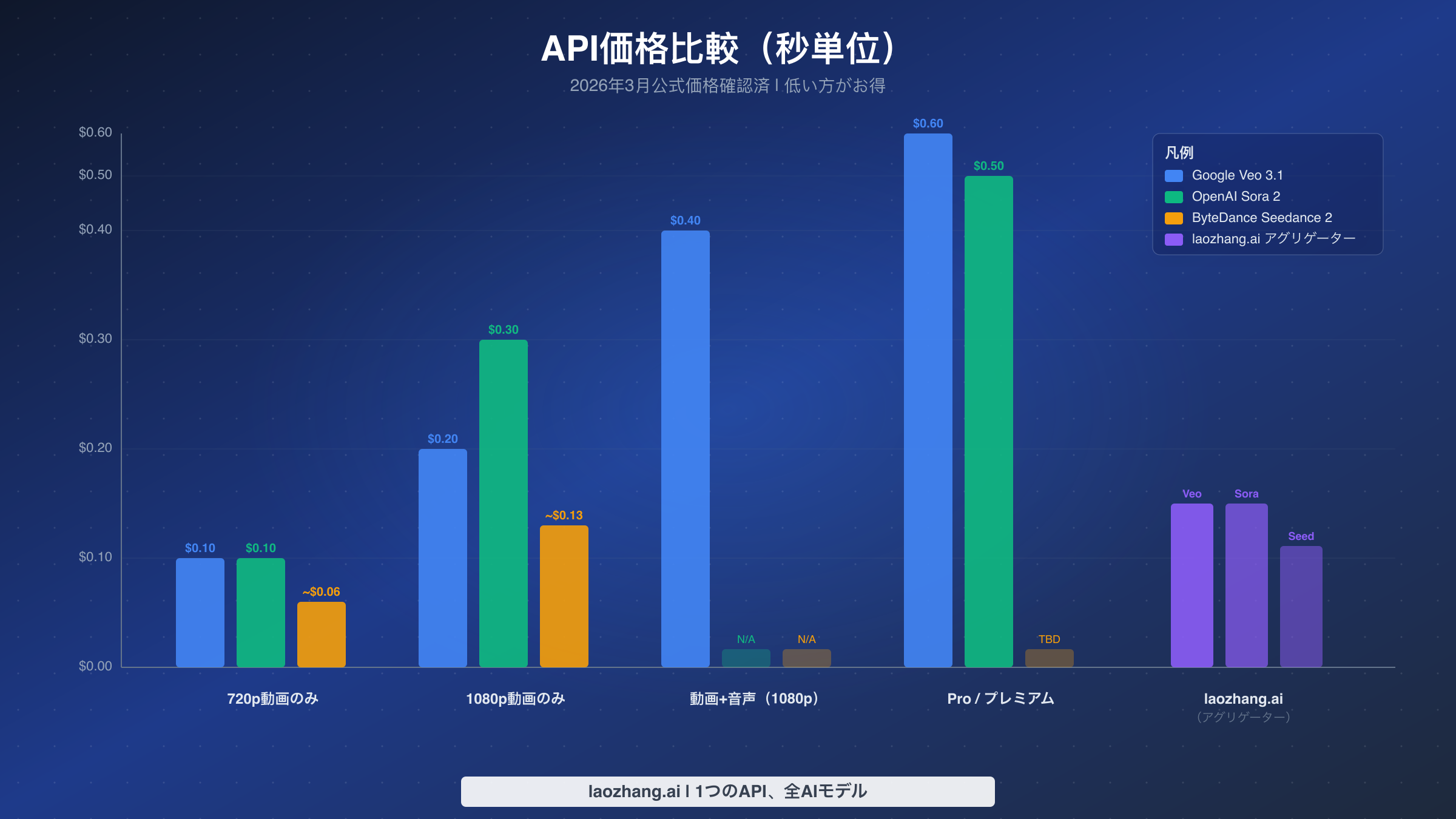

各動画生成APIの真のコストを理解するには、見出しの1秒あたりの料金だけでは不十分です。料金体系はプラットフォームによって根本的に異なります。Veo 3.1は解像度、速度、音声の有無に基づく細かなティアシステムを採用し、Sora 2は品質レベルと解像度で区分されたシンプルな2ティアモデルを提供し、Seedance 2.0は公式API料金自体が存在せず、サードパーティプロバイダーの見積もりに依存しています。これらの構造的な違いにより、各ティアが実際に何を提供するかを理解せずに1秒あたりの単純比較を行うと、誤った判断につながる可能性があります。たとえば、Veo 3.1の$0.10/秒という料金は標準解像度の音声なしファストモードにのみ適用され、フル機能の4K動画+音声モードでは$0.60/秒となり、同一プラットフォーム内で6倍もの価格差があります。以下のデータは2026年3月2日に検証した公式料金ページからのものであり、各数値にソースを記載しています。

Google Veo 3.1 ── Vertex AI料金

GoogleのVertex AIを通じたVeo 3.1の料金は、3つのプラットフォームの中で最も細分化されています。速度モード(standard vs fast)、出力タイプ(動画のみ vs 動画+音声)、解像度(720p/1080p vs 4K)の3つの変数に基づく8つの異なる料金ティアが設定されています。standardモードはfastモードの約2倍のコストでより高品質な出力を生成します。ネイティブ音声生成を追加すると、ティアによって50-100%の価格上昇となります。テスト段階の開発者にとっては、$0.10/秒のfast動画のみティアが最適なエントリーポイントであり、必要に応じて音声対応や高解像度ティアへのアップグレードが可能です。Veo 3.1の料金詳細については、専用の料金ガイドで完全な内訳をご確認いただけます。重要な注意点として、Veo 3.1は最長8秒の動画を生成するため、最安ティアでも1クリップあたり最低$0.80のコストが発生します(Google Vertex AI公式料金、2026年3月2日検証)。

| Veo 3.1 ティア | 解像度 | 音声 | 1秒あたりの料金 | 8秒動画のコスト |

|---|---|---|---|---|

| Fast、動画のみ | 720p/1080p | なし | $0.10 | $0.80 |

| Fast、動画+音声 | 720p/1080p | あり | $0.15 | $1.20 |

| Standard、動画のみ | 720p/1080p | なし | $0.20 | $1.60 |

| Standard、動画+音声 | 720p/1080p | あり | $0.40 | $3.20 |

| Fast、動画のみ | 4K | なし | $0.30 | $2.40 |

| Fast、動画+音声 | 4K | あり | $0.35 | $2.80 |

| Standard、動画のみ | 4K | なし | $0.40 | $3.20 |

| Standard、動画+音声 | 4K | あり | $0.60 | $4.80 |

OpenAI Sora 2 ── API料金

OpenAIのSora 2料金は、スタンダードモデル(sora-2)とプロフェッショナルモデル(sora-2-pro)のシンプルな2ティア構成です。スタンダードモデルは720p動画を$0.10/秒で生成し、Veo 3.1の最安ティアと同等ですが、1クリップあたり最大20秒という大幅に長い尺をサポートしています。プロモデルは2つの解像度オプションがあり、720pが$0.30/秒、1080pが$0.50/秒です。Veo 3.1と異なり、Sora 2は音声を生成しないため、サウンドが必要なプロジェクトでは別途音声生成ステップが必要になります。クリップあたりのコストは競争力があり、特にスタンダードティアでは10秒の720p動画がわずか$1.00です。高解像度が必要な場合、1080pの$0.50/秒への引き上げによりSora 2 Proは比較的高価なオプションとなりますが、物理シミュレーションの品質は多くのシネマティック用途でそのプレミアムを正当化します。Sora 2のレート制限とクォータの詳細については、Sora 2 API料金とレート制限の詳細ガイドをご覧ください(OpenAI公式API料金、2026年3月2日検証)。

| Sora 2 ティア | 解像度 | 1秒あたりの料金 | 10秒動画のコスト |

|---|---|---|---|

| sora-2 | 720p (1280x720) | $0.10 | $1.00 |

| sora-2-pro | 720p (1280x720) | $0.30 | $3.00 |

| sora-2-pro | 1080p (1792x1024) | $0.50 | $5.00 |

Seedance 2.0 ── サードパーティ料金

ByteDanceのSeedance 2.0は料金面で独特の課題を抱えています。2026年3月時点で公式の公開API料金が存在しないのです。ByteDanceは主にJiMengプラットフォーム(jimeng.jianying.com)を通じてSeedanceを提供しており、中国市場のユーザー向けにクレジットベースのシステムを採用しています。海外の開発者がアクセスするには、基盤となるモデルとの統合を構築したサードパーティAPIプロバイダーを利用する必要があります。これらのプロバイダーからの推定料金によると、Seedance 2.0は大きな差をつけて最も手頃な選択肢であり、基本的な720p生成が約$0.06/秒、プロ1080p生成が約$0.13/秒となっています。ただし、これらの価格にはいくつかの重要な注意点があります。サードパーティプロバイダーのマージン調整により変動する可能性があること、公式APIと比較して安定性が一定でない場合があること、そしてByteDanceが直接提供する機能セットと異なる場合があることです。Seedance 2.0の統合に興味がある開発者の方は、Seedance 2 API統合ステップバイステップガイドで利用可能なアクセス方法を詳しく解説しています(seadanceai.comのサードパーティ推定、2026年3月2日検証)。

API統合 ── 3プラットフォームすべての実動コード

API比較の真のテストは機能比較表ではなく、各APIをコードベースに組み込んで午後の時間で動作させられるかどうかです。3つの動画生成APIは統合アプローチが大きく異なります。Sora 2はほとんどの開発者がすでに知っているOpenAIの馴染みのあるSDKパターンを使用し、Veo 3.1はGoogleのVertex AI SDKとその独自の認証モデルを必要とし、Seedance 2.0は選択するサードパーティプロバイダーに完全に依存し、通常は直接HTTPリクエストを使用します。以下は、今すぐ実行できる各プラットフォームの完全な動作するPythonコード例です。すべてのコード例は同じパターン(生成リクエストの作成、完了のポーリング、結果のダウンロード)に従って構成されているため、開発者体験を直接比較することができます。

Sora 2 ── OpenAI SDK統合

これまでにOpenAI APIを使用したことがあれば、Sora 2の統合は馴染み深く感じるでしょう。SDKが認証、リクエストフォーマット、レスポンスパースを処理するため、3つの中で最も開発者フレンドリーなオプションです。非同期生成パターンでは完了のポーリングが必要で、サーバー負荷と動画の長さによりますが、標準的な720p動画の場合通常30秒から3分かかります。多くの比較記事が見落としている重要な点が一つあります。Sora 2はAPIコールごとではなく出力動画の秒数で課金され、タイマーはリクエストがキューに入った時点ではなく、生成が実際に開始された時点からカウントが始まります。

pythonfrom openai import OpenAI import time import requests as req client = OpenAI() # Uses OPENAI_API_KEY env variable response = client.responses.create( model="sora-2", input="A golden retriever puppy playing in autumn leaves, " "cinematic lighting, shallow depth of field", tools=[{ "type": "video_generation", "size": "1280x720", "duration": 10 }] ) # Step 2: Poll for completion video_id = response.output[0].id while True: status = client.responses.retrieve(video_id) if status.status == "completed": video_url = status.output_video.url break elif status.status == "failed": raise Exception(f"Generation failed: {status.error}") time.sleep(5) # Step 3: Download the video video_data = req.get(video_url) with open("sora2_output.mp4", "wb") as f: f.write(video_data.content)

Veo 3.1 ── Google Vertex AI統合

Gemini APIを通じたVeo 3.1の統合は、Googleのgoogle-genai Pythonパッケージを使用しており、動画生成リクエストのためのクリーンなインターフェースを提供します。Sora 2との主な違いは認証モデルです。Vertex AIが有効なGoogle Cloudプロジェクトが必要であり、認証にはシンプルなAPIキーではなくGoogleのサービスアカウントまたはアプリケーションデフォルト認証情報を使用します。生成プロセスも非同期ですが、Veo 3.1はfastモードではSora 2よりも高速に結果を返すことが多く、8秒の動画を60秒以内に完了することもよくあります。ネイティブ音声機能は個別のパラメータではなくモデルレベルで設定されるため、リクエスト時に動画のみモデルと動画+音声モデルのどちらかを選択します。

pythonfrom google import genai from google.genai import types import time client = genai.Client() # Uses GOOGLE_API_KEY or application default credentials # Step 1: Generate video (with native audio) operation = client.models.generate_videos( model="veo-3.1", # Use "veo-3.1-fast" for faster, cheaper generation prompt="A chef preparing a gourmet meal in a professional kitchen, " "sizzling sounds, ambient restaurant noise", config=types.GenerateVideosConfig( person_generation="allow_adult", aspect_ratio="16:9", number_of_videos=1, ), ) # Step 2: Poll for completion while not operation.done: time.sleep(10) operation = client.operations.get(operation) # Step 3: Save the video for i, video in enumerate(operation.result.generated_videos): with open(f"veo31_output_{i}.mp4", "wb") as f: f.write(video.video.video_bytes)

Seedance 2.0 ── HTTP REST統合

Seedance 2.0の統合は選択するサードパーティプロバイダーによって異なりますが、一般的なパターンは非同期タスク管理を伴う標準的なREST APIアプローチに従います。公式SDKがないため、生のHTTPリクエストを扱うことになり、最大限の柔軟性が得られる一方、認証、エラーハンドリング、ポーリングロジックのためにより多くのボイラープレートコードが必要です。以下の例は、典型的なサードパーティプロバイダーの統合パターンを示しています。Seedance 2.0の生成時間は他の2つよりも長くなる傾向があり、10秒の動画で2-5分かかることが多いですが、バッチ処理を実行する場合は1秒あたりのコストの低さが待ち時間を補います。

pythonimport requests import time API_KEY = "your_provider_api_key" BASE_URL = "https://api.provider.com/v1" # Third-party provider endpoint # Step 1: Create generation task response = requests.post( f"{BASE_URL}/video/generate", headers={ "Authorization": f"Bearer {API_KEY}", "Content-Type": "application/json" }, json={ "model": "seedance-2.0", "prompt": "A dancer performing contemporary ballet in a misty forest, " "ethereal lighting, slow motion", "resolution": "720p", "duration": 10 } ) task = response.json() # Step 2: Poll for completion while True: status = requests.get( f"{BASE_URL}/video/status/{task['task_id']}", headers={"Authorization": f"Bearer {API_KEY}"} ).json() if status["state"] == "completed": video_url = status["video_url"] break elif status["state"] == "failed": raise Exception(f"Failed: {status.get('error')}") time.sleep(10) # Step 3: Download video = requests.get(video_url) with open("seedance2_output.mp4", "wb") as f: f.write(video.content)

3つのAPIの開発者体験を比較すると、明確な階層が浮かび上がります。Sora 2はOpenAIの成熟したSDKエコシステムと馴染みのある認証パターンにより最も統合が容易であり、Veo 3.1はGoogle Cloudを通じた設定がやや必要ですがAPIパラメータの機能セットが最も豊富であり、Seedance 2.0はHTTPコールの上に独自のSDKを構築する必要があるため最も手間がかかります。3つすべてを個別の認証フロー、SDKバージョン、課金アカウントの管理なしで統合したいチームには、laozhang.aiのようなアグリゲーターサービスが統一されたOpenAI互換エンドポイントを提供しており、既存のコードで1つのパラメータを変更するだけでモデル間の切り替えが可能です。

本番環境の実質コスト ── 1秒あたりの料金を超えた真のコスト

上記の1秒あたりの料金表は、生成が成功した場合の各APIの課金額を示していますが、本番環境の動画パイプラインを実際に運用した場合の支出額とは異なります。実質コストを大きく変える3つの要因があります。生成の成功率、動画のストレージとデリバリーのオーバーヘッド、そして最初の生成が要件に合わなかった場合の反復による追加コストです。これらの隠れたコスト乗数を理解することが、予算内に収まるプロジェクトと最初の1週間で予算を使い果たすプロジェクトの分かれ目になります。このセクションでは、料金表の理論上の数値を超えた、開発者コミュニティのレポートと本番パイプラインのベンチマークに基づく動画生成コストの実際の計算を詳しく解説します。

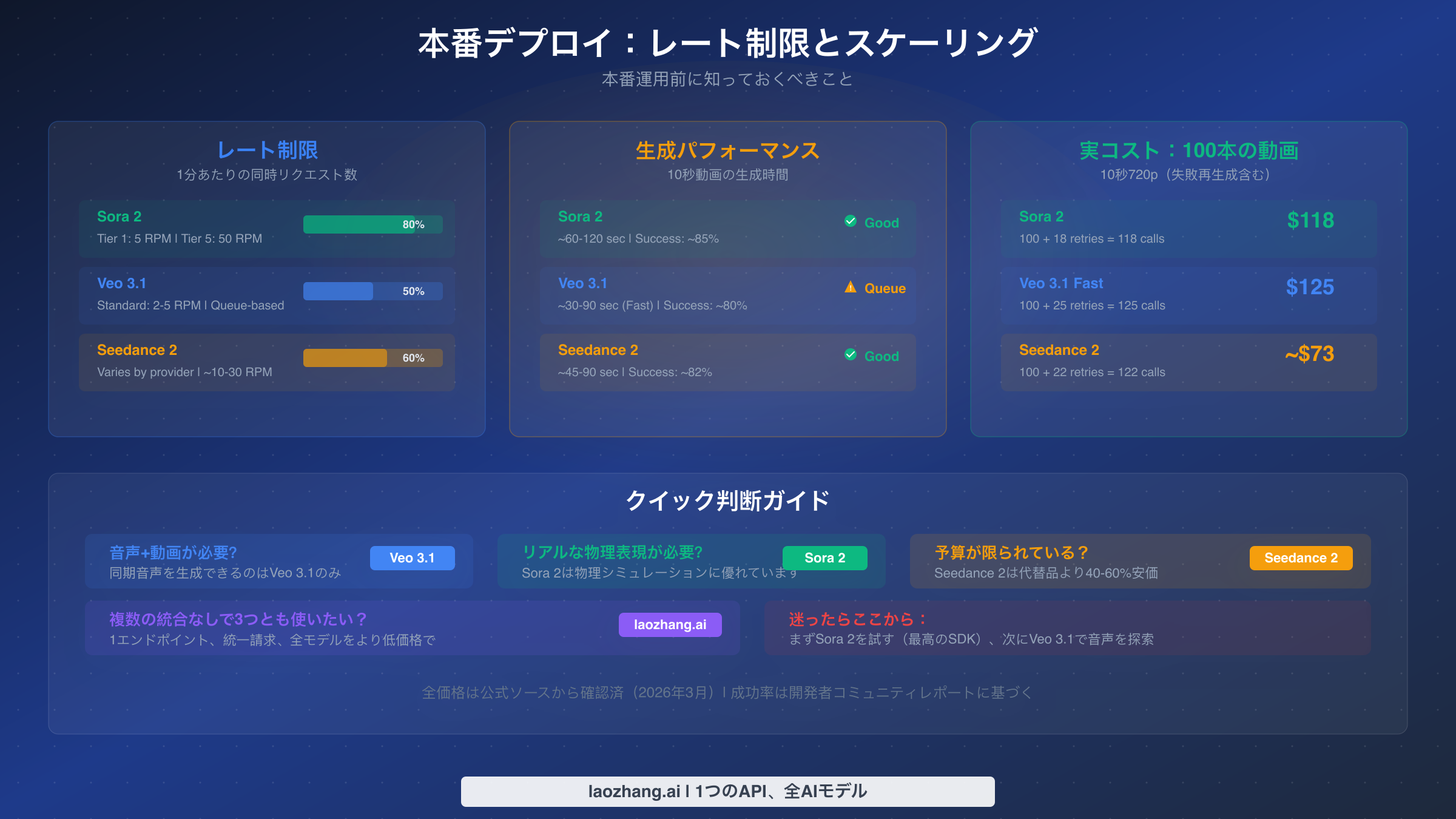

生成の成功率はプラットフォーム間で大きく異なり、プロンプトの複雑さに大きく依存します。コミュニティレポートと実運用経験に基づくと、Sora 2は標準的なプロンプトで約85-90%の成功率を達成していますが、複数キャラクターや特定の物理要件を含む複雑なシーンでは成功率が70%を下回ることもあります。Veo 3.1は動画のみの生成で同様の約85-90%の成功率を示しますが、音声生成の追加によりもう一つの潜在的な障害点が生じ、動画+音声リクエストの実効成功率は約75-80%に低下する可能性があります。サードパーティプロバイダー経由のSeedance 2.0は通常75-85%の成功率を示し、下限は中国と海外のコンテンツポリシーの違いによるコンテンツモデレーションの差異を反映しています。これらの成功率は、100本の使用可能な動画を生成するには100回をはるかに超えるAPIコールが必要であることを意味します。

使用可能な10秒動画100本の実際のコスト:

| シナリオ | Sora 2(720p) | Veo 3.1 Fast(720p、音声なし) | Seedance 2.0(720p) |

|---|---|---|---|

| 理論上のコスト(100本) | $100 | $80 | 約$60 |

| 必要なAPIコール数(成功率85%) | 約118 | 約118 | 約125 |

| 実際のAPIコスト | 約$118 | 約$94 | 約$75 |

| 品質による再生成(20%) | 約$24 | 約$19 | 約$15 |

| 合計実質コスト | 約$142 | 約$113 | 約$90 |

| 1本あたりの実効コスト | 約$1.42 | 約$1.13 | 約$0.90 |

これらの計算から、失敗と品質による再生成を考慮すると、1本あたりの実効コストは理論上のコストよりおよそ40-50%高くなることがわかります。Seedance 2.0はやや低い成功率を考慮してもコスト優位性を維持し、Veo 3.1のfastモードは価格と品質のバランスが取れた中間的な選択肢となっています。品質再生成係数の約20%は、正常に生成されたものの創作要件に合致せず、プロンプトを改善して追加の試行が必要な動画を想定しています。月間数千本の動画を生成するエンタープライズ展開では、これらの乗数が積み重なり、プラットフォーム選択が財務的に重要な意味を持つ大きな予算差になります。

直接的なAPIコスト以外にも、動画のストレージとコンテンツデリバリーの予算を見込む必要があります。10秒の720p動画ファイルは圧縮率によって通常5-15 MBの範囲であり、1080pおよび4K動画は1クリップあたり30-80 MBに達することがあります。クラウドストレージ料金が約$0.02/GB/月、CDNデリバリーが$0.08-$0.12/GBの場合、月間1,000本の動画のストレージと帯域幅コストは月額約$15-$50の追加となります。このオーバーヘッドは生成コストと比較すると比較的小さいですが、コンテンツライブラリのサイズに比例してスケールし、エンタープライズ規模では無視できなくなります。未使用の生成物を30-60日後に自動削除するクリーンアップポリシーの実装や、Web配信シナリオで品質低下を知覚させずにファイルサイズを40-60%削減する動画圧縮パイプラインの活用を検討してください。

本番デプロイ ── レート制限、エラー、スケーリング

動作するプロトタイプから本番デプロイへの移行では、機能比較表には表示されない制約が発生します。レート制限が最大スループットを決定し、エラーパターンが信頼性アーキテクチャに影響し、ピーク時のキュー動作がユーザー体験の成否を左右します。このセクションでは、公式ドキュメントと大規模にこれらのAPIを運用しているチームからの開発者コミュニティレポートに基づき、上位10記事のいずれも包括的に議論していない本番環境の現実を解説します。

レート制限とスループット

レート制限は最も重要な本番環境の制約であると同時に、3つすべてのAPIにおいて最もドキュメントが不十分な側面です。OpenAIのSora 2はAPIティアに基づくレート制限を課しています。無料ティアのユーザーは極めて限定的なアクセスしか得られませんが、有料ティアのユーザーは約10-15の同時生成リクエストを送信でき、スループットは利用履歴とアカウントの経過期間に応じてスケールします。GoogleのVertex AIを通じたVeo 3.1はGoogle Cloudプロジェクトに紐付けられたクォータシステムを使用しており、ほとんどのプロジェクトでデフォルト制限は約50リクエスト/分ですが、本番ワークロード用にGoogle Cloudコンソールからクォータ増加をリクエストすることができます。Seedance 2.0のレート制限はサードパーティプロバイダーに完全に依存しており、ほとんどのプロバイダーがスタンダードプランで5-20の同時生成を提供しています。

| 制約 | Sora 2 | Veo 3.1 | Seedance 2.0 |

|---|---|---|---|

| 同時リクエスト数 | 10-15(有料ティア) | 約50/分(Vertex AIデフォルト) | 5-20(プロバイダー依存) |

| 生成時間(10秒動画) | 30秒-3分 | 20秒-90秒(fastモード) | 2-5分 |

| 最大キュー深度 | 約50 | 約200 | プロバイダー依存 |

| タイムアウト閾値 | 10分 | 5分 | 15分 |

よくあるエラーパターン

各APIがどのように失敗するかを理解することで、堅牢なシステムを構築できます。Sora 2で最も頻繁に発生するエラーはコンテンツモデレーションによるリジェクションであり、プロンプト内容によりますが全リクエストの約5-10%を占めます。これらのリジェクションは送信時ではなく生成中に発生するため、生成がブロックされたことを知るまでにすでに30秒以上待っていることになります。Veo 3.1で最も一般的な障害モードは、複雑なシーン生成時のタイムアウトであり、特にモデルが視覚要素と音声要素を同期させる必要がある動画+音声リクエストで顕著です。サードパーティプロバイダー経由のSeedance 2.0は、ゲートウェイタイムアウト、プロバイダーのレート制限エラー、メンテナンス中のモデル利用不可など、プロバイダーレベルの障害レイヤーが追加されます。堅牢なエラーハンドリングの構築には、ジッター付き指数バックオフの実装、リクエストごとのリトライバジェットの維持、そしてフォールバック戦略(別のモデルまたはユーザー向けのグレースフルデグラデーションパス)の確保が必要です。

スケーリング戦略

1日100本以上の動画を生成する本番ワークロードでは、どのAPIを選択するかにかかわらず、キューベースのアーキテクチャが不可欠です。生成リクエストをタスクキューに送信し、Webhookまたはポーリングワーカーで完了を非同期処理し、結果をCDN配信付きのクラウドストレージに保存します。このパターンにより、ユーザー向けアプリケーションを動画生成の可変レイテンシーから分離でき、3つすべてのプラットフォームでキュー待ち時間が増加するピーク時にもスパイクを吸収できます。実践的な推奨事項として、3つのAPIのいずれとも互換性のあるシステムを設計し、プロバイダー間でリクエストとレスポンスの形式を正規化するアダプターパターンを使用することで、可用性、コスト、品質の要件に基づいてリアルタイムでトラフィックをルーティングできるようにしましょう。最初からマルチプロバイダー戦略を実装することで、利用量が増加するにつれて交渉力も得られます。特定のコンテンツタイプに対して最適な価格、信頼性、品質の組み合わせを提供するプラットフォーム間でトラフィックを信頼性をもってシフトできるためです。マルチプロバイダーアーキテクチャを展開したチームは、シングルプロバイダー構成と比較して15-25%低い実効コストと99.5%以上の可用性を報告しています。これはプロバイダー固有の障害がパイプライン全体をブロックしなくなるためです。

コスト最適化 ── アグリゲーターとスマートな戦略

最安の1秒あたり料金を選ぶだけでなく、本番環境での動画生成コストを大幅に削減できる戦略がいくつかあります。多くの開発者にとって最もインパクトのある最適化は、複数の動画生成モデルに単一のインターフェースからアクセスできるAPIアグリゲーターの使用であり、特定の要件に基づいてリクエストごとに最もコスト効率の良いモデルを選択するインテリジェントルーティングと組み合わせることです。その他の戦略には、初回成功率を向上させるプロンプト最適化、再利用のための生成済み動画のキャッシュ、プレビューには安価なモデルを使用し最終レンダーにはプレミアムモデルを予約するティアード品質選択などがあります。

APIアグリゲーターは、複数の動画生成プラットフォームへのアクセスが必要なチームにとって実用的なソリューションとして台頭しています。Sora 2、Veo 3.1、Seedance 2.0のそれぞれに個別のAPIキー、課金アカウント、SDK統合を管理する代わりに、アグリゲーターはリクエストを適切な基盤APIにルーティングする統一エンドポイントを提供します。バッチ生成や本番利用が必要な開発者には、laozhang.aiが統一APIを通じてSora 2とVeo 3.1の両方へのアクセスを提供しています。Sora 2を例にとると、リクエストあたりの料金は720p(10-15秒の動画)で$0.15/リクエストから、1080p Proクオリティで$0.80/リクエストです。Veo 3.1については、fastモードが$0.15/リクエスト、standardモードが$0.25/リクエストで利用可能です。主な利点は、失敗時に課金されないポリシーです。コンテンツモデレーションによるリジェクションであれ生成のタイムアウトであれ、課金されません。このポリシーだけで、失敗した生成にもクレジットが消費される公式APIと比較して、総動画生成予算の10-15%を節約できます。さまざまなアグリゲーター比較を通じて最安のSora 2 APIアクセスを見つけることもできます。

python# Unified aggregator integration — access Sora 2, Veo 3.1, and more # through a single OpenAI-compatible endpoint from openai import OpenAI client = OpenAI( api_key="your_laozhang_api_key", base_url="https://api.laozhang.ai/v1" ) # Generate with Sora 2 sora_response = client.chat.completions.create( model="sora-2", # Switch to "veo-3.1-fast" for Veo 3.1 messages=[{ "role": "user", "content": "A time-lapse of a flower blooming in morning light" }], stream=True ) # Same endpoint, different model — no SDK changes needed veo_response = client.chat.completions.create( model="veo-3.1-fast", messages=[{ "role": "user", "content": "A chef preparing sushi with precise movements, ambient sounds" }], stream=True )

アグリゲーター以外では、プロンプトエンジニアリングが2番目に効果的なコスト最適化戦略です。シーン、カメラアングル、ライティング、動きのスタイルを明確に記述した適切なプロンプトは、初回成功率を向上させ、コストのかかる再生成の必要性を削減します。実運用経験に基づくと、生成リクエストを送信する前にプロンプトの改善に5-10分投資することで、成功率を70%から90%以上に向上させることができ、これは3つすべてのプラットフォームにおいて1本あたりの実効コストの20-25%削減に直結します。アグリゲーター統合の詳細なドキュメントはdocs.laozhang.aiでご覧いただけます。

どのAPIを選ぶべきか ── 判断フレームワーク

料金、統合の複雑さ、本番環境の制約、最適化戦略を検討した結果、最終的な判断はプロジェクト固有の要件に帰結します。曖昧な「場合による」という結論ではなく、5つの一般的な開発者シナリオに基づく明確な推奨フレームワークを提示します。この3つ以外のプラットフォームも含めたより広い視点については、主要AI動画モデルの総合比較で全体的な状況を解説しています。

音声が必要ならVeo 3.1を選びましょう。 これはこの比較全体で最もシンプルな判断ポイントです。2026年3月時点で、Veo 3.1はこの3つのAPIの中で動画と同期した音声を生成できる唯一のものです。プロジェクトにサウンドが必要な場合(ナレーション付きの製品デモ、音楽付きのソーシャルメディアコンテンツ、自然な音声付きの環境シーン)、Veo 3.1は別途音声生成と同期パイプラインを構築する必要性を排除します。音声対応生成のプレミアム(standard 1080p動画+音声で$0.40/秒 vs Sora 2の720p動画のみで$0.10/秒)は、ポストプロダクションで音声を追加するエンジニアリングとコンピューティングコストよりも大幅に低いです。8秒の最大尺が主な制限ですが、ショートフォームコンテンツ、ソーシャルメディアクリップ、製品ショーケースには通常十分です。

リアルなモーションが必要ならSora 2を選びましょう。 Sora 2の物理シミュレーションエンジンは、特に水、布、髪の毛、複雑なオブジェクトインタラクションを含むシーンにおいて、3つの中で最も自然なモーションを生成します。20秒の最大尺も3つの中で最長であり、延長ショットが必要なナラティブコンテンツに最適です。OpenAI SDKの統合により、すでにGPT-4やDALL-Eを使用しているチームは最小限の新しいインフラで動画生成をスタックに追加できます。720pで$0.10/秒のスタンダードティアはアクセスしやすいエントリーポイントであり、1080pで$0.50/秒のプロティアは放送品質の出力を提供します。

予算が最優先ならSeedance 2.0を選びましょう。 基本的な720p生成で約$0.06/秒のSeedance 2.0は、Veo 3.1またはSora 2の最安ティアよりも約40%低コストです。キャラクター一貫性機能も特に優れており、同じキャラクターが複数の動画に登場するアニメーションコンテンツシリーズに適しています。トレードオフは現実的なものです。公式APIがないためサードパーティプロバイダーへの依存が必要であり、ドキュメントは充実しておらず、可用性が不安定になることがあります。公式サポートと保証されたSLAよりもコスト効率が重要なプロジェクトには、Seedance 2.0は優れた価値を提供します。

柔軟性が必要ならアグリゲーターを選びましょう。 異なる品質要件にわたって数千本の動画を生成する本番システムでは、単一のAPIに固定することは戦略的リスクです。アグリゲーターを使用することで、シンプルなプレビュー生成を最安のモデルに、プレミアムなシネマティックコンテンツをSora 2 Proに、音声が必要なコンテンツをVeo 3.1に、すべて単一のAPI統合でルーティングできます。このアプローチはまた、プロバイダー間の自動フェイルオーバーを提供することで、プラットフォーム障害、料金変更、レート制限の制約からも保護します。

プロトタイプ段階なら最安のオプションから始めましょう。 AI動画生成が自社プロダクトに適合するかどうかまだ検証段階の初期プロジェクトでは、Sora 2のスタンダードティア($0.10/秒)またはVeo 3.1 Fast($0.10/秒)から始めましょう。どちらもそれぞれのプラットフォーム(OpenAIとGoogle AI Studio)を通じた無料ティアアクセスを提供しているため、予算を投入する前にユースケースの検証が可能です。プロダクトマーケットフィットを検証し、生成量を把握した後で、本番要件に最も合致するプラットフォームに移行してください。

結論として、すべての面で勝る単一のAPIは存在しません。2026年の動画生成API市場が健全なのは、まさに各プラットフォームが明確なニッチを確立しているからです。選択は、最も安い見出し価格ではなく、プロダクト要件によって導かれるべきです。なぜなら、最安の1秒あたり料金は、統合の手間、障害率、アプリケーションが必要とする特定の機能を考慮した場合の最低総所有コストとは必ずしも一致しないからです。これらの推奨事項を検討した後もまだ迷っている場合、最も安全な出発点は3つすべてにアクセスできるアグリゲーターを使用し、単一プラットフォームにコミットする前に実際のコンテンツでリアルワールドのA/Bテストを実施することです。

FAQ ── よくある質問

Sora 2 APIは一般公開されていますか?それとも特別なアクセスが必要ですか?

はい、Sora 2 APIは2026年初頭からOpenAIの標準APIプラットフォームを通じて一般公開されています。有効な支払い方法が設定されたOpenAI APIアカウントが必要ですが、動画生成アクセスのための個別のウェイトリストはありません。GPT-4やDALL-Eと同じ認証フローでアクセスでき、生成された動画の秒数に応じて課金されます。レート制限はアカウントティアに応じてスケールするため、新しいアカウントは利用履歴が蓄積されるにつれて上限が引き上げられる、より低い制限からスタートします。3つのモデルバリアント(sora-2、720pのsora-2-pro、1080pのsora-2-pro)すべてが、追加の承認なしですべての有料APIユーザーに利用可能です。

各APIで1分間の動画を生成するにはいくらかかりますか?

最安の利用可能なティアでは、1分間の動画のコストはSora 2で約$6.00(720pで$0.10/秒)、Veo 3.1 Fastで約$6.00(720p動画のみで$0.10/秒)、Seedance 2.0で約$3.60(720p basicで約$0.06/秒)です。ただし、これらの数値は単一の連続クリップを想定しており、現在どのAPIもそれをサポートしていません。Veo 3.1は最大8秒、Seedance 2.0は最大15秒、Sora 2は最大20秒です。1分間の動画を生成するにはクリップ長に応じて3-8回の個別のAPIコールが必要であり、それぞれに成功率のオーバーヘッドが伴います。失敗と再生成を考慮した1分間の使用可能な動画コンテンツの現実的なコストは、Sora 2で約$8-$12、Veo 3.1 Fastで約$8-$12、Seedance 2.0で約$5-$7です。

中国以外からSeedance 2.0 APIにアクセスできますか?

2026年3月時点で、Seedance 2.0には公式の国際APIがありません。ByteDanceの主要なアクセスチャネルはJiMengプラットフォーム(jimeng.jianying.com)を通じたもので、中国市場のユーザー向けに設計されており、登録には中国の電話番号が必要です。海外の開発者は、プロキシ統合を構築したサードパーティAPIプロバイダー(fal.aiやさまざまなアグリゲーターサービスを含むプラットフォーム)を通じてSeedance 2.0にアクセスできます。これらのプロバイダーが基盤となるアクセスを処理し、どの地理的位置からでも動作する標準的なREST APIを公開しています。トレードオフとして、ByteDanceと直接取引するのではなく、可用性と料金についてサードパーティプロバイダーに依存することになります。

画像から動画への変換機能が最も優れているAPIはどれですか?

3つのAPIすべてが画像から動画への生成をサポートしていますが、アプローチは異なります。Veo 3.1は最も汎用性の高い画像-動画変換システムを提供しており、ユニークな「最初のフレームと最後のフレーム」モードでは、開始画像と終了画像の両方を提供でき、モデルがその間の滑らかなトランジションを生成します。これは製品の可視化やアニメーションワークフローに特に強力です。Sora 2は動画生成をガイドするための単一のリファレンス画像入力をサポートしており、入力画像のスタイルとコンポジションに忠実な結果を生成します。Seedance 2.0はマルチモーダルリファレンスシステムを備えており、キャラクターリファレンス画像を受け取って複数の動画生成間で一貫性を維持できるため、持続的なキャラクターアイデンティティが必要なプロジェクトに最も適したオプションです。

動画生成に失敗した場合でも課金されますか?

失敗時の課金ポリシーは大きく異なります。OpenAIのSora 2 APIの課金は出力動画の尺に基づくため、出力を生成する前に生成が失敗した場合、通常は課金されません。ただし、生成途中に発生するコンテンツモデレーションによるリジェクションは一部のクォータを消費する場合があります。GoogleのVertex AIを通じたVeo 3.1も同様のパターンに従い、成功した出力に対してのみ課金されます。Seedance 2.0のサードパーティプロバイダーは失敗時のポリシーがさまざまです。laozhang.aiのようなアグリゲーターサービスは、非同期APIエンドポイントに対して失敗時無課金を明確に保証しており、コンテンツモデレーションによるリジェクションやタイムアウトを含め、失敗の理由に関係なく正常に生成された動画に対してのみ課金されます。このポリシーの違いは、失敗率が無視できない本番環境では総コストの10-15%の節約になる可能性があります。