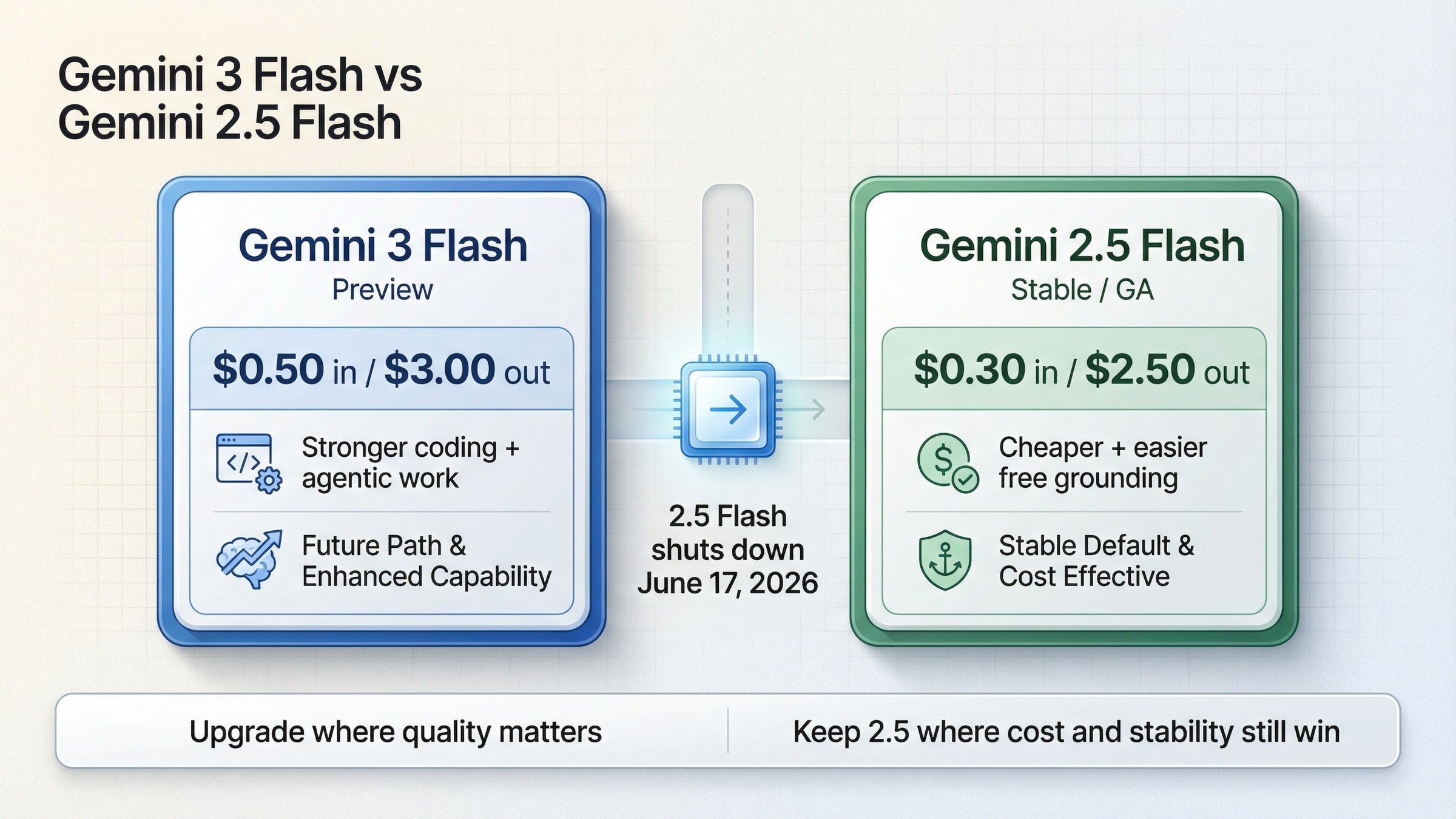

Короткий ответ на 20 марта 2026 года такой: Gemini 3 Flash стоит выбирать там, где вам важны coding, agentic-workflows, multimodal reasoning и более высокий потолок качества; Gemini 2.5 Flash все еще разумнее как default-маршрут, если для вас важнее низкая цена, Stable / GA статус и бесплатный grounding. Именно это решение скрывается за данным запросом.

Проблема в том, что официальные страницы Google одновременно дают два сигнала. На официальной странице deprecations указано, что gemini-2.5-flash будет отключен 17 июня 2026 года, а рекомендуемой заменой является gemini-3-flash-preview. Но на официальной странице pricing видно, что Gemini 3 Flash дороже, а на странице rate limits прямо сказано, что preview-модели обычно имеют более строгие ограничения.

Поэтому это не история в духе «новая модель автоматически лучше». Это задача миграции: где уже пора перейти на 3 Flash, а где 2.5 Flash еще имеет сильный практический смысл.

Краткое содержание

- Выбирайте Gemini 3 Flash первым, если строите coding agents, multimodal assistants, tool-heavy workflows или продукт, где качество важнее минимальной цены за токены.

- Оставляйте Gemini 2.5 Flash первым, если у вас high-volume текстовые пайплайны, консервативный production-default или нужен дешевый grounded prototype.

- Не затягивайте с подготовкой миграции: Google уже официально указал Gemini 3 Flash как замену Gemini 2.5 Flash.

Сжатая официальная картина выглядит так:

| Параметр | Gemini 3 Flash | Gemini 2.5 Flash | Что это значит |

|---|---|---|---|

| Текущий статус | Preview | Stable / GA | 3 Flash - будущая линия, 2.5 Flash - более спокойный текущий default |

| Model ID | gemini-3-flash-preview | gemini-2.5-flash | При фиксированном model ID миграция будет явным шагом |

| Дата релиза | 17 декабря 2025 | 17 июня 2025 | 3 Flash - новая генерация |

| Lifecycle | Shutdown date не объявлен | Shutdown date: 17 июня 2026 | Оставаться на 2.5 Flash можно, но не бесконечно |

| Recommended replacement | N/A | gemini-3-flash-preview | Официальное направление миграции уже задано |

| Standard price | $0.50 input / $3.00 output | $0.30 input / $2.50 output | 3 Flash ощутимо дороже |

| Batch price | $0.25 / $1.50 | $0.15 / $1.25 | 2.5 Flash дешевле и в batch |

| Context / output | 1,048,576 / 65,536 | 1,048,576 / 65,536 | Лимиты токенов здесь не решают выбор |

| Grounding | paid monthly allowances | free Search до 500 RPD и free Maps до 500 RPD | 2.5 удобнее для недорогих grounded-продуктов |

| Thinking control | thinking_level | thinking_budget | Меняется даже способ настройки latency / reasoning |

| Computer Use | поддерживается | на Gemini API page не указан | 3 Flash сильнее для agentic use cases |

Практически это означает следующее. Если у вас есть маршруты, где ошибка модели превращается в заметный продуктовый урон, например coding-ассистент, tool orchestration, многошаговый research assistant или multimodal workflow, то цена Gemini 3 Flash чаще всего оправдана. Если же ваши деньги сгорают в массовых summary, extraction и routing-задачах, то разница между \$0.30 и \$0.50 за input становится не теорией, а строкой в ежемесячном счете.

Отсюда и главный вывод первой половины статьи: не пытайтесь выбрать один «идеальный» Flash для всего. На 20 марта 2026 года более зрелая стратегия выглядит как split-routing, где Gemini 3 Flash забирает premium- и quality-sensitive трафик, а Gemini 2.5 Flash продолжает обслуживать дешевый и предсказуемый слой, пока вы спокойно доводите миграцию до конца.

Почему выбор сложнее, чем кажется по launch-странице

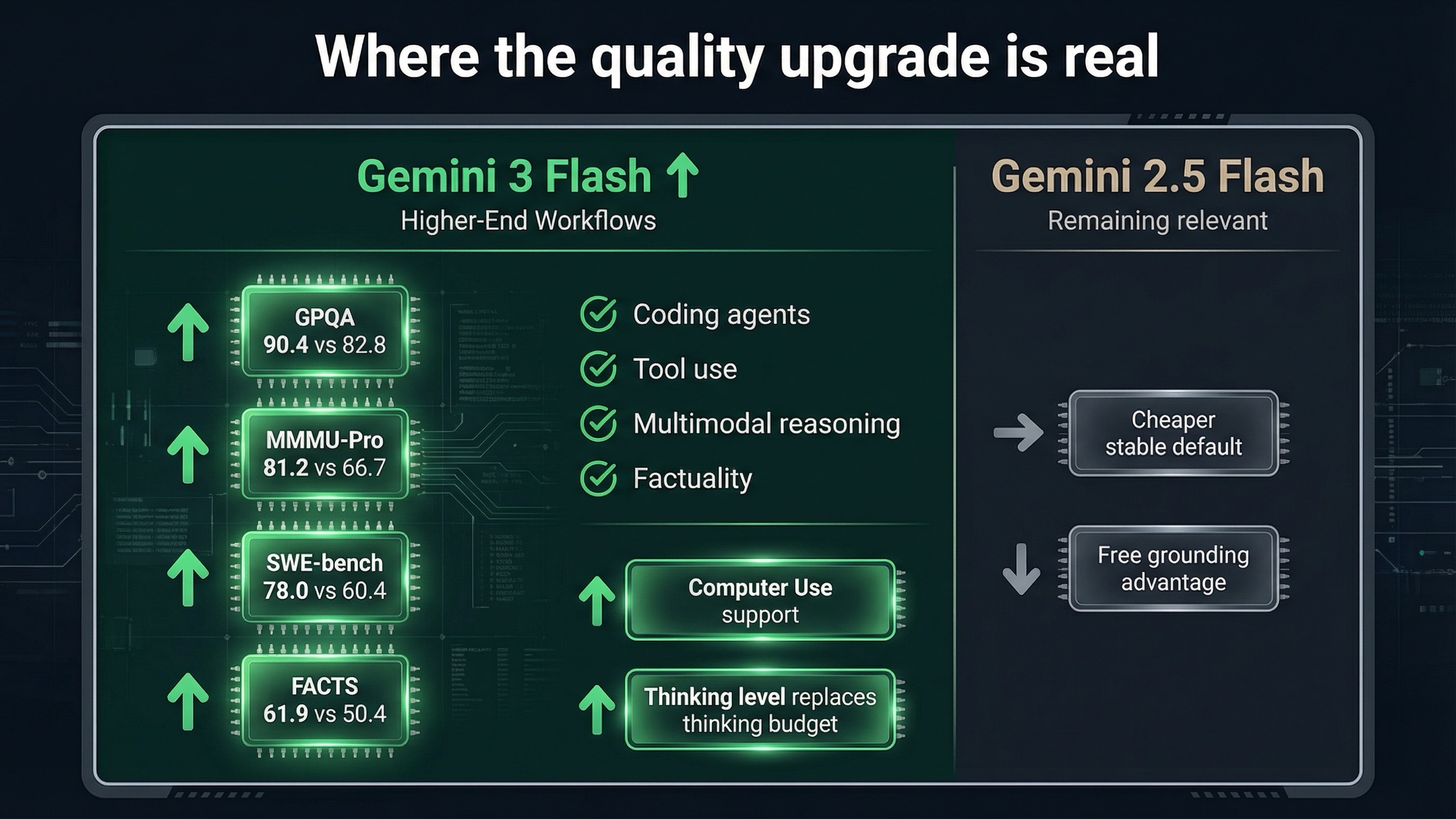

Официальная история Gemini 3 Flash проста: Google подает его как Flash-линию с гораздо более сильным reasoning-потолком. Это не пустой маркетинг. На официальной странице DeepMind Gemini 3 Flash напрямую опережает Gemini 2.5 Flash по ряду действительно важных метрик:

- GPQA: 90.4 vs 82.8

- MMMU-Pro: 81.2 vs 66.7

- SWE-bench Verified: 78.0% vs 60.4%

- FACTS: 61.9% vs 50.4%

- MCP Atlas: 57.4% vs 8.8%

Это объясняет, почему Google уже перевел alias gemini-flash-latest на gemini-3-flash-preview в release notes от 21 января 2026 года. Для coding, multimodal и tool-driven задач Gemini 3 Flash действительно выглядит как более серьезная Flash-модель.

Но если речь идет об API-выборе, а не о пользовательском приложении Gemini, то на этом анализ останавливаться нельзя. Gemini 3 Flash сильнее, но он одновременно:

- дороже

- все еще Preview

- требует новой миграции thinking controls

В то же время Gemini 2.5 Flash по-прежнему:

- дешевле

- Stable / GA

- удобнее для бесплатного grounding

Именно поэтому правильный вопрос звучит не «какая модель лучше вообще», а «в каких workload эта прибавка качества стоит дополнительных денег и preview-риска».

Цена, grounding и сроки отключения на 20 марта 2026 года

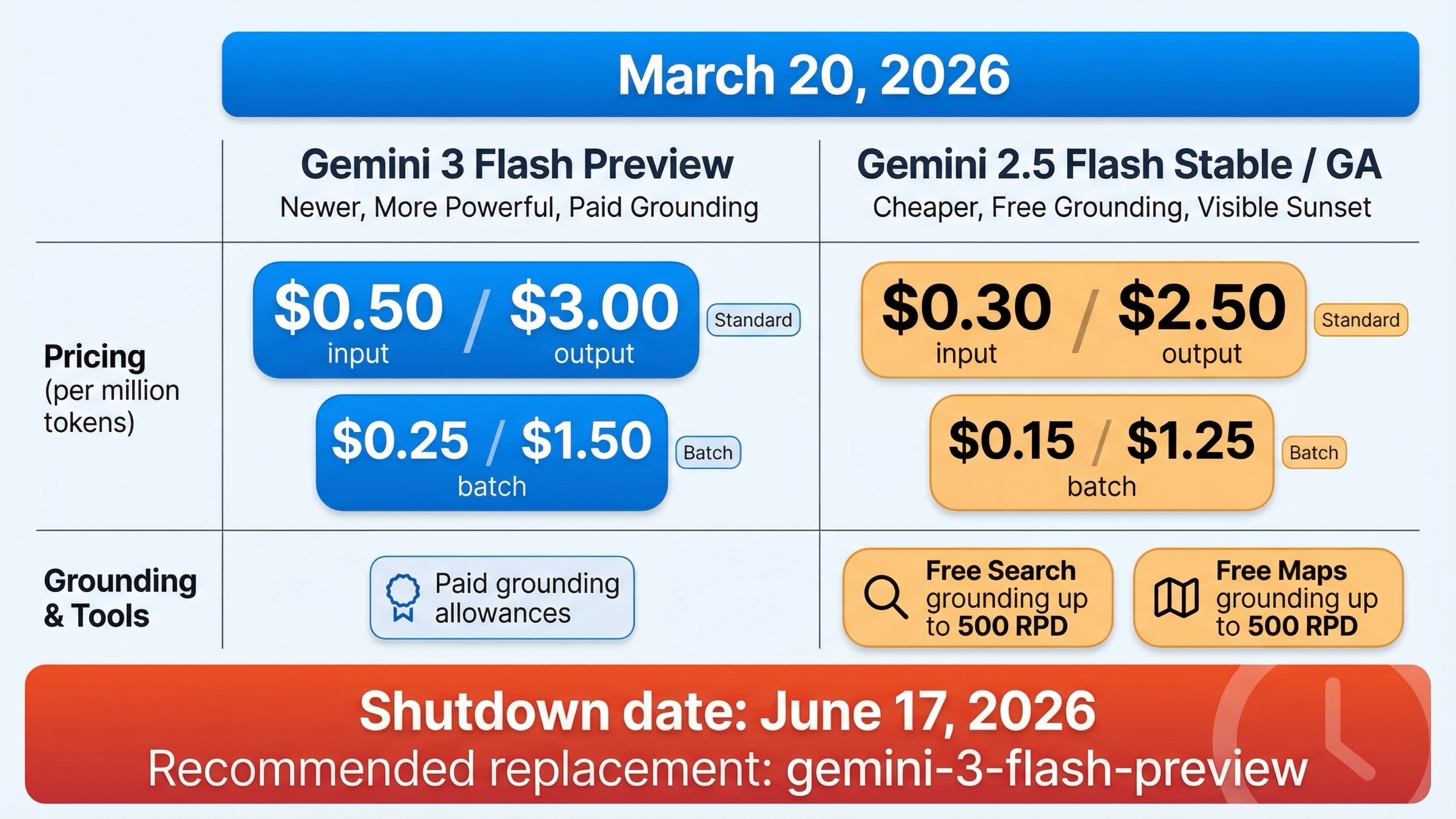

На официальной pricing page стандартные цены сейчас такие:

- Gemini 3 Flash Preview:

\$0.50input и\$3.00output за 1M tokens - Gemini 2.5 Flash:

\$0.30input и\$2.50output за 1M tokens

Для batch-нагрузки:

- Gemini 3 Flash batch:

\$0.25input и\$1.50output - Gemini 2.5 Flash batch:

\$0.15input и\$1.25output

То есть Gemini 3 Flash - это не «та же цена, но лучше». По сравнению с Gemini 2.5 Flash он примерно на 67% дороже по input и на 20% дороже по output. Для coding agent это может быть оправдано. Для дешевого high-volume extraction pipeline - далеко не всегда.

Grounding делает различие еще более практичным. Та же pricing page показывает:

- у Gemini 2.5 Flash есть бесплатный Google Search grounding до 500 RPD и бесплатный Google Maps grounding до 500 RPD

- у Gemini 3 Flash Preview такой же free-tier истории нет, вместо этого показаны paid-tier monthly allowances

Для grounded assistant это огромная разница. Если вы хотите недорогой прототип или ранний продукт с поисковым grounding, 2.5 Flash по-прежнему легче оправдать.

И наконец, lifecycle. Официальная deprecations page прямо говорит:

gemini-2.5-flashrelease date: 17 июня 2025- shutdown date: 17 июня 2026

- recommended replacement:

gemini-3-flash-preview

Значит, оставаться на 2.5 Flash можно, но делать вид, что это долгосрочный default на годы вперед, уже нельзя.

Есть и еще один организационный нюанс. Чем дольше вы держите gemini-2.5-flash как универсальный дефолт, тем выше шанс, что миграция в конце превратится в сжатый аварийный проект. Намного безопаснее уже сейчас разложить трафик на три корзины: то, что надо перевести в 3 Flash немедленно, то, что можно оставить на 2.5 Flash до мая, и то, что вообще стоит вынести в отдельный low-cost слой с собственными quality guardrails.

Такой подход особенно важен для команд, которые завязали продукт на grounded answers. Бесплатный Search / Maps grounding у 2.5 Flash действительно снижает cost of experimentation, но ровно поэтому нужно заранее понять, какую часть этих сценариев вы позже переведете на более сильную модель, а какую, возможно, вообще замените другим маршрутом или собственной retrieval-логикой.

Что именно дает Gemini 3 Flash сверх Gemini 2.5 Flash

Самая частая ошибка в этом сравнении - считать Gemini 3 Flash просто «чуть улучшенной версией» Gemini 2.5 Flash. На практике разрыв ощутимее.

Текущие официальные страницы Gemini 3 Flash и Vertex AI documentation выводят вперед несколько вещей, которые важны именно для production-workflows:

- Computer Use

- multimodal function responses

- streaming function call arguments

- media resolution control

- thinking_level вместо старой логики

thinking_budget

Это важно не для абстрактного «модель умнее», а для реальных agentic-сценариев: coding assistants, tool orchestration, multimodal analysis, search-heavy workflows.

И еще один важный момент: меняется не только качество, но и управляющая поверхность. Vertex AI прямо рекомендует тем, кто раньше ставил thinking_budget: 0 на Gemini 2.5 Flash, начинать миграцию на Gemini 3 Flash с thinking_level: MINIMAL, если нужен близкий latency / cost профиль. То есть даже если prompt останется прежним, поведение reasoning-path у вас может стать другим.

Это критично для production-команд, которые привыкли объяснять поведение модели исключительно prompt engineering-ом. В реальности после перехода на Gemini 3 Flash вам придется заново сверять не только answer quality, но и частоту tool calls, стабильность длинных chain-of-thought-подобных задач, распределение latency по percentiles и конечную стоимость успешно завершенного workflow. Если вы этого не сделаете, можно получить ситуацию, где benchmark выглядит лучше, а экономическая эффективность конкретного маршрута внезапно хуже.

Именно здесь преимущество 3 Flash становится по-настоящему предметным. Он нужен не для того, чтобы «побеждать в таблице», а для тех потоков, где улучшение в reasoning, tool use и multimodal понимании превращается в меньшее число провалов, меньшее количество повторных запросов и более высокую долю успешно завершенных действий. Там premium-price легче окупается.

Где Gemini 2.5 Flash все еще выглядит разумно

Gemini 2.5 Flash не стал плохой моделью только потому, что появился 3 Flash.

Он все еще имеет сильный смысл в трех типовых случаях:

1. Ваш workload очень чувствителен к цене.

Если вы гоняете classification, light summarization, extraction или support routing в больших объемах, более низкая цена 2.5 Flash остается настоящим преимуществом.

2. Вам нужен Stable default, пока вы проверяете замену.

Факт того, что 2.5 Flash остается Stable / GA, а 3 Flash - Preview, все еще важен для production risk management.

3. Вам важен дешевый grounding.

Бесплатный Search / Maps grounding у 2.5 Flash делает ранние grounded-продукты проще и дешевле.

Ключевая мысль здесь такая: лучший аргумент за 2.5 Flash - не «он сильнее». Лучший аргумент за 2.5 Flash - «он дешевле, стабильнее и лучше подходит как краткосрочный default на части трафика, пока миграция еще не завершена».

Кроме того, 2.5 Flash удобен как контрольная линия для ваших evals. Пока вы проверяете 3 Flash на новых маршрутах, старый stable path дает полезную базу сравнения по cost, latency и incident-rate. Это снижает риск того, что команда спишет любые изменения на «эффект новой модели» и слишком поздно заметит реальное ухудшение в конкретных сегментах трафика.

Какую модель брать под какие задачи

| Workload | Что брать первым | Почему |

|---|---|---|

| Coding agents / developer tools | Gemini 3 Flash | benchmark и feature-set явно в пользу 3 Flash |

| Tool-heavy assistants | Gemini 3 Flash | лучше reasoning, tool use и Computer Use |

| Search-heavy продукты, где качество важнее цены | Gemini 3 Flash | более высокий capability ceiling |

| Budget-first summarization / extraction | Gemini 2.5 Flash | cost wins |

| Дешевые grounded prototypes | Gemini 2.5 Flash | free grounding удобнее |

| Консервативный production default | Gemini 2.5 Flash пока что | Stable still matters |

| Greenfield capability-first product | Gemini 3 Flash | именно туда Google ведет Flash-линейку |

Практический вывод простой:

- новый capability-first продукт: начинайте с Gemini 3 Flash

- дешевый высокообъемный pipeline: оставляйте Gemini 2.5 Flash и мигрируйте точечно

- если можете split-route, не forcing one-model-for-everything

Если у вас уже есть продакшен с разными типами запросов, полезно формализовать это решение в policy-слое. Например: code generation, browser or tool orchestration и multimodal tickets отправляются в Gemini 3 Flash; bulk extraction, light summarization и inexpensive grounded answers остаются на Gemini 2.5 Flash; а спорные случаи идут в A/B-пул, где вы сравниваете successful-task rate, cost per resolved task и rollback pressure. Тогда выбор модели становится не спором о вкусах, а наблюдаемым инженерным правилом.

Для сравнения с более дорогой Pro-веткой есть явный английский fallback: Gemini 3 Flash vs Pro capabilities.

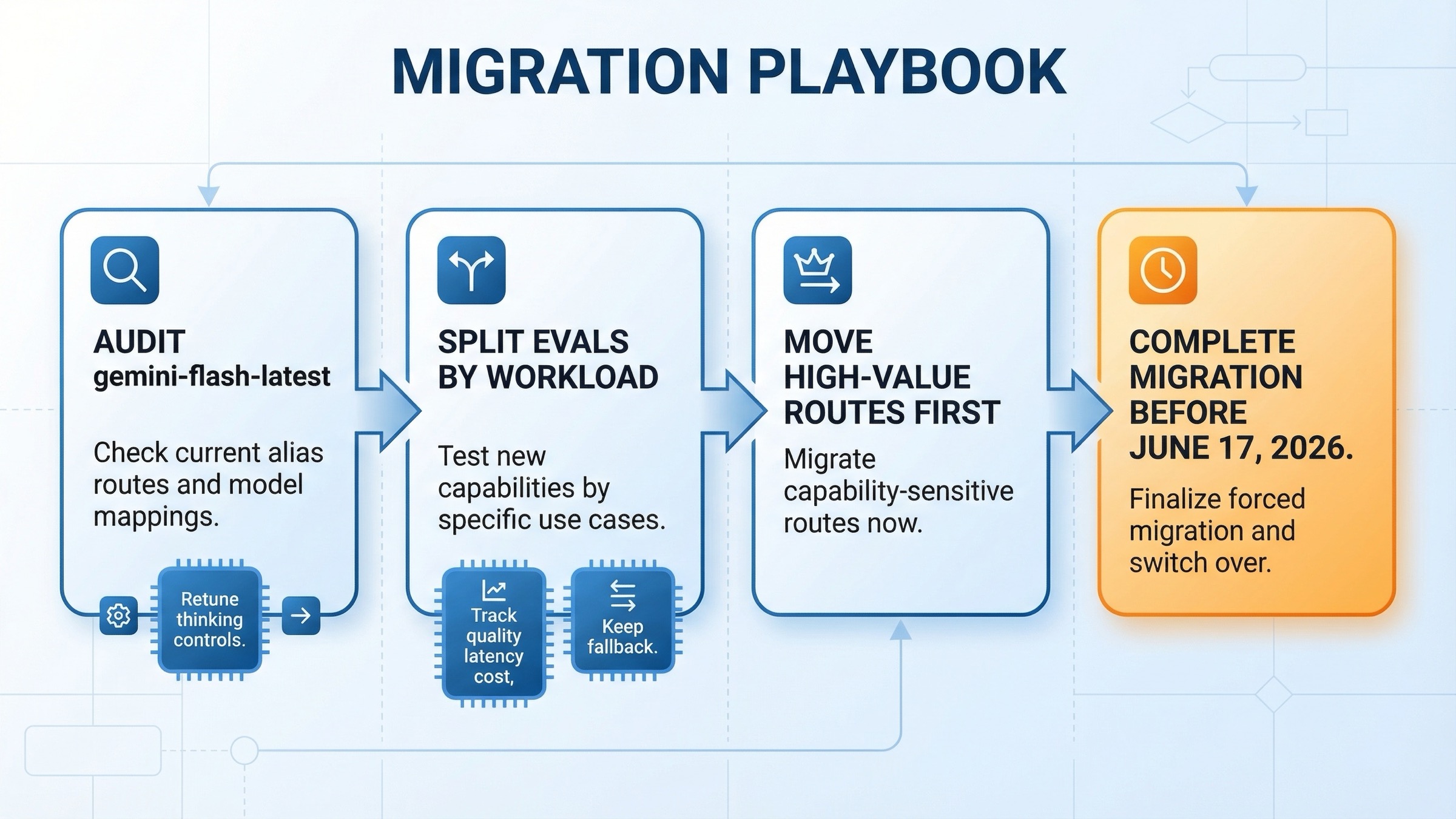

Как мигрировать без лишней боли

Худшая стратегия - просто заменить model name и надеяться, что все станет лучше.

Нормальная стратегия - staged rollout.

1. Сначала проверьте, не используете ли вы alias.

В официальных release notes сказано, что gemini-flash-latest был переключен на gemini-3-flash-preview 21 января 2026 года. Если вы сидите на alias, часть миграции могла уже случиться.

2. Разбейте evaluation по workload-группам.

Минимум:

- coding / agentic tasks

- chat / support

- grounded search

- extraction / summarization

- multimodal tasks

3. Перенастройте thinking controls.

Если раньше вы опирались на thinking_budget, после перехода на thinking_level нельзя считать latency и cost автоматически эквивалентными.

4. Следите сразу за тремя вещами.

- quality

- latency

- effective cost

5. Держите fallback до конца cutover.

Поскольку у Gemini 2.5 Flash есть не мгновенное отключение, а фиксированная дата, у вас есть время мигрировать дисциплинированно, а не в панике.

Если нужен простой календарный ориентир:

- сейчас - апрель 2026: alias audit и workload-based evals

- апрель - май 2026: переносите сначала capability-sensitive routes

- до 17 июня 2026: завершайте оставшийся cutover с

gemini-2.5-flash

Если нужно отдельно читать про quota / tier behavior, используйте явный английский fallback: Gemini API rate limits per tier.

Полезно также заранее определить технические стоп-сигналы, при которых маршрут нельзя переводить на 3 Flash массово. Обычно это рост latency по P95/P99 выше вашего SLA, ухудшение success rate в tool-heavy сценариях, увеличение ручных эскалаций или заметный рост effective cost per completed task. Если такие метрики записаны до cutover, у команды появляется нормальный rollback-порог, а не «ощущение, что стало как-то хуже».

Последний практический совет: не делайте миграцию только через глобальную замену model ID в одном месте. Лучше явно зафиксировать, какие prompts, какие tools, какие safety policies и какие eval datasets относятся к каждому маршруту. Тогда 17 июня 2026 года вы встретите не с поиском по репозиторию, а с подготовленным списком того, что уже переведено, что еще в канареечном режиме и что должно быть выключено окончательно.

FAQ

Gemini 3 Flash лучше Gemini 2.5 Flash?

Да, если говорить о верхнем capability ceiling. По официальной таблице DeepMind Gemini 3 Flash лучше по reasoning, coding, multimodal, agentic и factuality метрикам. Но это не значит, что он автоматически лучший default для любой production-системы.

Нужно ли мигрировать прямо сейчас?

Нужно начинать evaluation и staged rollout сейчас. Не обязательно делать blind full cutover сегодня, но откладывать подготовку больше нерационально.

Имеет ли Gemini 2.5 Flash смысл в 2026 году?

Да. Он все еще дешевле, Stable и удобнее для недорогого grounding. Как краткосрочный default на части трафика это все еще логичный выбор.

Какой migration detail чаще всего упускают?

Смена control surface: thinking_budget против thinking_level. Если ваши latency / cost assumptions строились вокруг budget tuning, при миграции это обязательно нужно перепроверить.